Nginx+Tomcat搭建高性能负载均衡集群

在Nginx反向代理转发Tomcat这篇文章中,对nginx进行了简单的介绍,实现了nginx代理转发的功能,以及静态、动态资源分离的实现。本篇文章接着这篇文章继续写下去的,如果有不明白的地方,可以进入Nginx反向代理转发tomcat 开始阅读。

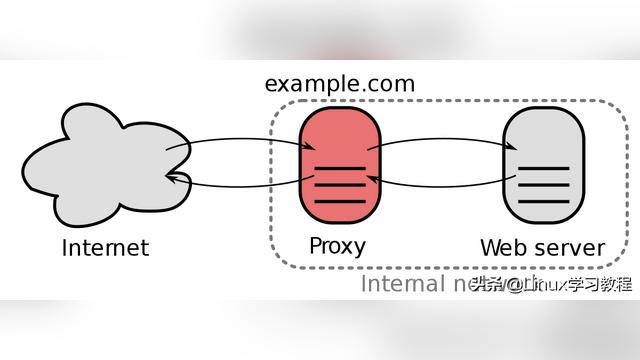

nginx+tomcat 部署实现负载均衡原理如下图:

nginx作为代理服务器,可以转发多个tomcat服务器,实现负载均衡。

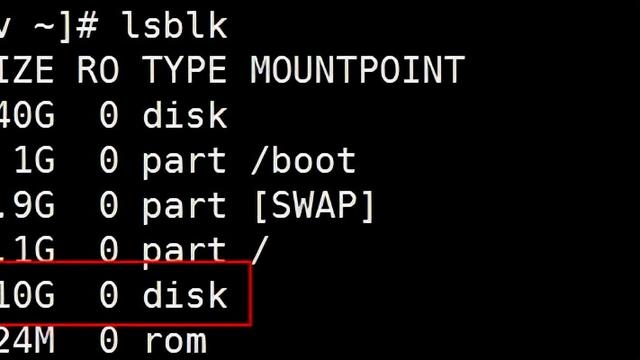

1.环境准备

安装nginx服务,可参考:linux系统下Nginx的安装

部署tomcat,至少部署2个tomcat服务,本篇文章用2台tomcat服务作为测试。

启动部署成功的服务

2.修该nginx配置

在server配置的上面新增upstream 配置,后面的“server_tomcat”相当于该配置别名,供后面的“proxy_pass”配置使用。

upstream 里面配置的就是2个tomcat的访问地址,IP:端口号,不用写http:// 。

proxy_pass 转发定位到upstream 里面配置的多台服务器proxy_pass 配置的http:// 必须要写。

修改完成后,重新加载nginx服务的配置,访问系统IP,如下图所示:

点击刷新,页面如下:

再点击刷新,页面如下:

再点击刷新,页面如下:

可以发现,每次刷新nginx代理都会转发不同的服务器,貌似两台两台服务器被访问的概率一样,实现了负载均衡。

看到这,肯定会有人有疑问,如果有一台服务器突然挂掉了怎么办?别急,这种情况nginx已经给我们处理了,当有台服务器挂掉了,nginx默认不会访问挂掉的服务,继续访问其他正在运行的服务,提供了很好的容错机制。

能不能让两台服务器访问的概率不一样了?能,nginx给我们提供了 weight这个属性,可以给各个服务器分配权重,配置如下:

weight 默认为1.weight越大,负载的权重就越大。

通过上面的配置,刷新页面,会发现访问tomcat1的概率明显比访问tomcat2的概率大。

PS:upstream目前支持5种方式的分配

1、轮询(默认)

每个请求按时间顺序逐一分配到不同的后端服务器,如果后端服务器down掉,能自动剔除。

2、weight

指定轮询几率,weight和访问比率成正比,用于后端服务器性能不均的情况。

例如:

- upstream bakend {

- server 192.168.0.14 weight=10;

- server 192.168.0.15 weight=10;

- }

3、ip_hash

每个请求按访问ip的hash结果分配,这样每个访客固定访问一个后端服务器,可以解决session的问题。

例如:

- upstream bakend {

- ip_hash;

- server 192.168.0.14:88;

- server 192.168.0.15:80;

- }

4、fair(第三方)

按后端服务器的响应时间来分配请求,响应时间短的优先分配。

- upstream backend {

- server server1;

- server server2;

- fair;

- }

5、url_hash(第三方)

按访问url的hash结果来分配请求,使每个url定向到同一个后端服务器,后端服务器为缓存时比较有效。

例:在upstream中加入hash语句,server语句中不能写入weight等其他的参数,hash_method是使用的hash算法

- upstream backend {

- server squid1:3128;

- server squid2:3128;

- hash $request_uri;

- hash_method crc32;

- }

- tips:

- upstream bakend{#定义负载均衡设备的Ip及设备状态

- ip_hash;

- server 127.0.0.1:9090 down;

- server 127.0.0.1:8080 weight=2;

- server 127.0.0.1:6060;

- server 127.0.0.1:7070 backup;

- }

在需要使用负载均衡的server中增加

proxy_pass http://bakend/;

每个设备的状态设置为:

1.down 表示单前的server暂时不参与负载

2.weight 默认为1.weight越大,负载的权重就越大。

3.max_fails :允许请求失败的次数默认为1.当超过最大次数时,返回proxy_next_upstream 模块定义的错误

4.fail_timeout:max_fails次失败后,暂停的时间。

5.backup: 其它所有的非backup机器down或者忙的时候,请求backup机器。所以这台机器压力会最轻。

nginx支持同时设置多组的负载均衡,用来给不用的server来使用。

client_body_in_file_only 设置为On 可以讲client post过来的数据记录到文件中用来做debug

client_body_temp_path 设置记录文件的目录 可以设置最多3层目录

location 对URL进行匹配。可以

在Nginx反向代理转发tomcat这篇文章中,对nginx进行了简单的介绍,实现了nginx代理转发的功能,以及静态、动态资源分离的实现。本篇文章接着这篇文章继续写下去的,如果有不明白的地方,可以进入Nginx反向代理转发tomcat 开始阅读。

nginx+tomcat 部署实现负载均衡原理如下图:

nginx作为代理服务器,可以转发多个tomcat服务器,实现负载均衡。

1.环境准备

安装nginx服务,可参考:Linux系统下Nginx的安装

部署tomcat,至少部署2个tomcat服务,本篇文章用2台tomcat服务作为测试。

启动部署成功的服务

2.修该nginx配置

在server配置的上面新增upstream 配置,后面的“server_tomcat”相当于该配置别名,供后面的“proxy_pass”配置使用。

upstream 里面配置的就是2个tomcat的访问地址,IP:端口号,不用写http:// 。

proxy_pass 转发定位到upstream 里面配置的多台服务器proxy_pass 配置的http:// 必须要写。

修改完成后,重新加载nginx服务的配置,访问系统IP,如下图所示:

点击刷新,页面如下:

再点击刷新,页面如下:

再点击刷新,页面如下:

可以发现,每次刷新nginx代理都会转发不同的服务器,貌似两台两台服务器被访问的概率一样,实现了负载均衡。

看到这,肯定会有人有疑问,如果有一台服务器突然挂掉了怎么办?别急,这种情况nginx已经给我们处理了,当有台服务器挂掉了,nginx默认不会访问挂掉的服务,继续访问其他正在运行的服务,提供了很好的容错机制。

能不能让两台服务器访问的概率不一样了?能,nginx给我们提供了 weight这个属性,可以给各个服务器分配权重,配置如下:

weight 默认为1.weight越大,负载的权重就越大。

通过上面的配置,刷新页面,会发现访问tomcat1的概率明显比访问tomcat2的概率大。

PS:upstream目前支持5种方式的分配

1、轮询(默认)

每个请求按时间顺序逐一分配到不同的后端服务器,如果后端服务器down掉,能自动剔除。

2、weight

指定轮询几率,weight和访问比率成正比,用于后端服务器性能不均的情况。

例如:

- upstream bakend {

- server 192.168.0.14 weight=10;

- server 192.168.0.15 weight=10;

- }

3、ip_hash

每个请求按访问ip的hash结果分配,这样每个访客固定访问一个后端服务器,可以解决session的问题。

例如:

- upstream bakend {

- ip_hash;

- server 192.168.0.14:88;

- server 192.168.0.15:80;

- }

4、fair(第三方)

按后端服务器的响应时间来分配请求,响应时间短的优先分配。

- upstream backend {

- server server1;

- server server2;

- fair;

- }

5、url_hash(第三方)

按访问url的hash结果来分配请求,使每个url定向到同一个后端服务器,后端服务器为缓存时比较有效。

例:在upstream中加入hash语句,server语句中不能写入weight等其他的参数,hash_method是使用的hash算法

- upstream backend {

- server squid1:3128;

- server squid2:3128;

- hash $request_uri;

- hash_method crc32;

- }

- tips:

- upstream bakend{#定义负载均衡设备的Ip及设备状态

- ip_hash;

- server 127.0.0.1:9090 down;

- server 127.0.0.1:8080 weight=2;

- server 127.0.0.1:6060;

- server 127.0.0.1:7070 backup;

- }

在需要使用负载均衡的server中增加

proxy_pass http://bakend/;

每个设备的状态设置为:

1.down 表示单前的server暂时不参与负载

2.weight 默认为1.weight越大,负载的权重就越大。

3.max_fails :允许请求失败的次数默认为1.当超过最大次数时,返回proxy_next_upstream 模块定义的错误

4.fail_timeout:max_fails次失败后,暂停的时间。

5.backup: 其它所有的非backup机器down或者忙的时候,请求backup机器。所以这台机器压力会最轻。

nginx支持同时设置多组的负载均衡,用来给不用的server来使用。

client_body_in_file_only 设置为On 可以讲client post过来的数据记录到文件中用来做debug

client_body_temp_path 设置记录文件的目录 可以设置最多3层目录

location 对URL进行匹配。可以