AI向情感化方向发展?从图像中能检测出11种情绪

2019-07-31

加入收藏

7月31日消息,随着人工智能技术的发展,人类已经不满足于它只是一个工具,而是希望人工智能能够理解人类情感。日前,美国科罗拉多大学和杜克大学的研究人员开发了一种神经网络模型EmoNet,该模型能够准确地将图像与11种不同的情绪类别进行配对。

EmoNet是利用一个由2185个视频组成的数据库开发的,这些视频类似于27种不同的情绪类别,包括焦虑、兴趣、悲伤和惊讶等。

虽然该模型能够在高置信区间区分与恐惧、渴望相关的图像,但它在识别惊讶、困惑和敬畏等被认为是更抽象的情感方面却没有那么强的能力。该神经网络利用颜色、空间功率谱以及图像中物体和人脸的存在对它们进行分类。

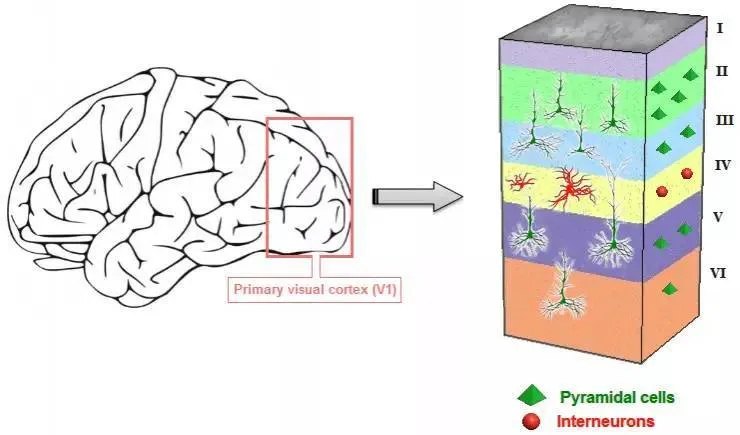

这项研究可能为以前依赖参与者自我报告情绪的研究人员提供价值。现在,科学家们不再仅仅依靠主观反应,而是可以使用人工智能来关注视觉皮层内的模式,以更好地理解参与者的感受。不同的模式会解码不同的情感体验。

研究人员Tor Wagner表示:“在情绪测量方面,我们通常仍然只限于问人们的感觉如何。我们的研究成果可以帮助我们直接测量与情感相关的大脑处理。”

除了测量情绪的新方法,研究团队还指出,人工智能可以帮助消除心理健康方面的标签。从焦虑和抑郁等主观标签转向大脑出炉,可能会为治疗和干预带来新的目标。

当然,解码人类情感只是研究人员探索人工智能的最新例子之一。今年6月,联合国研究人员训练了一个开源语言模型,该模型通过维基百科上的文本和七千多篇在联合国大会上发表过的演讲的文本进行训练,就能很容易地生成一篇虚假但令人信服的联合国演讲。