算法操控2020美国总统大选登Science封面!Meta首次祭出4篇研究,自证清白,两极分化无解

你知道,算法究竟是如何影响美国大选的吗?

今天,「Meta的算法影响2020年美国选举」研究登上了Science封面。

Meta首次一口气发表了4篇具有里程碑意义的研究论文。

目的是为了探讨Facebook和Ins在美国2020年选举中,对关键政治态度和行为的影响。

研究发现,几乎没有证据表明,Meta平台会造成有害的 「情感」两极分化,或对关键政治态度、信仰或行为产生有实际意义的影响。

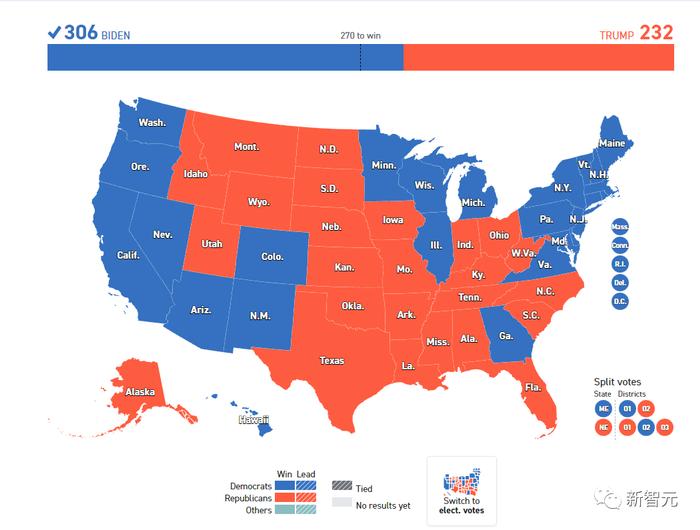

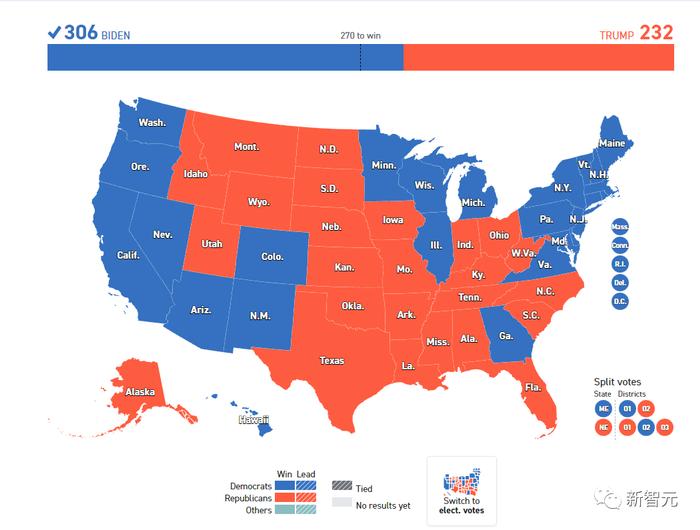

众所周知,2020年的大选,是拜登胜出。

如果细看选票的统计的话,会发现,从全美普选票来看,在计票率为97%时,拜登以50.8%的得票率超过特朗普的47.4%,拜登的优势并不是特别大。

据称,特朗普团队和拜登团队仅仅用于Facebook的「政治广告精准投放」花费,分别高达9770万美元、8210万美元。

而事实真如Meta所说的如此吗?

Meta自证清白

2020年的美国大选,到今天还是个热议的话题。

一直以来,Facebook和Ins的算法驱动着数十亿人在社交网络上看到的内容,甚至一度成为民主辩论的舞台。

三年前,Meta便开始着手研究Facebook和Ins对2020年选举的影响。

现在,发表在Science和Nature上的4篇同行评议论文中,Meta首次向公众展示了研究结果。

这些研究为Facebook和Ins的算法,如何影响用户在2020年总统大选前夕看到的内容提供了一个有趣的新视角。

布里斯托大学的心理学家Stephan Lewandowsky表示,这些实验很重大。

研究发现,美国保守派人士在Facebook上接触到的虚假新闻报道比自由派人士多得多。

但令人惊讶的是,从所有的动态中删除一切转发的内容,并没有影响用户的政治态度,或者减少他们观点的两极分化。

甚至,不让大数据推内容,就让系统推最新最火的事儿,也没用。

具体是怎么回事?

四大研究

「回音室」效应无效

在许多人看来,Meta的内容传输算法,会优先处理来自志同道合者和团体的信息,从而助长政治两极分化。

人们担心这一系统会强化互联网「回音室」,助长党派和虚假信息的传播。

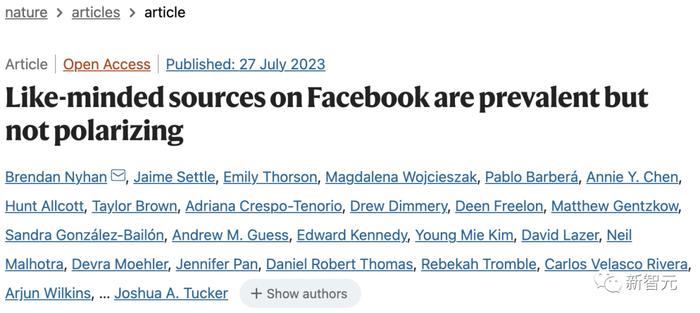

在Nature的一篇论文中,研究人员主要关注了社交媒体「回音室」在多大程度上推动政治两极分化的观点。

回音室效应,就是在说用户接触到,大量志同道合的信息来源时产生的影响。

论文地址:https://www.nature.com/articles/s41586-023-06297-w

论文地址:https://www.nature.com/articles/s41586-023-06297-w

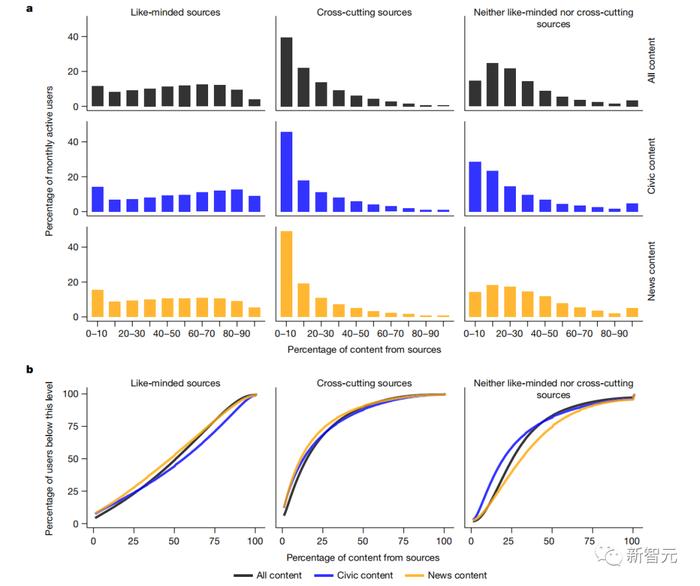

研究人员证实,大多数美国用户看到的大部分内容都来自朋友、页面和群组。但他们指出,所有这些内容都不是明确的政治或新闻相关内容。

另外,还发现,减少一致内容的数量会降低参与度,但不会显著改变用户的信仰或态度。

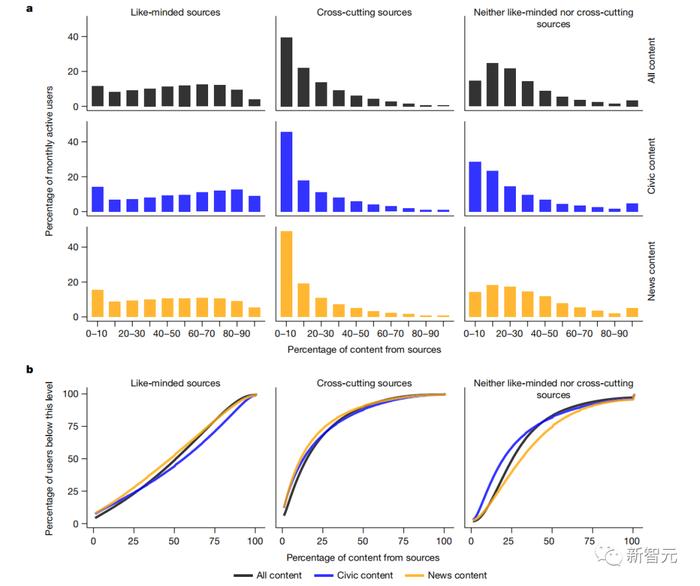

a. 美国 Facebook 月活跃成年用户在其 Facebook Feed 中接触志同道合来源、交叉来源和两类来源内容的分布情况;b. 按来源类型划分的曝光率累积分布函数。

「信息流」影响用户体验

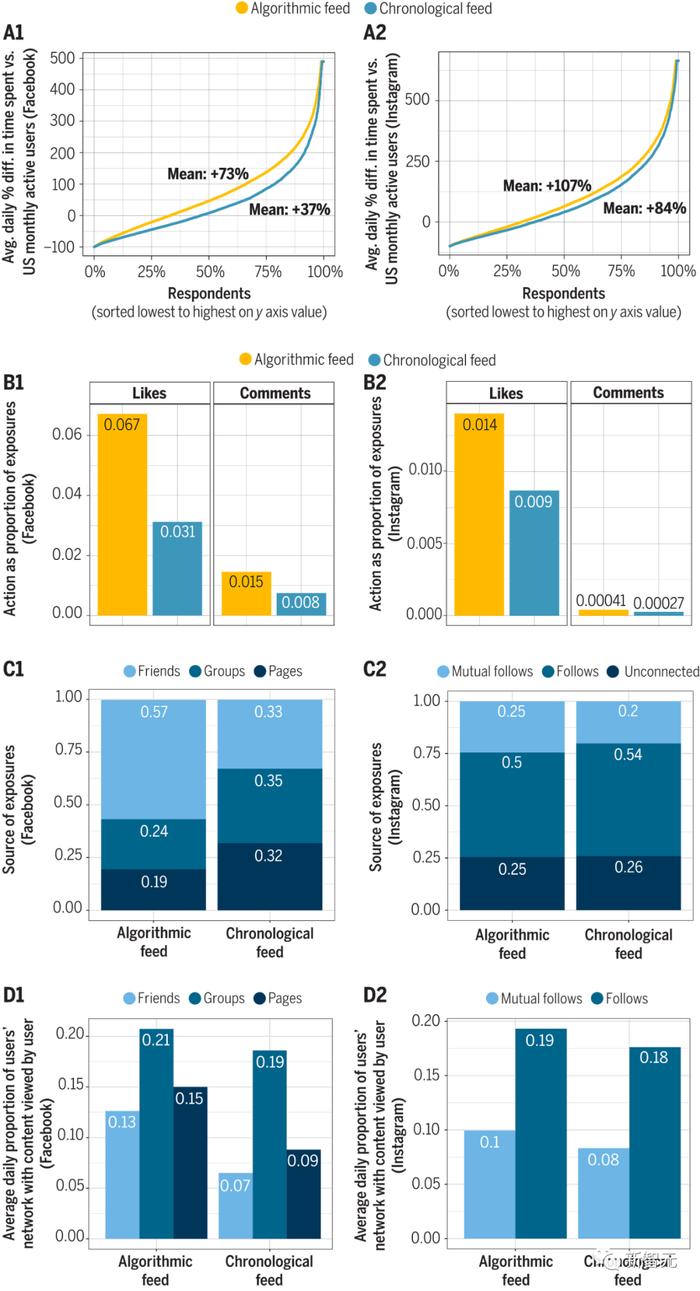

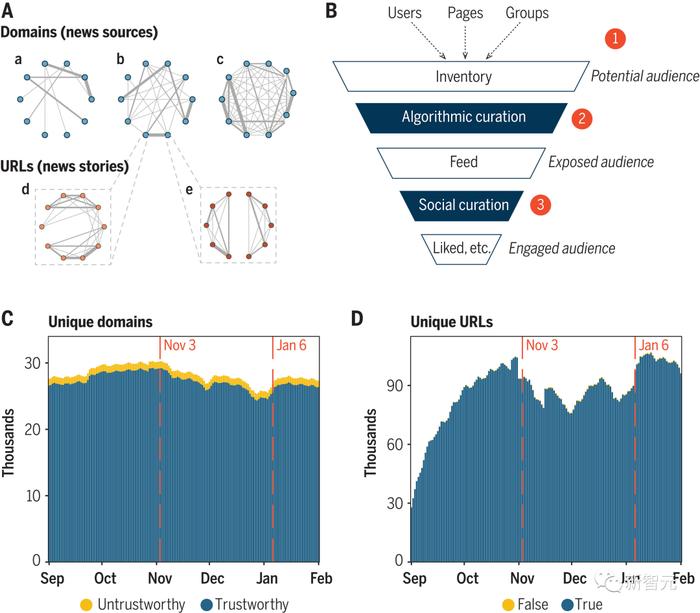

在Science的另一篇研究中,主要着眼于按时间顺序排列的信息流,与算法生成的信息流的对比效果。

研究中,23391名Facebook用户和21373名 Ins用户被分为两组:一组接收由Meta常用算法提供的精选内容,另一组按时间顺序接收新闻和信息。

其理论依据是,向用户提供最新的新闻和信息,将扩大他们看到的内容。

论文地址:https://www.science.org/doi/10.1126/science.abp9364?adobe_mc=MCMID%3D64243633531002265781381656517959855590%7CMCORGID%3D242B6472541199F70A4C98A6%2540AdobeOrg%7CTS%3D1690488631

这项研究的出的结论,Meta平台的算法信息流影响了用户的体验。

谷歌操纵大选的揭秘者Frances Haugen称,这个问题在2021年变得尤为突出,并主张回归按时间顺序排列的信息流。

另外,作者还发现,按时间顺序接收内容的参与者在Meta社交媒体平台上花费的时间更少,接触到的内容更多样化(但不一定更可信)。

不过,对两组参与者的调查显示,他们的政治极化程度没有明显差异。调查还显示,参与者的政治活动(如签署请愿书)也没有差异。

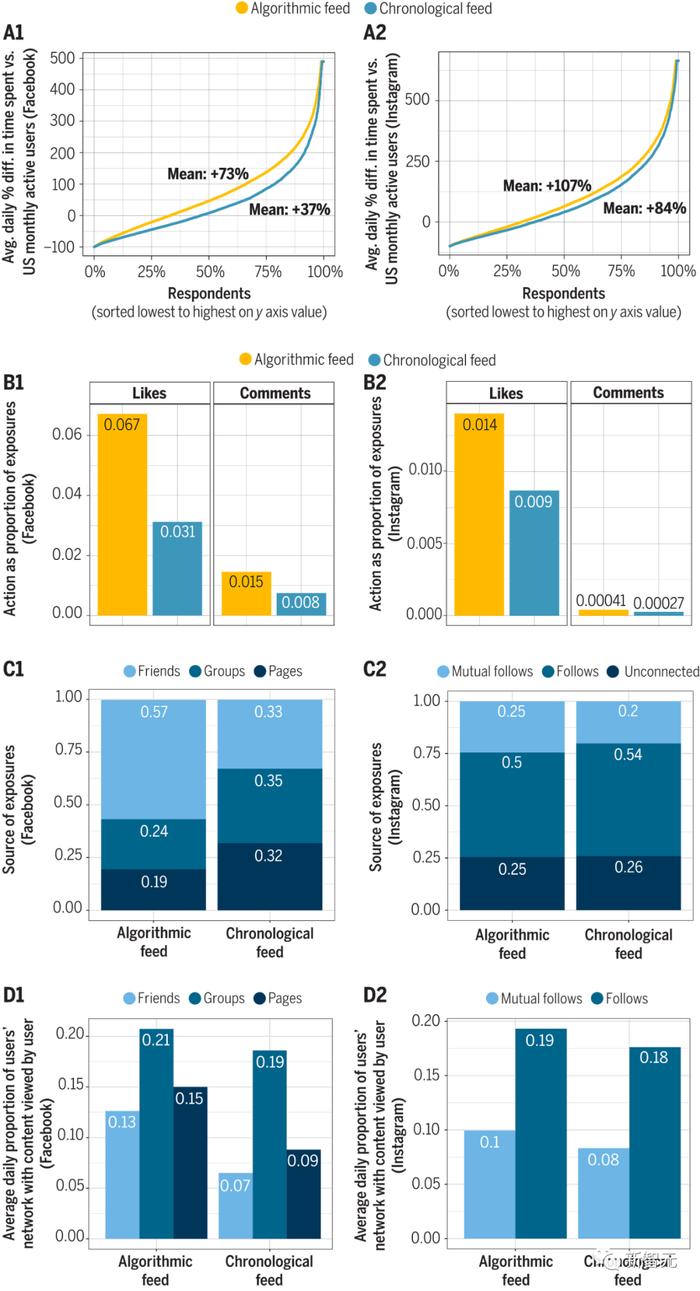

在Facebook和Ins上,按时间顺序和Algorithmic Feed条件下的用户体验和行为比较

在Facebook和Ins上,按时间顺序和Algorithmic Feed条件下的用户体验和行为比较

研究者称,按时间顺序提供的内容大大减少了用户在平台上花费的时间,降低了用户在平台上参与内容的程度,并改变了他们获得的内容组合。

同时,研究人员表示,按时间顺序提供的信息并没有引起下游政治态度、知识或离线行为的可察觉变化。

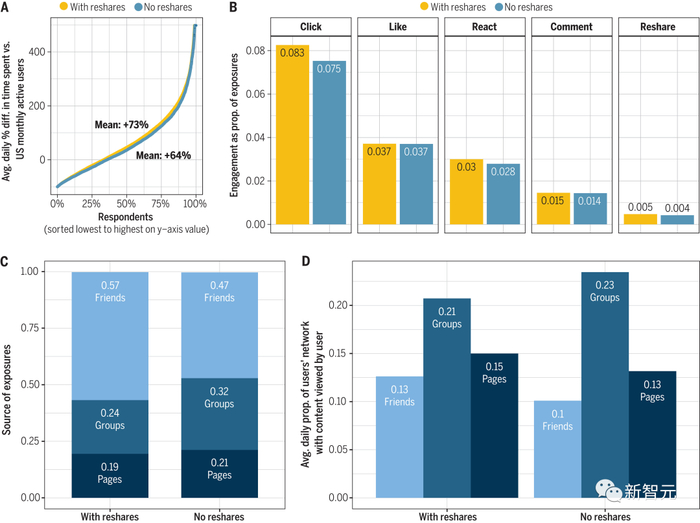

删除转发内容研究

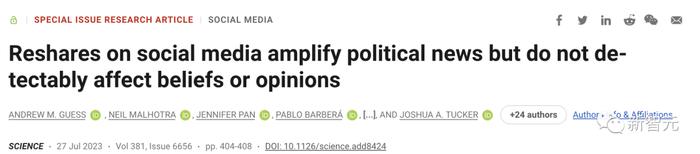

同样,另一项同样发表在Science上的研究,对2020年大选前「转发内容」的影响进行了研究。

论文地址:https://www.science.org/doi/10.1126/science.add8424?adobe_mc=MCMID%3D64243633531002265781381656517959855590%7CMCORGID%3D242B6472541199F70A4C98A6%2540AdobeOrg%7CTS%3D1690488631

结果发现,删除转发内容大大减少了政治新闻的数量,包括来自不可信来源的内容。

但并没有显著影响政治两极化,或任何个人层面政治态度的衡量标准。

无转发处理和控制条件下的用户体验和行为比较

无转发处理和控制条件下的用户体验和行为比较

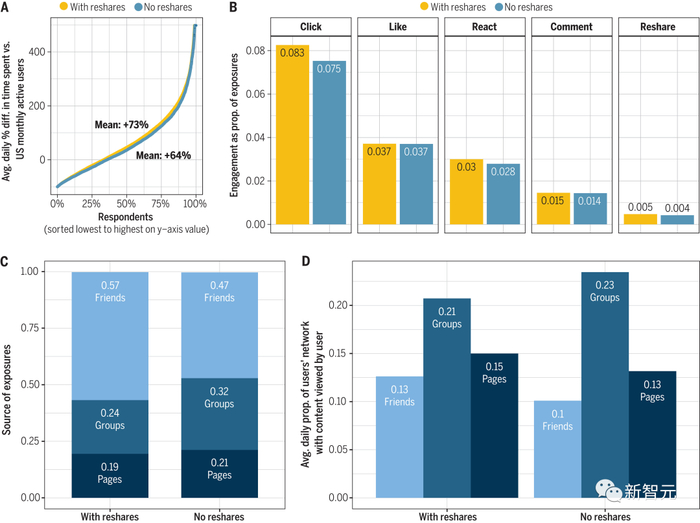

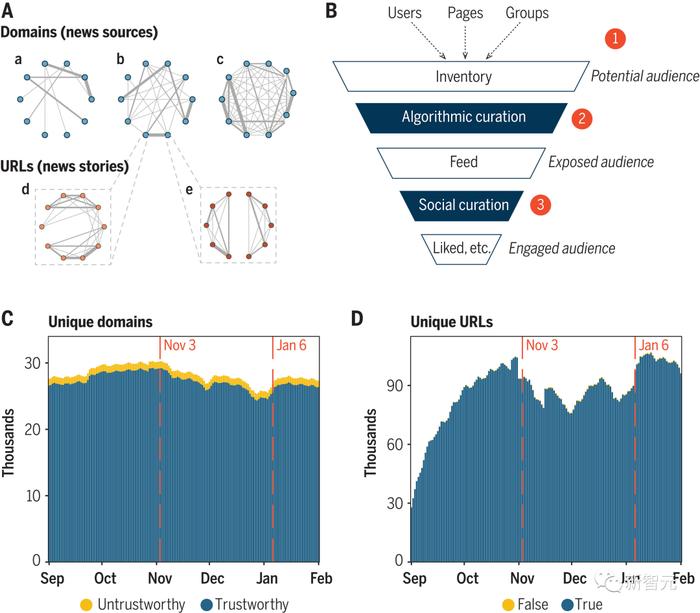

用户订阅源政治新闻分析

最后,研究人员从自由派还是保守派的角度,分析了用户订阅源中出现的政治新闻。

这项研究分析了大约2.08亿美国 Facebook用户的数据访问习惯,发现左倾和右倾用户在分享和消费信息方面存在巨大差异。

论文地址:https://www.science.org/doi/10.1126/science.ade7138?adobe_mc=MCMID%3D64243633531002265781381656517959855590%7CMCORGID%3D242B6472541199F70A4C98A6%2540AdobeOrg%7CTS%3D1690488631

他们得出的结论是,Facebook在意识形态上有实质性的隔离,但意识形态隔离在页面和群组发布的内容中的表现,远远多于好友发布的内容。

另外,研究还发现,保守派用户更有可能看到来自「不可信」来源的内容,以及被Meta的第三方事实核查机构评为虚假的文章。

总体上看,4项研究的发现,对Meta自身来说很有利,没有直接证据去表明算法操纵选举。

遗憾的是,研究人员称没有直接的解决方案,来解决社交媒体上的两极分化问题。

就像Science中所称,没有人愿意说,这意味着社交媒体没有负面影响。

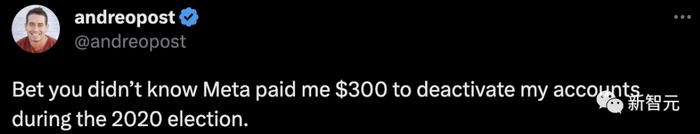

有网友称,我打赌你不知道Meta付给我300美元,让我在2020年大选期间停用账户。

Meta在官博表示,未来会发表更多一系列论文,总共16篇。

谷歌被爆用ML操控选举

Meta通过发表研究自撇清白。

不过,Meta之外,谷歌也曾深陷操纵2020大选风波中。

2019年8月,谷歌高级工程师Zachary Vorhies泄露了950页的内部文件。

文件内容直接披露了谷歌操控大选的证据:

谷歌曾使用黑名单、审查制度和机器学习算法操纵美国大选。

在这个特别的黑名单中,显示了数百个在Android/ target=_blank class=infotextkey>安卓的新闻搜索结果中被审查的保守派网站,存在明显的政治偏见。

比如,DAIly Caller、Western Journal、RedState、Gateway Pundit、Steven Crowder、Michelle Malkin、Glenn Beck、Rush Limbaugh等都被列入了黑名单。

紧接着,2021年,Vorhies出版了一本书名为《谷歌泄密: 告密者对大型科技审查制度的揭露》。

他在书中称,特朗普当选对谷歌来说是一个转折点。

2016年大选结束后,特朗普正式成为总统当选人。

无论走到哪里,Vorhies都能听到谷歌同事谈论这次选举有多不公平,并坚称需要抵制来应对特朗普和全球范围内出现的更广泛的民粹主义运动。

谷歌联合创始人Sergey Brin在一次公司全体会议上说:

我当然觉得这次选举令人深感不快,我知道你们中的许多人也是如此。然而很多人显然不认同我们所拥有的价值观。

负责谷歌全球事务的副总裁Kent Walker表示:谷歌必须努力确保「民粹主义」和「民族主义」的崛起只是历史弧线中的一个暂时现象和小插曲。

这一切证明了,谷歌在2016年大选中确实输给了特朗普。

当时,谷歌高管和员工采用了各种策略来推选希拉里•克林顿。比如通过谷歌搜索引擎帮助希拉里屏蔽不利信息。

2019年,Project Veritas公布了谷歌高管Jen Gennai被偷拍的视频。

在视频中,Jen Gennai直言不讳说要「防止2016年的事再次发生」。

之后她补充道,目前谷歌正在尝试「训练算法」,希望能模拟出一种可能改变特朗普2016年大选胜利结果的工作方式。

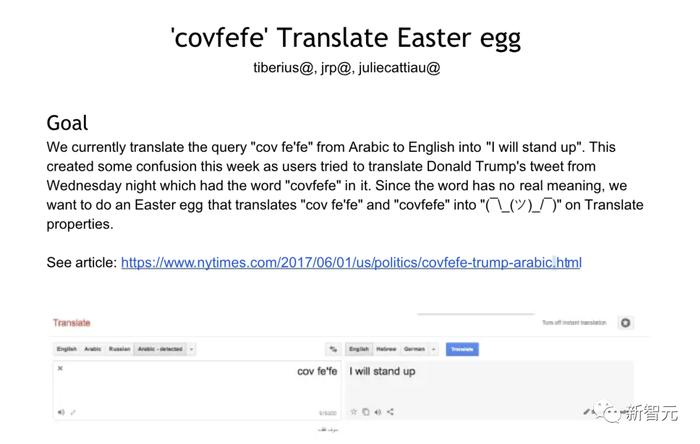

2017年5月31日,特朗普在推特上发布了一条六个字的短语,尽管有持续的负面新闻报道(Despite the constant negative press covfefe.)

其中,Covfefe是特朗普专门将coverage(报道)一词拼写错误。

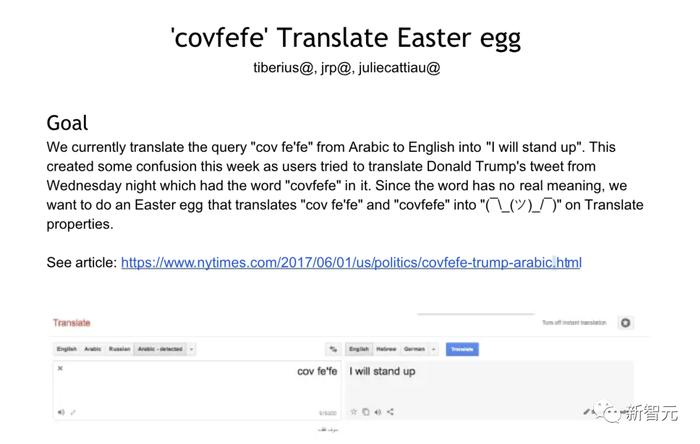

在一份被泄露的名为「covfefe Translate Easter egg」文件中,谷歌的工程师们甚至从阿拉伯语词典中删除了「covfefe」这个词以及它的意思「I will stand up」,并用耸肩表情符号取而代之,以推进他们的反特朗普政治议程。

你知道,算法究竟是如何影响美国大选的吗?

今天,「Meta的算法影响2020年美国选举」研究登上了Science封面。

Meta首次一口气发表了4篇具有里程碑意义的研究论文。

目的是为了探讨Facebook和Ins在美国2020年选举中,对关键政治态度和行为的影响。

研究发现,几乎没有证据表明,Meta平台会造成有害的 「情感」两极分化,或对关键政治态度、信仰或行为产生有实际意义的影响。

众所周知,2020年的大选,是拜登胜出。

如果细看选票的统计的话,会发现,从全美普选票来看,在计票率为97%时,拜登以50.8%的得票率超过特朗普的47.4%,拜登的优势并不是特别大。

据称,特朗普团队和拜登团队仅仅用于Facebook的「政治广告精准投放」花费,分别高达9770万美元、8210万美元。

而事实真如Meta所说的如此吗?

Meta自证清白

2020年的美国大选,到今天还是个热议的话题。

一直以来,Facebook和Ins的算法驱动着数十亿人在社交网络上看到的内容,甚至一度成为民主辩论的舞台。

三年前,Meta便开始着手研究Facebook和Ins对2020年选举的影响。

现在,发表在Science和Nature上的4篇同行评议论文中,Meta首次向公众展示了研究结果。

这些研究为Facebook和Ins的算法,如何影响用户在2020年总统大选前夕看到的内容提供了一个有趣的新视角。

布里斯托大学的心理学家Stephan Lewandowsky表示,这些实验很重大。

研究发现,美国保守派人士在Facebook上接触到的虚假新闻报道比自由派人士多得多。

但令人惊讶的是,从所有的动态中删除一切转发的内容,并没有影响用户的政治态度,或者减少他们观点的两极分化。

甚至,不让大数据推内容,就让系统推最新最火的事儿,也没用。

具体是怎么回事?

四大研究

「回音室」效应无效

在许多人看来,Meta的内容传输算法,会优先处理来自志同道合者和团体的信息,从而助长政治两极分化。

人们担心这一系统会强化互联网「回音室」,助长党派和虚假信息的传播。

在Nature的一篇论文中,研究人员主要关注了社交媒体「回音室」在多大程度上推动政治两极分化的观点。

回音室效应,就是在说用户接触到,大量志同道合的信息来源时产生的影响。

论文地址:https://www.nature.com/articles/s41586-023-06297-w

论文地址:https://www.nature.com/articles/s41586-023-06297-w

研究人员证实,大多数美国用户看到的大部分内容都来自朋友、页面和群组。但他们指出,所有这些内容都不是明确的政治或新闻相关内容。

另外,还发现,减少一致内容的数量会降低参与度,但不会显著改变用户的信仰或态度。

a. 美国 Facebook 月活跃成年用户在其 Facebook Feed 中接触志同道合来源、交叉来源和两类来源内容的分布情况;b. 按来源类型划分的曝光率累积分布函数。

「信息流」影响用户体验

在Science的另一篇研究中,主要着眼于按时间顺序排列的信息流,与算法生成的信息流的对比效果。

研究中,23391名Facebook用户和21373名 Ins用户被分为两组:一组接收由Meta常用算法提供的精选内容,另一组按时间顺序接收新闻和信息。

其理论依据是,向用户提供最新的新闻和信息,将扩大他们看到的内容。

论文地址:https://www.science.org/doi/10.1126/science.abp9364?adobe_mc=MCMID%3D64243633531002265781381656517959855590%7CMCORGID%3D242B6472541199F70A4C98A6%2540AdobeOrg%7CTS%3D1690488631

这项研究的出的结论,Meta平台的算法信息流影响了用户的体验。

谷歌操纵大选的揭秘者Frances Haugen称,这个问题在2021年变得尤为突出,并主张回归按时间顺序排列的信息流。

另外,作者还发现,按时间顺序接收内容的参与者在Meta社交媒体平台上花费的时间更少,接触到的内容更多样化(但不一定更可信)。

不过,对两组参与者的调查显示,他们的政治极化程度没有明显差异。调查还显示,参与者的政治活动(如签署请愿书)也没有差异。

在Facebook和Ins上,按时间顺序和Algorithmic Feed条件下的用户体验和行为比较

在Facebook和Ins上,按时间顺序和Algorithmic Feed条件下的用户体验和行为比较

研究者称,按时间顺序提供的内容大大减少了用户在平台上花费的时间,降低了用户在平台上参与内容的程度,并改变了他们获得的内容组合。

同时,研究人员表示,按时间顺序提供的信息并没有引起下游政治态度、知识或离线行为的可察觉变化。

删除转发内容研究

同样,另一项同样发表在Science上的研究,对2020年大选前「转发内容」的影响进行了研究。

论文地址:https://www.science.org/doi/10.1126/science.add8424?adobe_mc=MCMID%3D64243633531002265781381656517959855590%7CMCORGID%3D242B6472541199F70A4C98A6%2540AdobeOrg%7CTS%3D1690488631

结果发现,删除转发内容大大减少了政治新闻的数量,包括来自不可信来源的内容。

但并没有显著影响政治两极化,或任何个人层面政治态度的衡量标准。

无转发处理和控制条件下的用户体验和行为比较

无转发处理和控制条件下的用户体验和行为比较

用户订阅源政治新闻分析

最后,研究人员从自由派还是保守派的角度,分析了用户订阅源中出现的政治新闻。

这项研究分析了大约2.08亿美国 Facebook用户的数据访问习惯,发现左倾和右倾用户在分享和消费信息方面存在巨大差异。

论文地址:https://www.science.org/doi/10.1126/science.ade7138?adobe_mc=MCMID%3D64243633531002265781381656517959855590%7CMCORGID%3D242B6472541199F70A4C98A6%2540AdobeOrg%7CTS%3D1690488631

他们得出的结论是,Facebook在意识形态上有实质性的隔离,但意识形态隔离在页面和群组发布的内容中的表现,远远多于好友发布的内容。

另外,研究还发现,保守派用户更有可能看到来自「不可信」来源的内容,以及被Meta的第三方事实核查机构评为虚假的文章。

总体上看,4项研究的发现,对Meta自身来说很有利,没有直接证据去表明算法操纵选举。

遗憾的是,研究人员称没有直接的解决方案,来解决社交媒体上的两极分化问题。

就像Science中所称,没有人愿意说,这意味着社交媒体没有负面影响。

有网友称,我打赌你不知道Meta付给我300美元,让我在2020年大选期间停用账户。

Meta在官博表示,未来会发表更多一系列论文,总共16篇。

谷歌被爆用ML操控选举

Meta通过发表研究自撇清白。

不过,Meta之外,谷歌也曾深陷操纵2020大选风波中。

2019年8月,谷歌高级工程师Zachary Vorhies泄露了950页的内部文件。

文件内容直接披露了谷歌操控大选的证据:

谷歌曾使用黑名单、审查制度和机器学习算法操纵美国大选。

在这个特别的黑名单中,显示了数百个在安卓的新闻搜索结果中被审查的保守派网站,存在明显的政治偏见。

比如,Daily Caller、Western Journal、RedState、Gateway Pundit、Steven Crowder、Michelle Malkin、Glenn Beck、Rush Limbaugh等都被列入了黑名单。

紧接着,2021年,Vorhies出版了一本书名为《谷歌泄密: 告密者对大型科技审查制度的揭露》。

他在书中称,特朗普当选对谷歌来说是一个转折点。

2016年大选结束后,特朗普正式成为总统当选人。

无论走到哪里,Vorhies都能听到谷歌同事谈论这次选举有多不公平,并坚称需要抵制来应对特朗普和全球范围内出现的更广泛的民粹主义运动。

谷歌联合创始人Sergey Brin在一次公司全体会议上说:

我当然觉得这次选举令人深感不快,我知道你们中的许多人也是如此。然而很多人显然不认同我们所拥有的价值观。

负责谷歌全球事务的副总裁Kent Walker表示:谷歌必须努力确保「民粹主义」和「民族主义」的崛起只是历史弧线中的一个暂时现象和小插曲。

这一切证明了,谷歌在2016年大选中确实输给了特朗普。

当时,谷歌高管和员工采用了各种策略来推选希拉里•克林顿。比如通过谷歌搜索引擎帮助希拉里屏蔽不利信息。

2019年,Project Veritas公布了谷歌高管Jen Gennai被偷拍的视频。

在视频中,Jen Gennai直言不讳说要「防止2016年的事再次发生」。

之后她补充道,目前谷歌正在尝试「训练算法」,希望能模拟出一种可能改变特朗普2016年大选胜利结果的工作方式。

2017年5月31日,特朗普在推特上发布了一条六个字的短语,尽管有持续的负面新闻报道(Despite the constant negative press covfefe.)

其中,Covfefe是特朗普专门将coverage(报道)一词拼写错误。

在一份被泄露的名为「covfefe Translate Easter egg」文件中,谷歌的工程师们甚至从阿拉伯语词典中删除了「covfefe」这个词以及它的意思「I will stand up」,并用耸肩表情符号取而代之,以推进他们的反特朗普政治议程。

由此看来,谷歌有权决定美国公民看到什么内容,不会看到哪些内容。

美国将在2024年再次开启大选,而这次比以往更加不同。

生成式AI的大爆发, 让许多媒体预测,这将成为美国第一场广泛使用AI工具的选举。

AI对选举的影响让许多人坐立不安,ChatGPT、Midjourney、Gen-2等工具能够瞬时生成以假乱真的图片、视频、音频等宣传材料。

这场技术政治大战,最终的结果就是利用AI欺骗选民,影响真正的选举结果。