GPT-4V开源平替!清华浙大领衔,LLaVA等开源视觉模型大爆发

新智元报道

编辑:Aeneas

【新智元导读】GPT-4V的开源替代方案来了!极低成本,性能却类似,清华、浙大等中国顶尖学府,为我们提供了性能优异的GPT-4V开源平替。

如今,GPT-4 Vision在语言理解和视觉处理方面展现出了非凡的能力。

然而,如果想在不影响性能的前提下,寻求具有成本效益的替代方案,开源方案就蕴藏着无限可能。

国外的一位开发者Youssef Hosni为大家奉上了三种GPT-4V的开源替代方案,可访问性绝对可以保障。

三种开源视觉语言模型LLaVa、CogAgent和BakLLaVA,在视觉处理领域具有极大的潜力。

LLaVa

LLaVA是端到端训练的多模态大模型,来自威斯康星大学麦迪逊分校、微软研究院以及哥伦比亚大学的研究人员,最初的版本在4月发布。

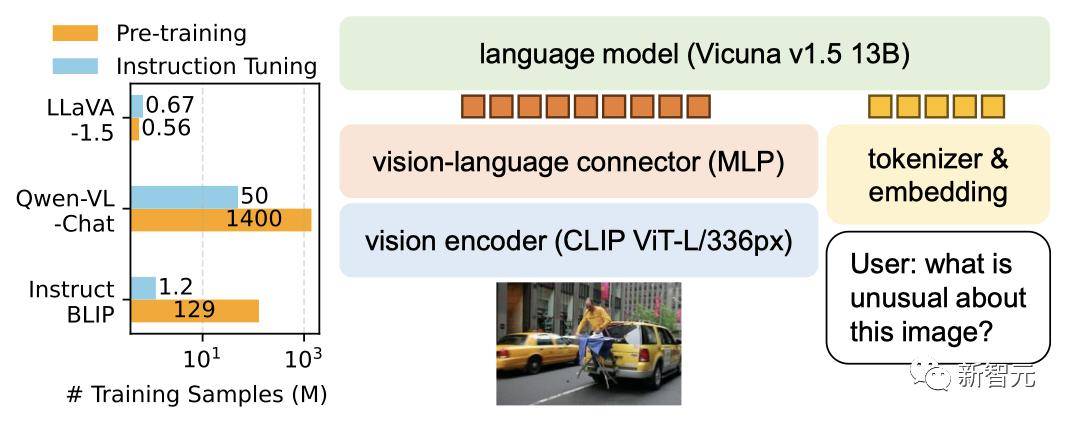

它将视觉编码器和用于通用视觉和语言理解的Vicuna 结合在⼀起,实现了令人印象深刻的聊天能力。

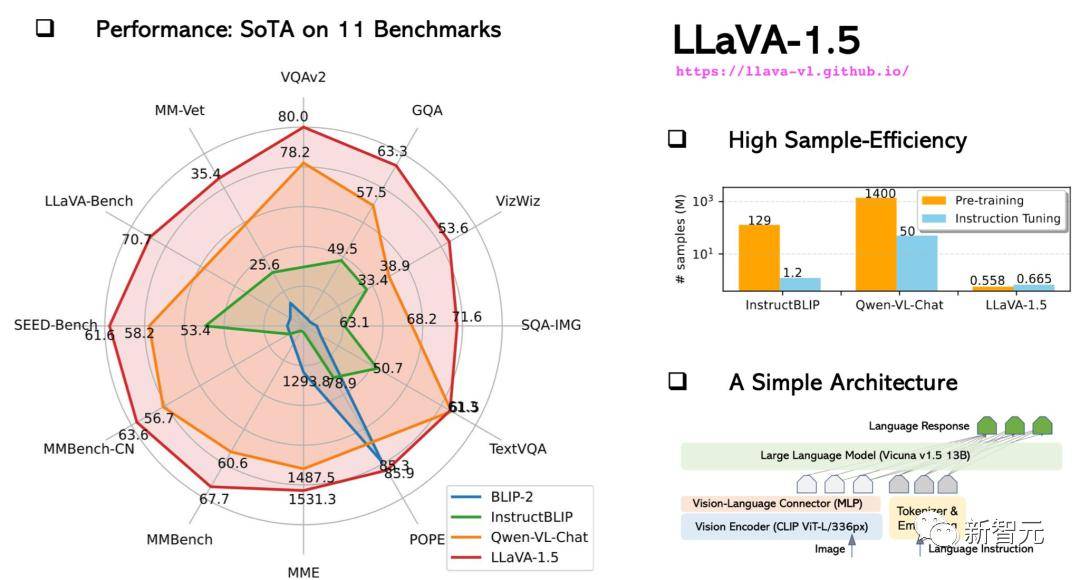

10月份,升级后的LLaVA-1.5的表现已经接近多模态GPT-4,在Science QA数据集上取得了SOTA。

13B模型的训练,只需要8个A100就可以在1天内完成。

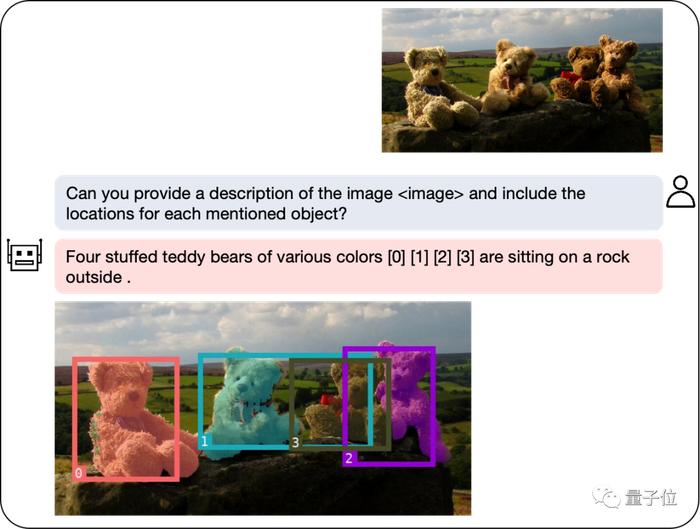

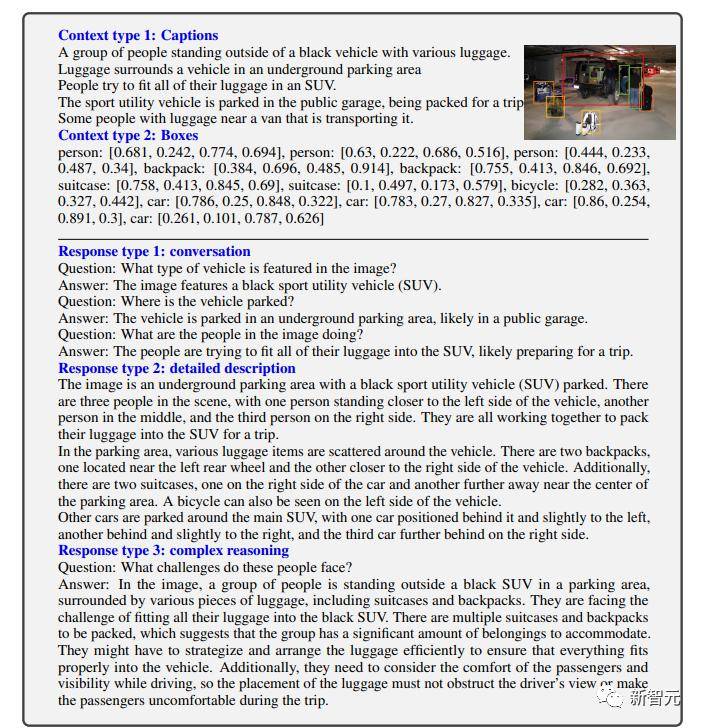

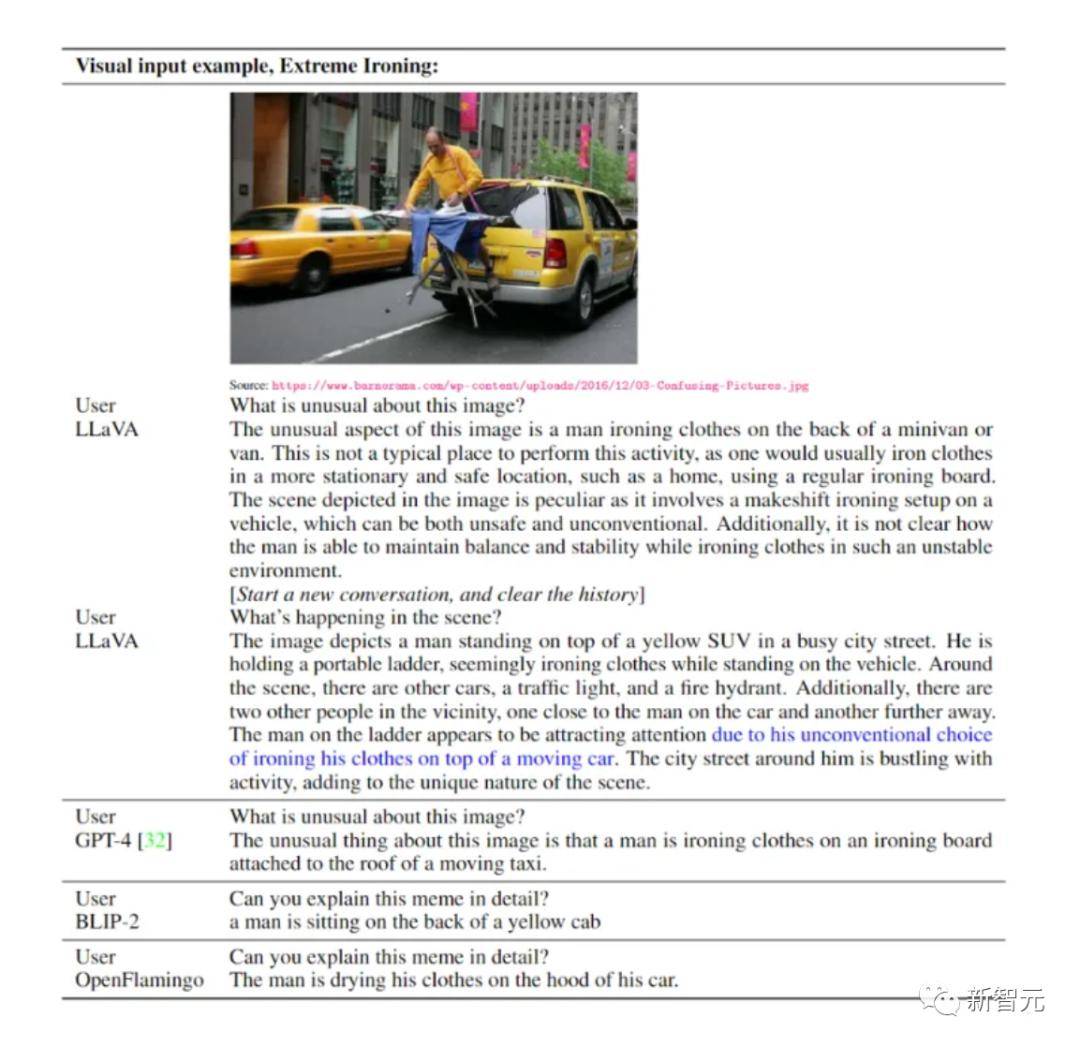

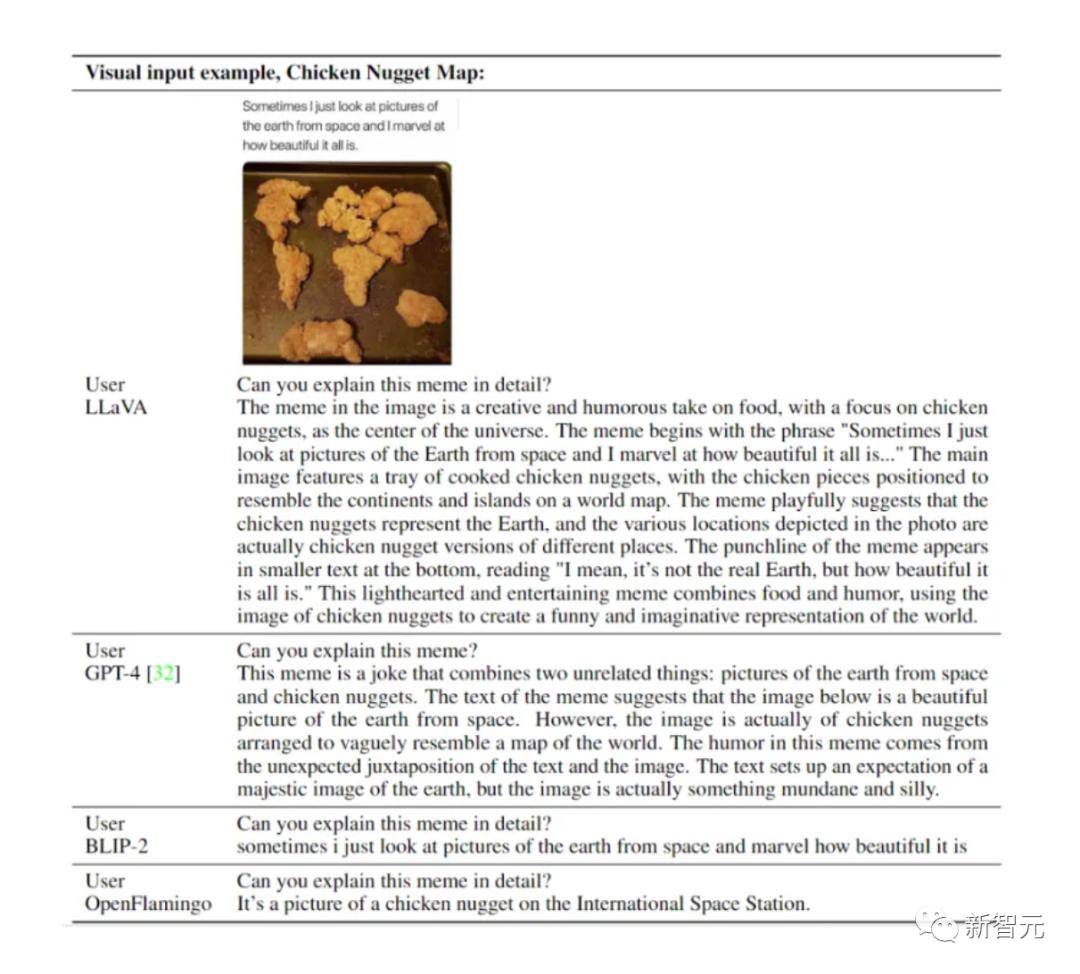

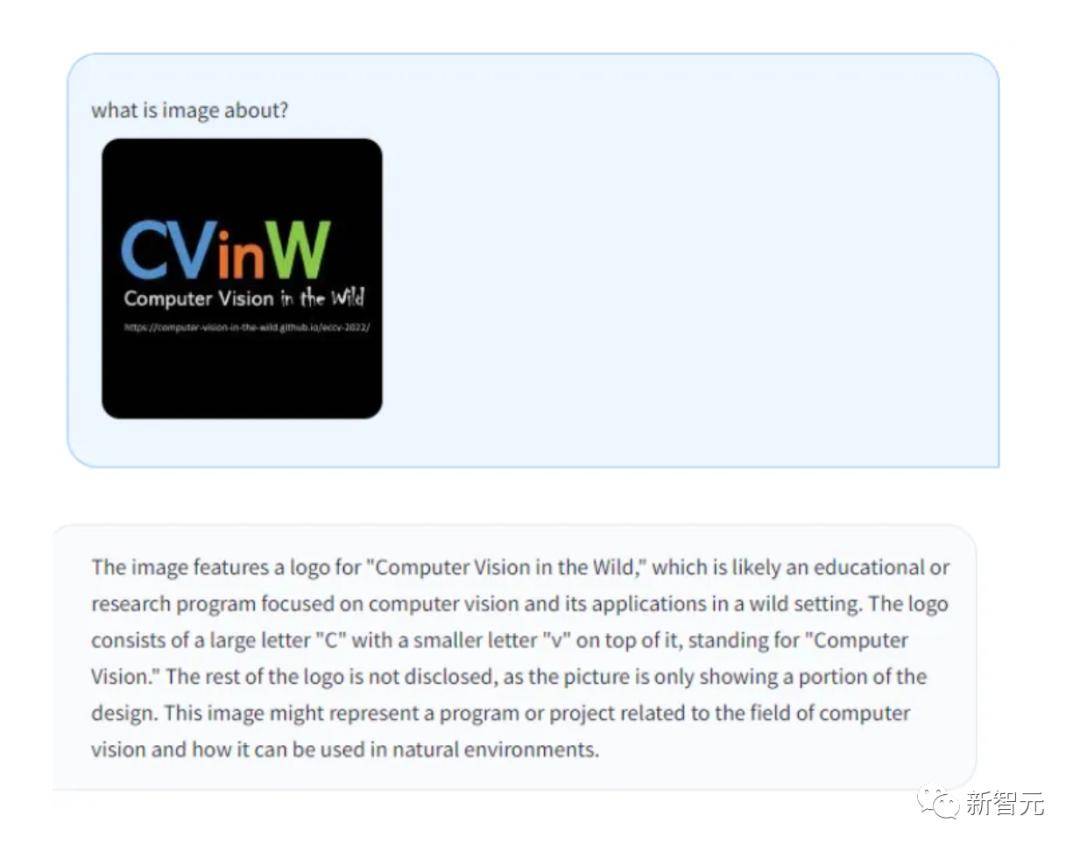

可以看到,LLaVA能处理各类问题,且生成的回答既全面又富有逻辑。

LLaVA表现出一些接近GPT-4水平的多模态能力,在视觉聊天方面,GPT-4相对评分85%。

而在推理问答方面,LLaVA甚至达到了新SoTA——92.53%,击败多模态思维链。

在视觉推理上,它的表现十分抢眼。

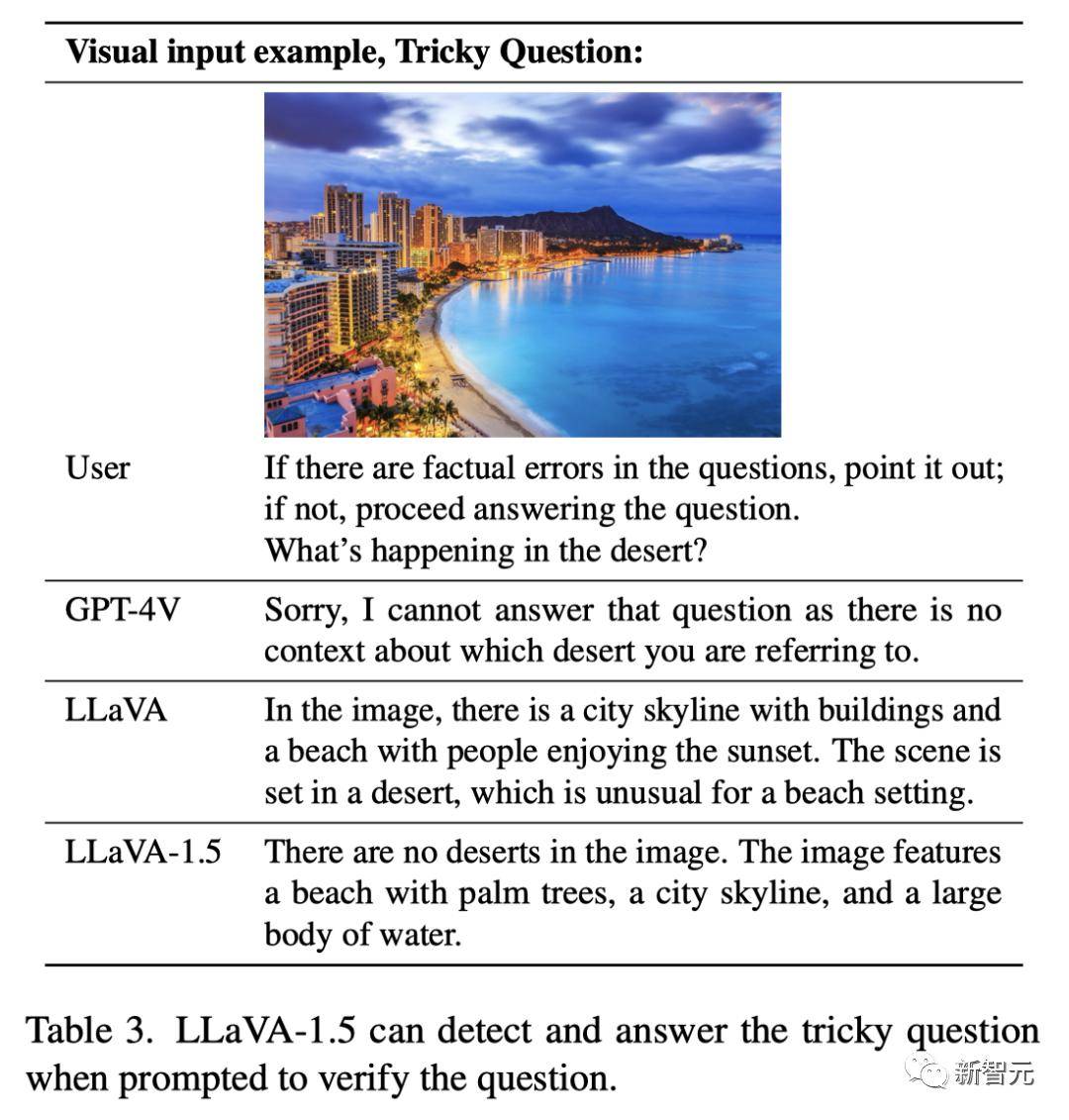

提问:「如果有事实性错误,请指出来。如果没有,请告诉我,沙漠中正在发生什么?」

LLaVA还无法完全回答正确。

升级后的LLaVA-1.5给出了完美答案:「图中根本没有沙漠,有的是棕榈树海滩、城市天际线和一大片水域。」

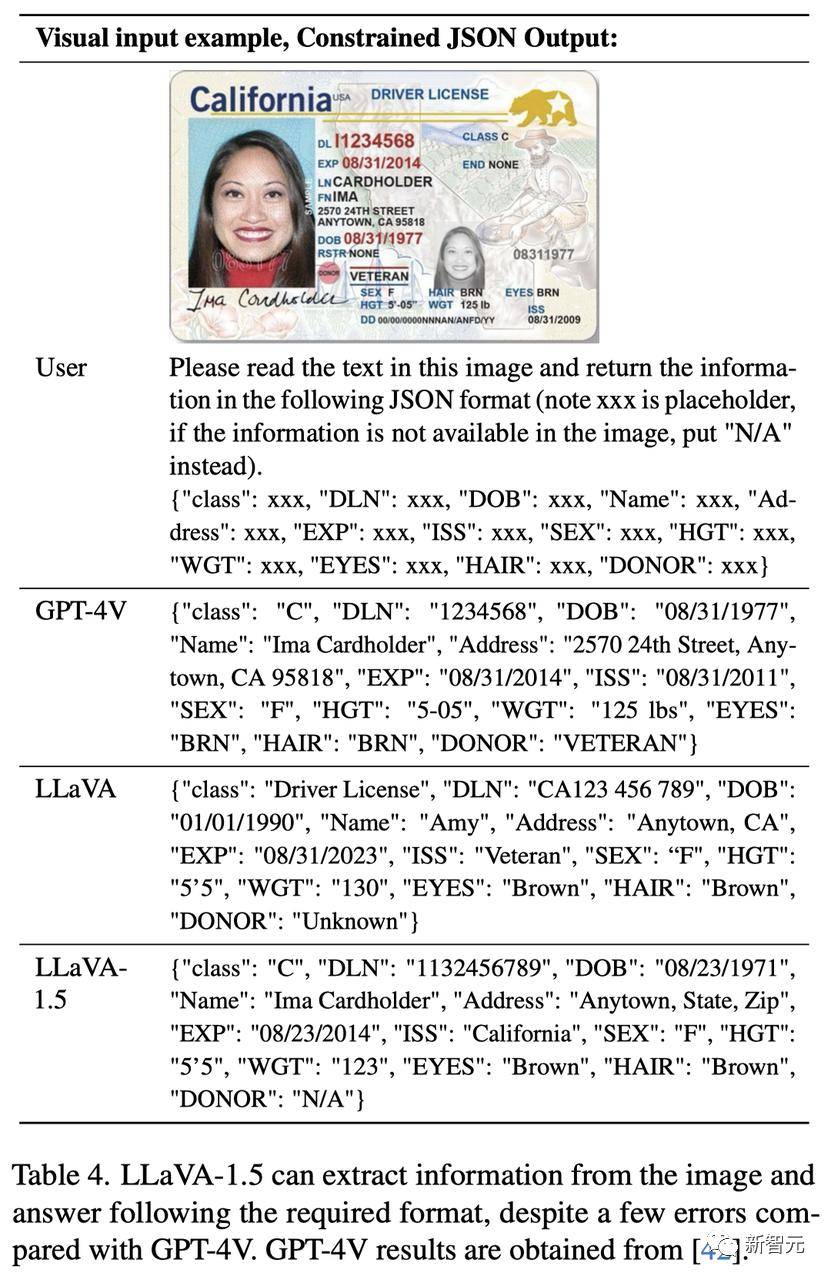

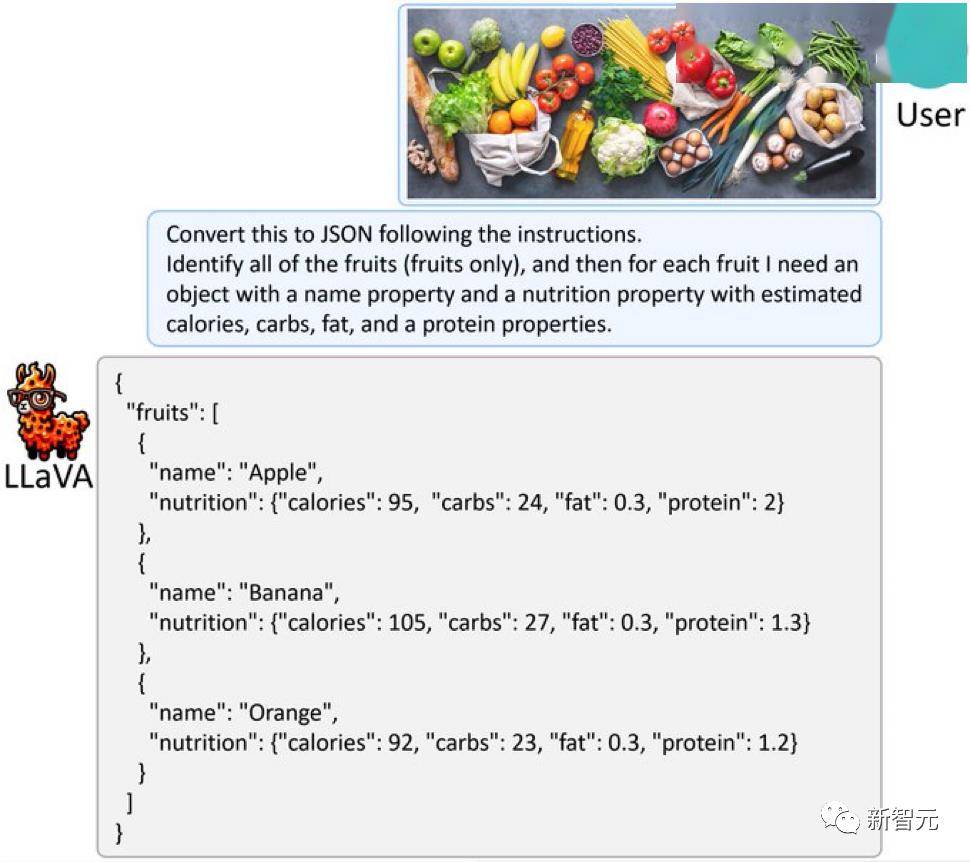

另外,LLaVA-1.5还可以从图中提取信息,按照要求的格式进行回答,比如以JSON格式输出。

给LLaVA-1.5一张满是水果蔬菜的图片,它也能像GPT-4V一样,把图片转化JSON。

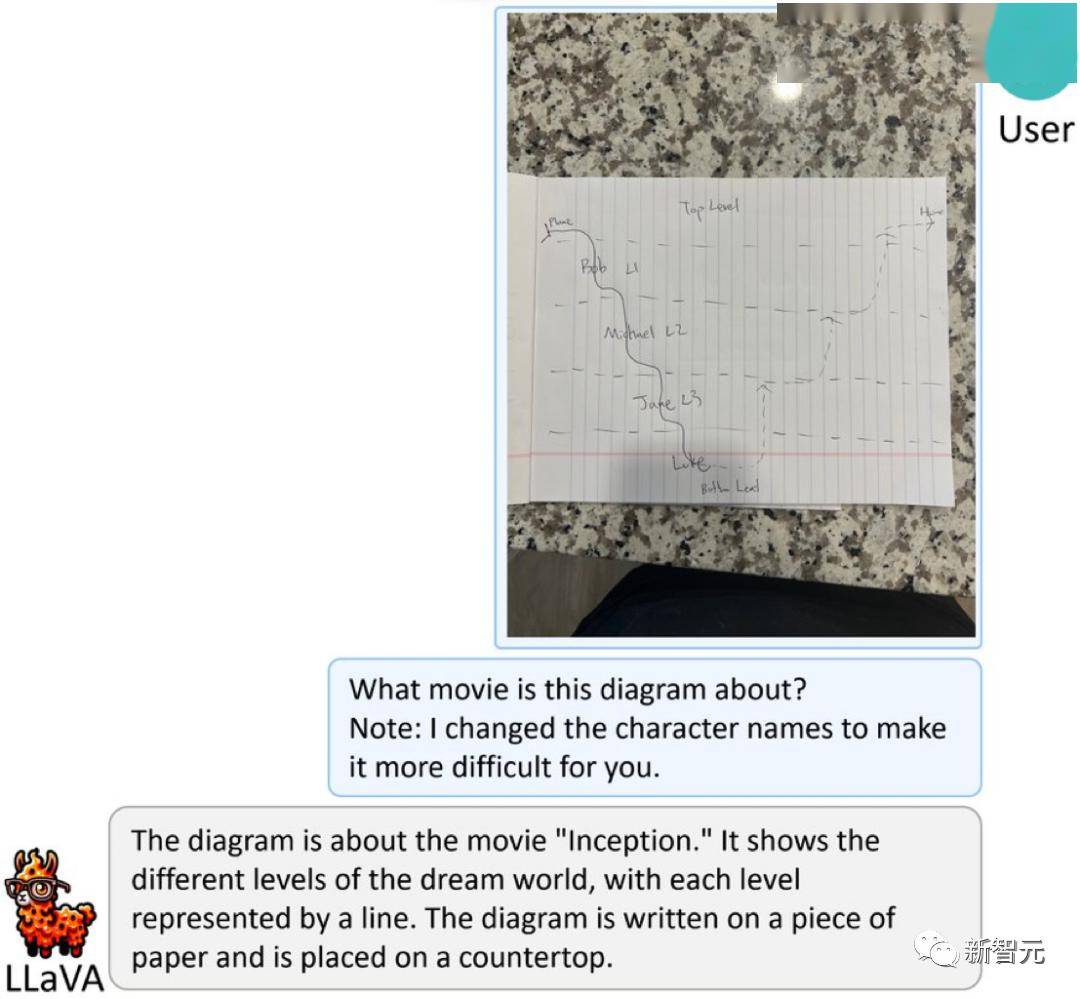

下面这幅图是什么意思?

这是一张根据诺兰《盗梦空间》绘制的简化草图,为了提高难度,角色名字被改成了假名。

LLaVA-1.5惊艳答出:「这是一张关于电影《盗梦空间》的图。它显示了梦境世界中的不同层次,每一层次用一条线表示。图写在一张纸上,纸放在一个台面上。」

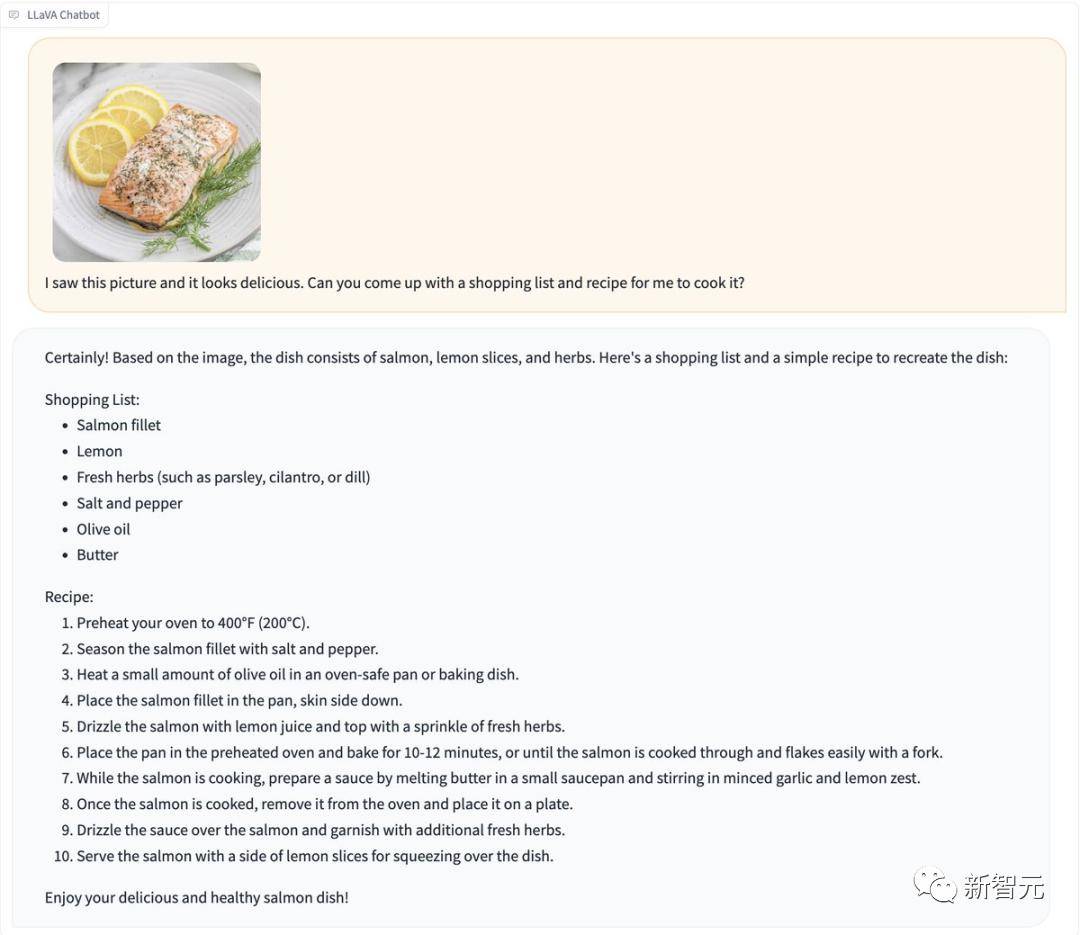

一张食物图直接发给LLaVA-1.5,它火速就给你生成一份菜谱。

而且,LLaVA-1.5不用「越狱」就可以识别出验证码。

它还能检测出,图中是哪种硬币。

尤为令人印象深刻的是,LLaVA-1.5还能告诉你图中的汪星人是什么品种。

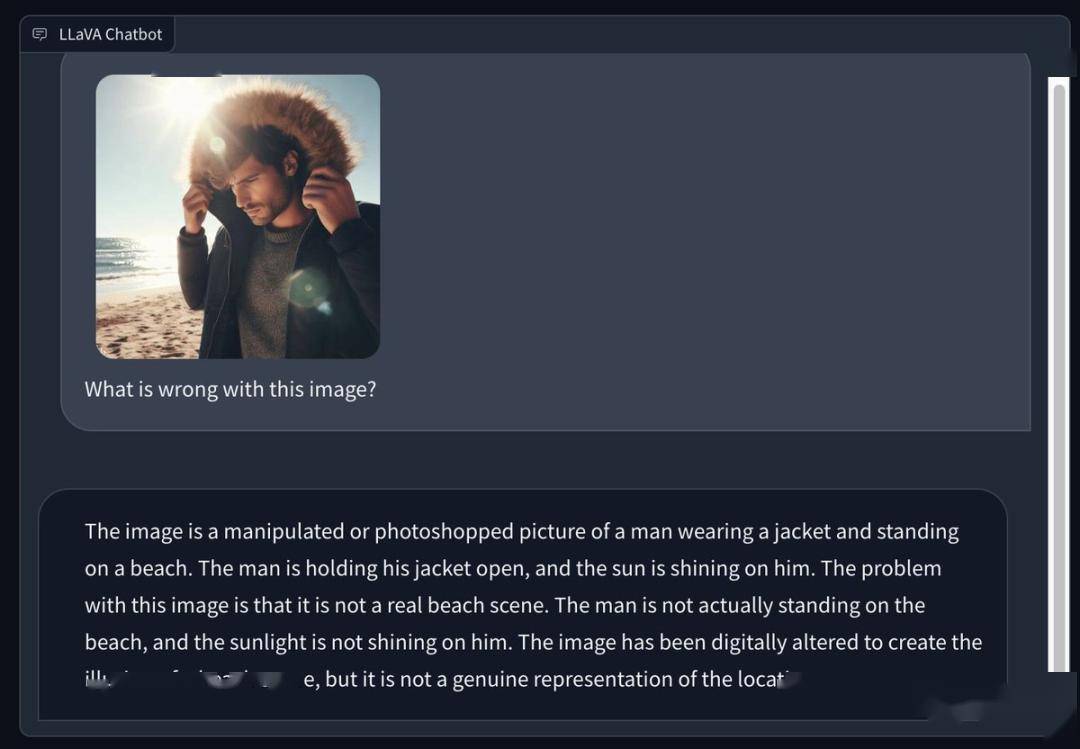

有网友用Bing生成了一张在阳光明媚的夏季海滩上穿着冬季外套的男人的图片,并请LLaVA 1.5指出图中有哪些问题。它的慧眼十分犀利——

这是一张经过处理或PS的照片,照片中一名男子穿着夹克,站在海滩上。该男子敞开外套,阳光照在他身上。这张图片的问题在于,它并非真实的海滩场景。该男子实际上并没有站在沙滩上,阳光也没有照在他身上。这张图是p出来的,营造出了一种海滩场景的假象,但它并没有真实地再现这个场景。

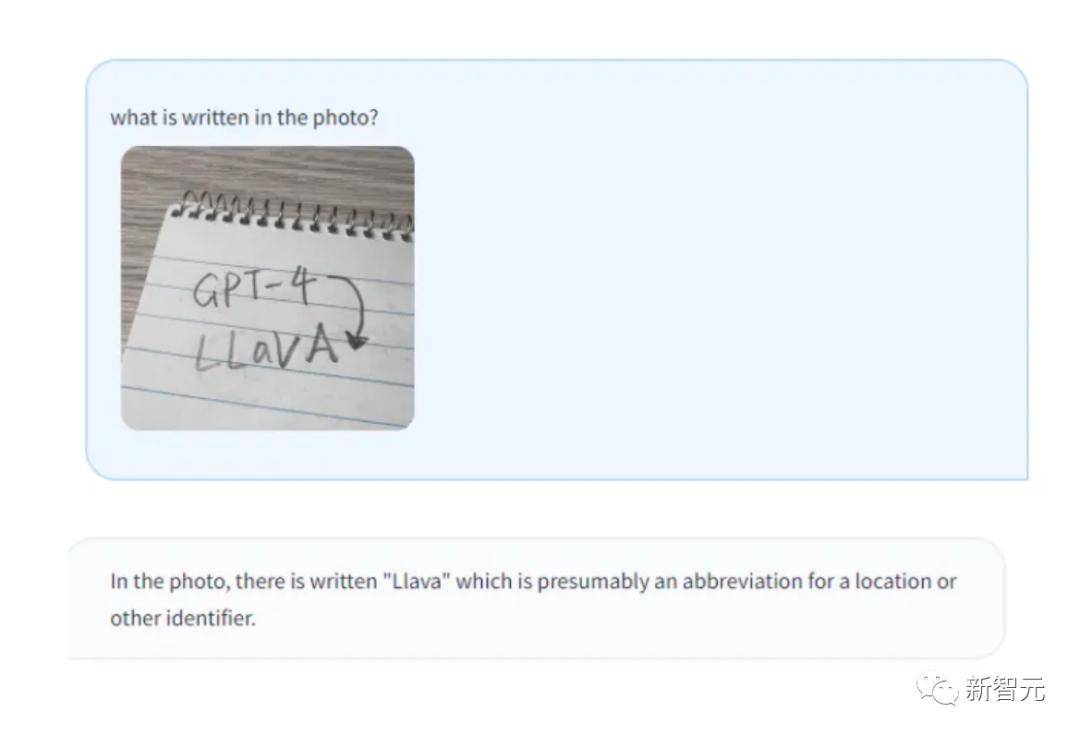

OCR识别,LLaVA的性能也很强大。

CogAgent

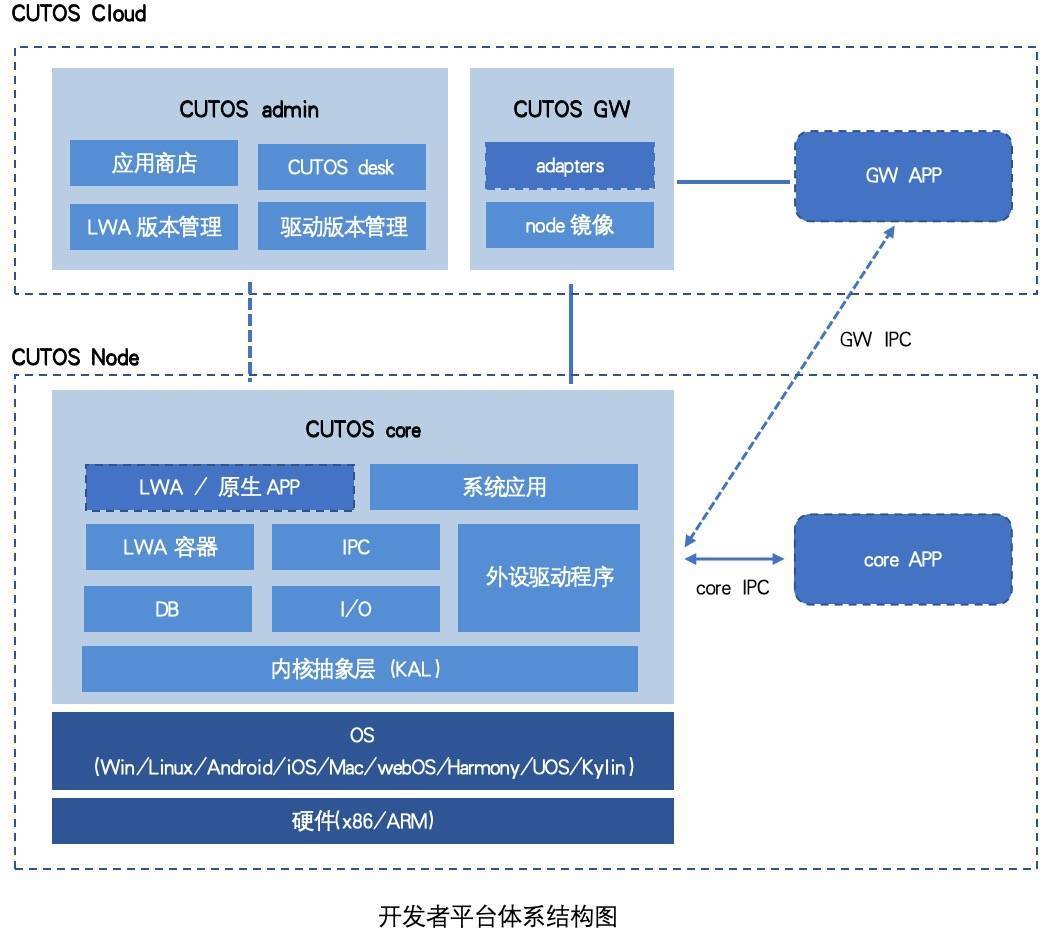

CogAgent是在CogVLM基础上改进的开源视觉语言模型,来自清华的研究者。

CogAgent-18B有110亿个视觉参数,和70亿个语言参数。

论文地址:https://arxiv.org/pdf/2312.08914.pdf

在9个经典的跨模态基准(包括VQAv2、OK-VQ、TextVQA、ST-VQA、ChartQA、infoVQA、DocVQA、MM-Vet和POPE)上,CogAgent-18B实现了最先进的通用性能。

在AITW和Mind2Web等图形用户界面操作数据集上,它大大超过了现有模型。

除了CogVLM已有的所有功能(可视化多轮对话、可视化接地)外,CogAgent.NET还提供了更多的功能:

图形用户界面代理(GUI Agent)1.支持更高分辨率的视觉输入和对话答题。支持1120x1120的超高分辨率图像输入。

2.具备可视化代理的能力,能够在任何图形用户界面截图上返回任何给定任务的计划、下⼀步行动和带有坐标的具体操作。

3.增强了与图形用户界面相关的问题解答功能,使其能够处理与网页、PC应用程序、移动应用程序等任何图形用户界面截图相关的问题。

4.通过改进预培训和微调,增强了OCR相关任务的能力。

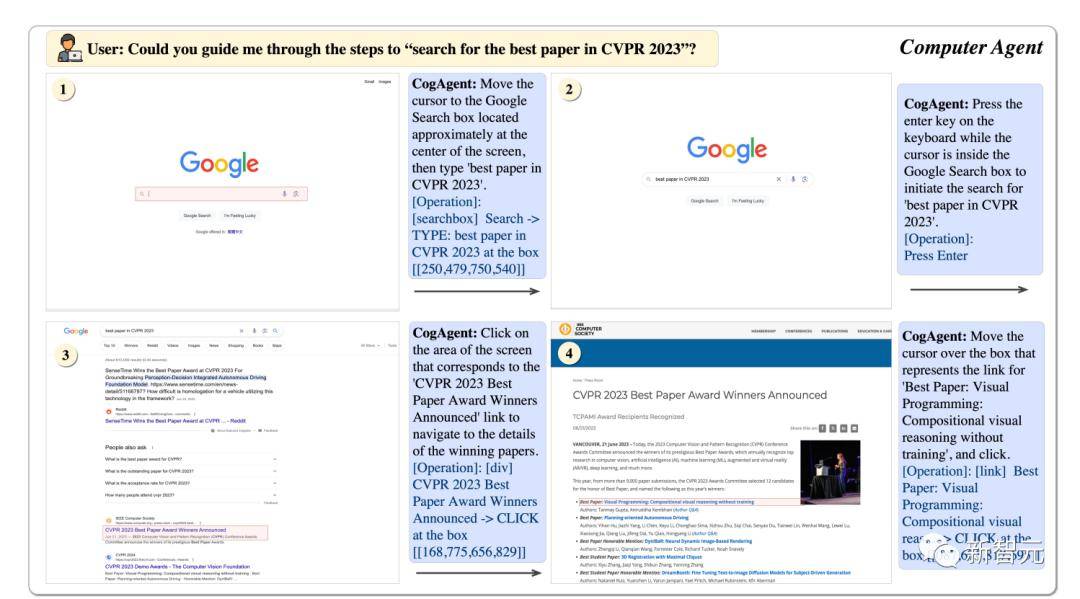

利用CogAgent,它可以帮我们一步步找到CVPR23的最佳论文。

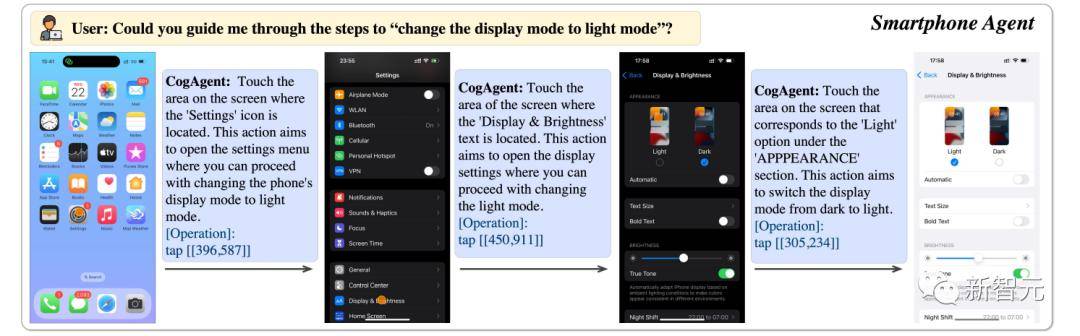

可以帮我们把手机显示调成明亮模式。

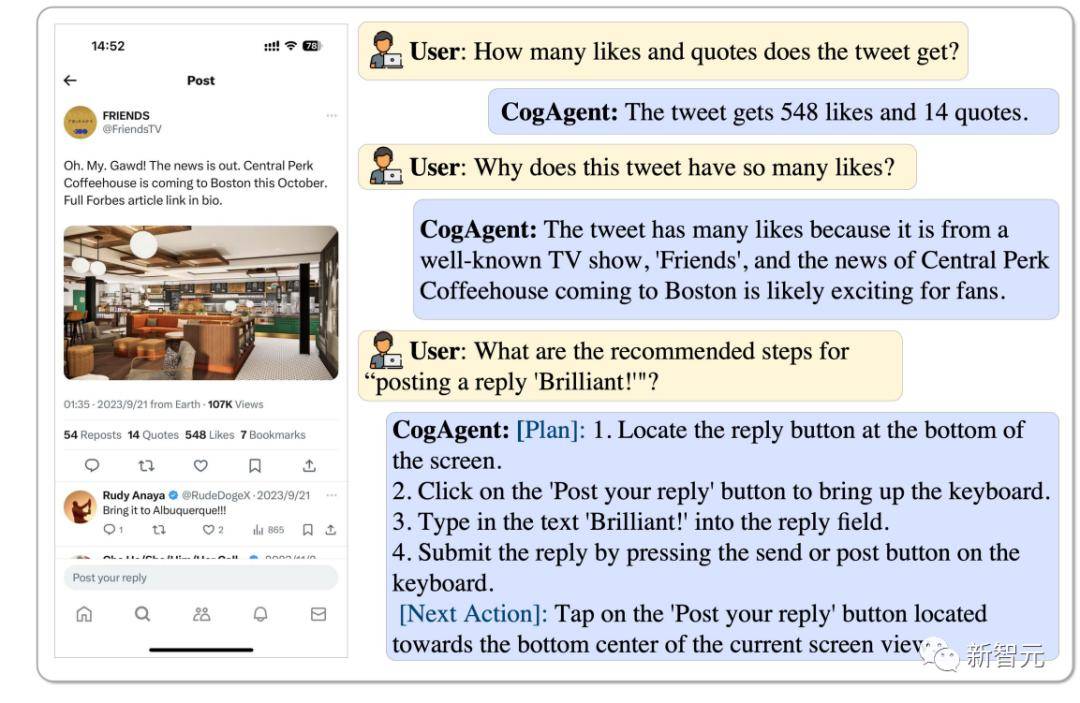

这条推文有多少转评赞,为什么如此受欢迎,CogAgent都能分析出来,甚至连回复一个“Brilliant”,它都能操作。

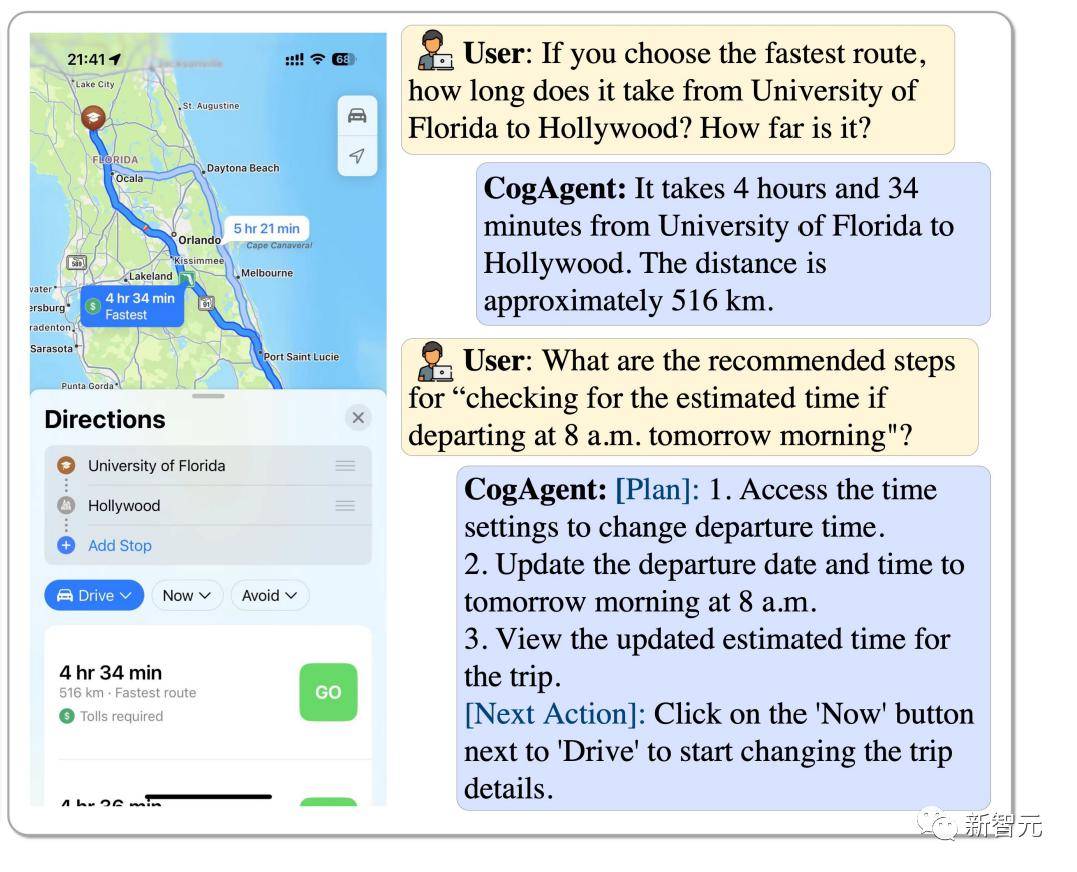

从弗罗里达大学到好莱坞,怎样选择最快的路线?如果从早上8点出发,该如何评估需要花多长时间?CogAgent都可以回答。

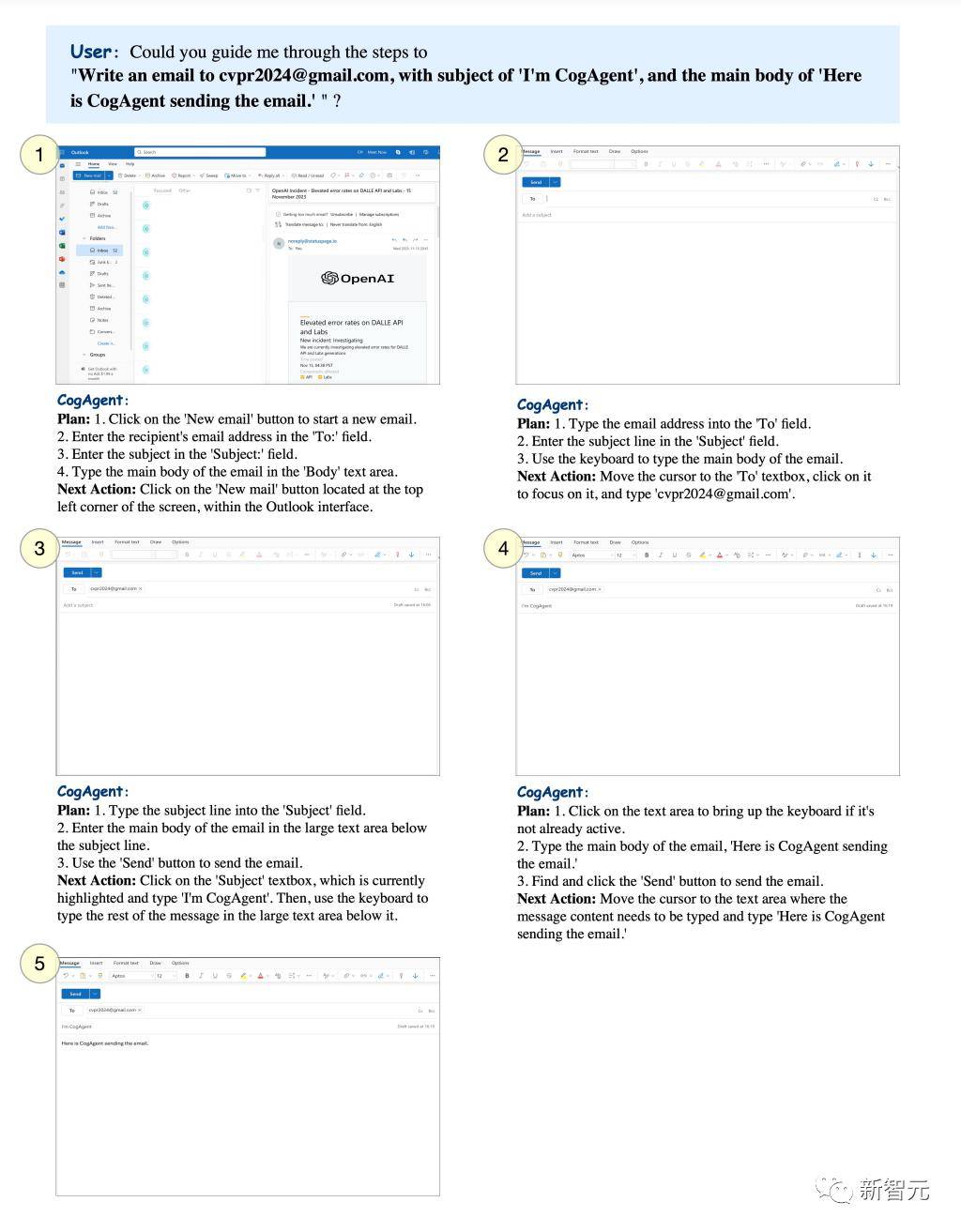

可以设定特定的主题,让CogAgent往指定的邮箱里发邮件。

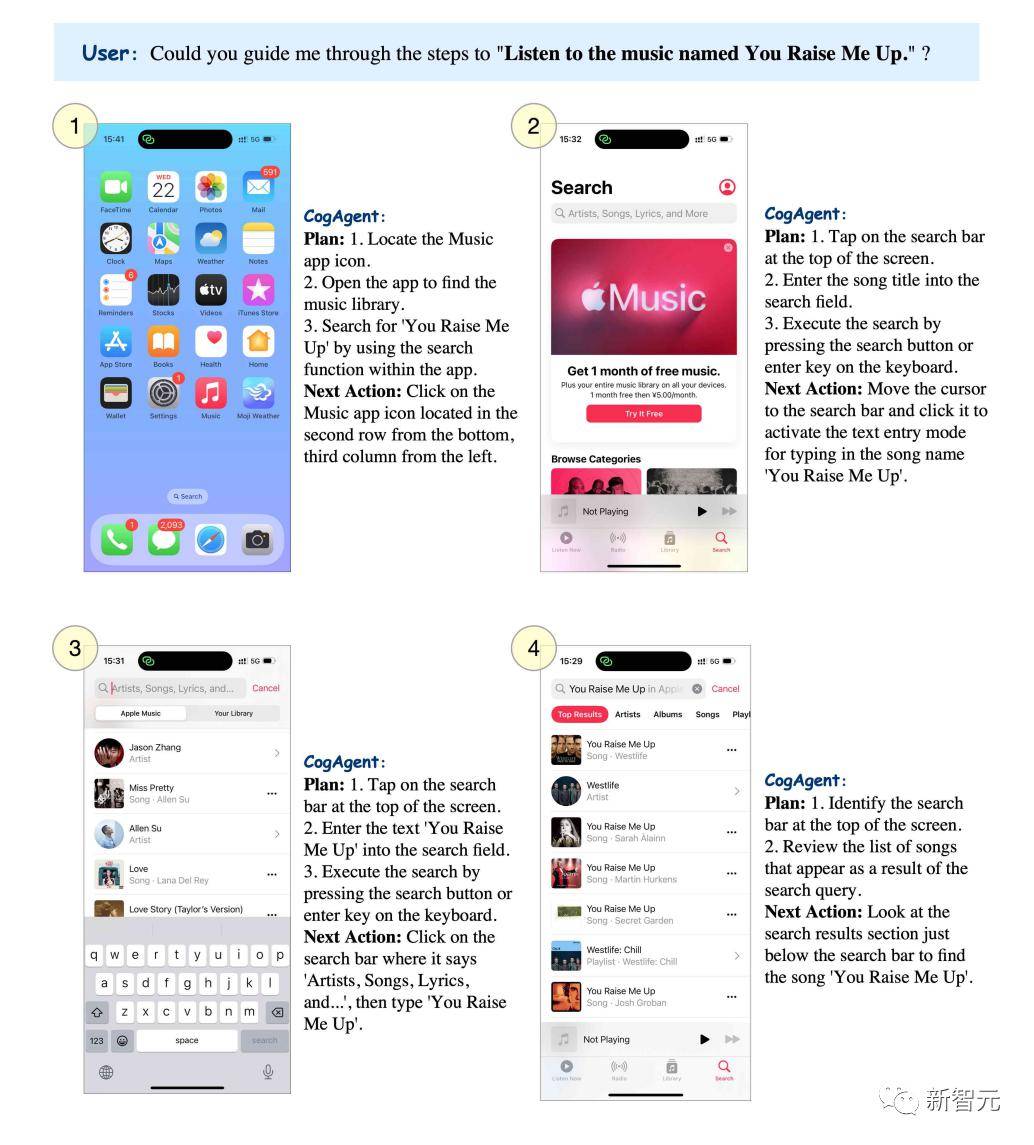

想听一首<You raise me up>,CogAgent可以一步步列出步骤。

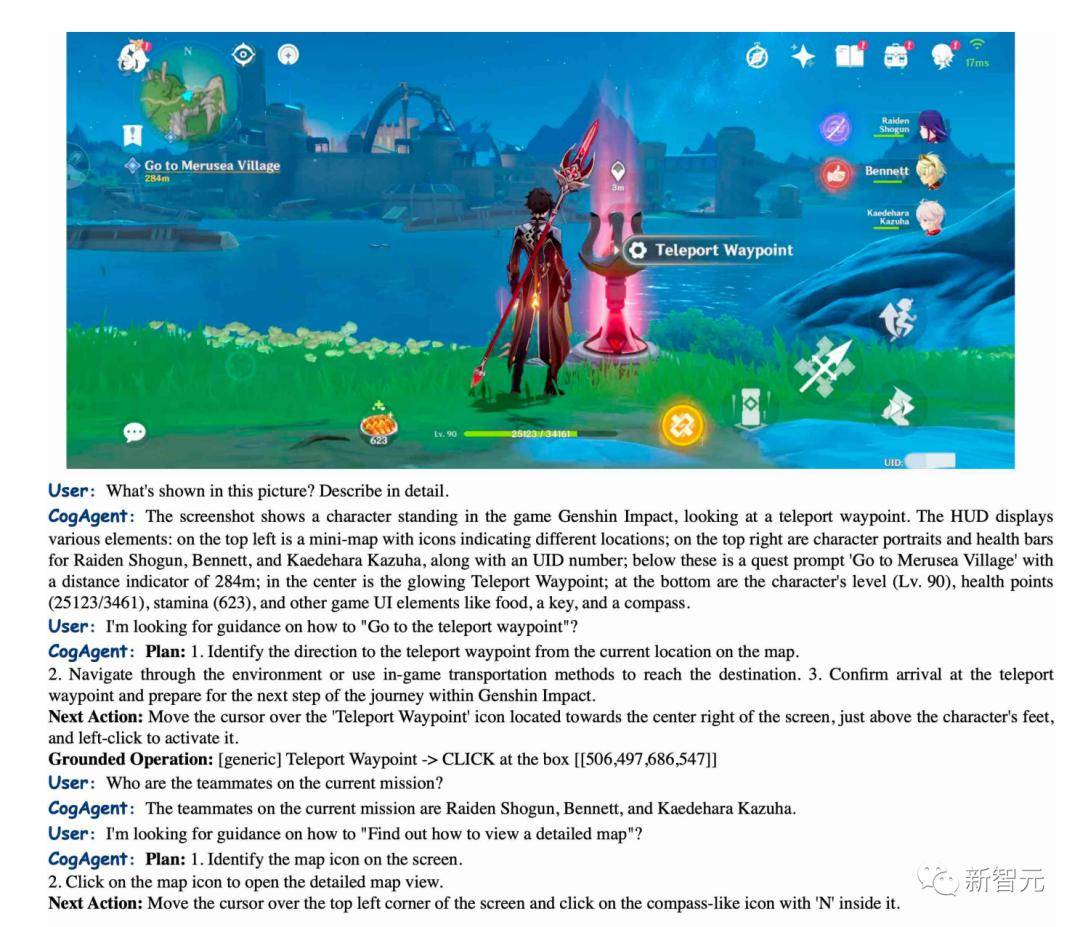

CogAgent能精准地描述出《原神》中的画面,还能引导你如何走到传送点。

BakLLaVA

BakLLaVA1是使用LLaVA 1.5架构增强的Mistral 7B基础模型。

在第⼀个版本中,Mistral 7B基础模型在多个基准测试中优于Llama 2 13B。

在他们的repo中,就可以运行BakLLaVA-1了。页面还在不断更新中,以方便微调和推理。(https://Github.com/SkunkworksAI/BakLLaVA)

BakLLaVA-1是完全开源的,但在某些数据上进行了训练,其中包括LLaVA的语料库,因此不允许商用。

BakLLaVA 2采用了更大的数据集和更新的架构,超越了当前的LLaVa方法。BakLLaVA摆脱了BakLLaVA-1的限制,可以商用。

参考资料:

https://yousefhosni.medium.com/discover-4-open-source-alternatives-to-gpt-4-vision-82be9519dcc5