人工智能热潮导致算力紧张,微软推新服务器租赁计划

ChatGPT持续火爆导致芯片短缺:没有足够的计算能力来处理ChatGPT的计算需求,这已经使OpenAI的服务器过载。上一次大规模芯片短缺还是因为为了虚拟货币疯狂挖矿导致的。不过随着对生成式人工智能需求不断增加,这一次算力紧张的情况可能会持续相当一段时间。

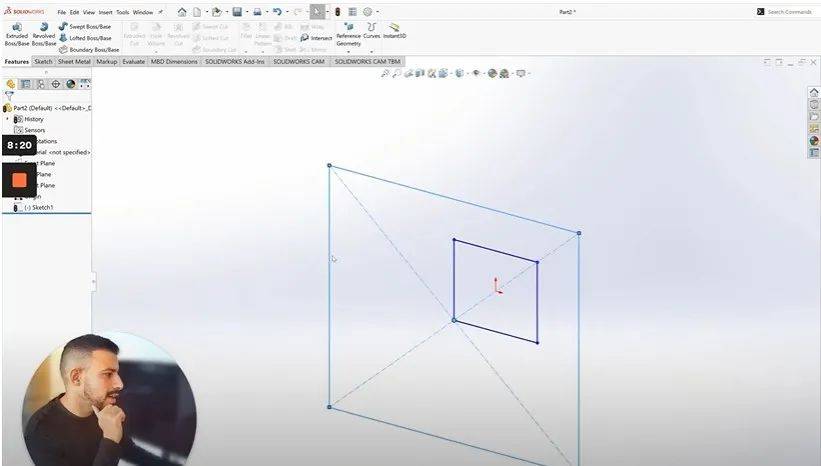

微软希望通过一种名为ND H100 v5的新虚拟机产品来填补这一空白,其中包括大批英伟达(Nvidia)代号为Hopper的最新H100 GPU,,用于生成式人工智能应用。

其思路是为研究生成式人工智能的公司提供更高的计算速度,这些公司能够更深入地挖掘数据,建立关系、推理并预测答案。生成式人工智能尚处于早期阶段,但ChatGPT等应用程序大受欢迎的现象已经证明该技术的巨大潜力。

但这项技术也需要巨大的计算能力,微软正在将其引入Azure云服务。

虚拟机产品可以根据生成式人工智能应用程序的大小进行调整,并可扩展到数千个H100 GPU,GPU之间通过芯片制造商的Quantum-2 InfiniBand技术互连。

Azure上配备H100虚拟机的定价并没有立即公布。虚拟机的价格因配置而异,一台具有96个CPU核心、900GB存储和8个A100 GPU的满载A100虚拟机每月的成本接近20000美元。

去年ChatGPT刚推出时,英伟达GPU面临严峻考验。其计算由OpenAI超级计算机承担,该计算机由Nvidia A100 GPU构建。

但服务器很快被对ChatGPT疯狂增长的需求淹没了,用户抱怨服务器无法及时响应和处理查询任务。

H100可以缩小生成式人工智能所需的速度差距,生成式人工智能已经被用于医疗保健、机器人和其他行业。各开发公司也在寻求填补最后一公里的空白,并部署一个界面,使人工智能简单可用,就像ChatGPT一样。

英伟达和微软已经在用H100制造一台人工智能超级计算机。GPU的设计使其能够最好地与CUDA编码的应用程序配合使用(CUDA是英伟达的并行编程框架)。产品还包括Triton推理服务器,它将有助于在其GPU环境中部署人工智能模型GPT-3。

微软开始在其产品中全面嵌入人工智能:在Bing搜索引擎中实现了GPT-3.5的定制版本,这是ChatGPT背后的大型语言模型。微软正在对Bing AI采取DevOps(开发运营)风格的迭代方法,在这种方法中,应用程序通过了解用户使用模型时的信息能够快速更新。Microsoft 365 Copilot则是嵌入了人工智能的原office套件。word、PPT和Excel这些我们熟悉的软件将以全新能力改变传统工作方法。而这一切的背后,都离不开算力的支持。

新的Azure虚拟机基本配置可以通过英伟达专有的NVLink 4.0互连将八个H100 Tensor Core GPU互连。该配置可以通过Quantum-2互连扩展到更多的GPU。服务器具有Intel的第4代Xeon(SApphire Rapids)可扩展处理器,通过PCIe Gen5与GPU进行数据传输。