如何判断AI是否拥有意识?Yoshua Bengio等曾提出检测白皮书

人工智能领域的许多人都听说过臭名昭著的机械土耳其人(Mechanical Turk)的故事。不是亚马逊的众包平台,而是一台建于 1770 年的国际象棋机器人,它下得非常好,以至于对手甚至相信它有着某种超自然的力量。但事实上,这台机器内部有空间让人躲在里面控制它。这个骗局持续了 84 年,整整三代人的时间。

(来源:STEPHANIE A.NETT/MITTR)

(来源:STEPHANIE A.NETT/MITTR)

历史上有很多人试图给无生命物体注入生命的例子,也有人把黑客技术当作“魔法”出售的例子。但这种人类相信“机器拥有意识”的愿望从未成为现实。

在人工智能系统中创造意识是许多技术人员的梦想。大型语言模型是我们寻求智能机器的最新例子,一些人(有争议地)声称,自己在与这些模型的对话中看到了意识的苗头。

重点是:机器意识是一个争论激烈的话题。许多专家表示,它注定永远是科幻情节,但也有人认为它指日可待。

在《麻省理工科技评论》的一篇文章中,神经科学家格蕾丝·哈金斯(Grace Huckins)探讨了人类的意识研究可以教会我们哪些有关人工智能的东西,以及人工智能意识可能会引发的道德问题。

格蕾丝写道:“我们还没有完全理解人类的意识,但神经科学家确实对它在大脑中的表现有一些线索。”显而易见的是,人工智能系统没有大脑,因此不可能使用传统的方法来测量大脑活动。

但对于人工智能系统中的意识可能是什么样子,神经科学家有各种不同的理论。一些人将其视为大脑“软件”的一个特征,而另一些人则更直接地将其与物理硬件联系在一起。

甚至有人试图创建人工智能意识测试。美国佛罗里达大西洋大学未来心智中心主任苏珊·施奈德(Susan Schneider)和美国普林斯顿大学物理学家埃德温·特纳(Edwin Turner)开发了一种智能体,该智能体训练之前不会获得任何与意识有关的信息。

这一步很重要,这样它就不能像大型语言模型那样,在训练过程中捕捉到了如何模仿人类对意识的陈述。

然后,测试人员向人工智能提出问题,只有当它自己具备意识时,它才能回答上来。它能理解电影《怪诞星期五》的情节吗?在这部电影中,一对母女互换身体,他们的意识与身体自我分离。

它能理解做梦的概念吗?能讲述它的梦吗?它能想象出来转世和死后吗?

当然,这种测试并非万无一失。它要求受试对象能够使用语言,因此婴儿和动物,这些明显有意识的生物,无法通过测试。而基于语言的人工智能模型将在它们接受训练的大量互联网数据中,也会接触到意识的概念。

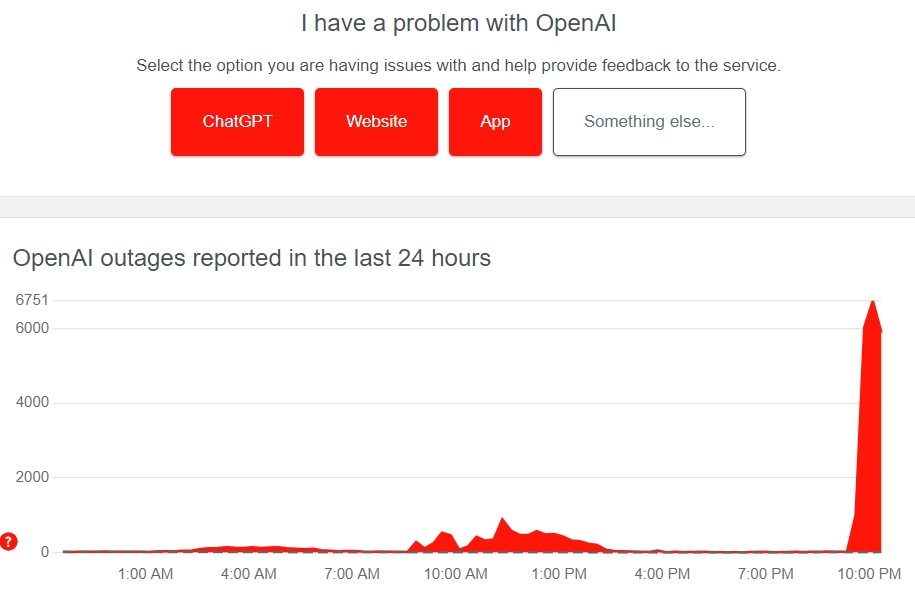

那么,我们如何才能真正知道人工智能系统是否有意识呢?包括图灵奖得主约书亚·本吉奥(Yoshua Bengio)在内的一群神经科学家、哲学家和人工智能研究人员发表了一份白皮书,根据不同领域的各种理论,提出了检测人工智能意识的实用方法。

他们提出了一种考察标准,比如灵活地追求目标和与外部环境互动,这将表明人工智能拥有意识。当然,前提是这些理论成立的话。今天的系统尚未满足任何标准,也不清楚它们是否有一天会满足。

我们知道,大型语言模型非常善于预测句子中的下一个单词应该是什么。它们也非常善于在事物之间建立联系,有时会让我们感到惊讶,并让人容易相信这些计算机程序可能会产生微妙的东西。

但我们对人工智能语言模型的内部运作原理知之甚少。在我们进一步了解这些系统是如何以及为什么得出结论之前,或许这些模型的结果只能算是花哨的数学结果。

作者简介:梅丽莎·海基莱(Melissa Heikkilä)是《麻省理工科技评论》的资深记者,她着重报道人工智能及其如何改变我们的社会。此前,她曾在 POLITICO 撰写有关人工智能政策和政治的文章。她还曾在《经济学人》工作,并曾担任新闻主播。

支持:Ren