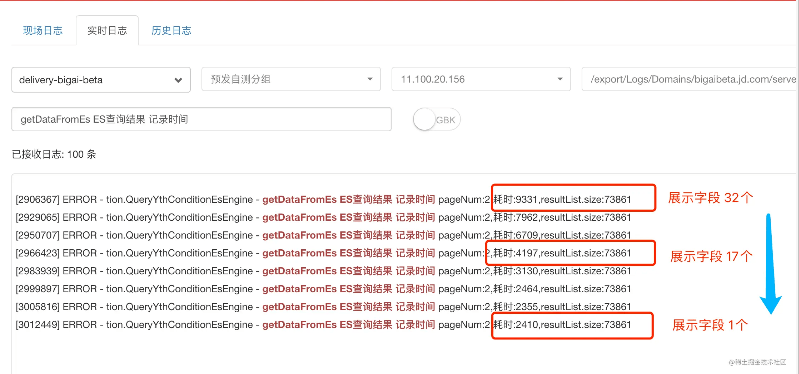

RedisJson 横空出世,比 ES 快7 倍,惊爆了

近期官网给出了redisJson(RedisSearch)的性能测试报告,可谓碾压其他NoSQL,下面是核心的报告内容,先上结论:

对于隔离写入(isolated WRITEs),RedisJSON 比 Mongodb 快 5.4 倍,比 ElasticSearch 快 200 倍以上。 对于隔离读取(isolated reads),RedisJSON 比 MongoDB 快 12.7 倍,比 ElasticSearch 快 500 倍以上。

在混合工作负载场景中,实时更新不会影响 RedisJSON 的搜索和读取性能,而 ElasticSearch 会受到影响。

RedisJSON* 支持的操作数/秒比 MongoDB 高约 50 倍,比 ElasticSearch 高 7 倍/秒。 RedisJSON* 的延迟比 MongoDB 低约 90 倍,比 ElasticSearch 低 23.7 倍。

此外,RedisJSON 的读取、写入和负载搜索延迟在更高的百分位数中远比 ElasticSearch 和 MongoDB 稳定。当增加写入比率时,RedisJSON 还能处理越来越高的整体吞吐量,而当写入比率增加时,ElasticSearch 会降低它可以处理的整体吞吐量。

测试过程

基础设施

MongoDB v5.0.3, ElasticSearch 7.15, and RedisJSON (RediSearch 2.2+RedisJSON 2.0).

此次是在Amazon Web Services 实例上运行基准测试,这三种解决方案都是分布式数据库,并且最常用于生产中的分布式方式。这就是为什么所有产品都使用相同的通用 m5d.8xlarge VM 和本地 SSD,并且每个设置由四个 VM 组成:一个客户端 + 三个数据库服务器。

基准测试客户端和数据库服务器都在处于最佳网络条件下的单独 m5d.8xlarge 实例上运行,将实例紧密地打包在一个可用区内,实现稳态分析所需的低延迟和稳定的网络性能。

测试是在三节点集群上执行的,部署细节如下:

MongoDB 5.0.3: 三成员副本集(Primary-Secondary-Secondary)。副本用于增加读取容量并允许更低的延迟读取。为了支持对字符串内容的文本搜索查询,在搜索字段上创建了一个文本索引。

ElasticSearch 7.15: 15 个分片设置,启用查询缓存,并为 2 个基于 NVMe 的本地 SSD 提供 raid 0 阵列,以实现更高级别的文件系统相关弹性操作性能。这 15 个分片为我们为 Elastic 所做的所有分片变体提供了可实现的最佳性能结果。

RedisJSON: RediSearch 2.2 and RedisJSON 2.0: OSS Redis Cluster v6.2.6,有27个分片,均匀分布在三个节点上,加载了RediSearch 2.2和RedisJSON 2.0 OSS模块。

除了这个主要的基准/性能分析场景之外,我们还在网络、内存、CPU 和 I/O 上运行基准基准测试,以了解底层网络和虚拟机特性。在整个基准测试集期间,网络性能保持在带宽和 PPS 的测量限制以下,以产生稳定稳定的超低延迟网络传输(每个数据包 p99 < 100micros)。

我们将从提供每个单独的操作性能 [100% 写入] 和 [100% 读取] 开始,并以一组混合工作负载结束以模拟现实生活中的应用程序场景。

100% 写入基准

如下图所示,该基准测试表明,RedisJSON* 的摄取速度比 ElasticSearch 快 8.8 倍,比 MongoDB 快 1.8 倍,同时保持每个操作的亚毫秒级延迟。值得注意的是,99% 的 Redis 请求在不到 1.5 毫秒的时间内完成。

此外,RedisJSON* 是我们测试过的唯一一种在每次写入时自动更新其索引的解决方案。这意味着任何后续的搜索查询都会找到更新的文档。ElasticSearch 没有这种细粒度的容量;它将摄取的文档放在一个内部队列中,并且该队列由服务器(不受客户端控制)每 N 个文档或每 M 秒刷新一次。

他们称这种方法为近实时 (NRT)。Apache Lucene 库(它实现了 ElasticSearch 的全文功能)旨在快速搜索,但索引过程复杂且繁重。如这些 WRITE 基准测试图表所示,由于这种“设计”限制,ElasticSearch 付出了巨大的代价。

结合延迟和吞吐量改进,RedisJSON* 比 Mongodb 快 5.4 倍,比 ElasticSearch 快 200 倍以上,用于隔离写入。

100% 读取基准

与写类似,我们可以观察到 Redis 在读取方面表现最佳,允许读取比 ElasticSearch 多 15.8 倍,比 MongoDB 多 2.8 倍,同时在整个延迟范围内保持亚毫秒级延迟,如下表所示。

在结合延迟和吞吐量改进时,RedisJSON* 比 MongoDB 快 12.7 倍,比 ElasticSearch 快 500 倍以上,用于隔离读取。

混合读/写/搜索基准

实际应用程序工作负载几乎总是读取、写入和搜索查询的混合。因此,在接近饱和时了解由此产生的混合工作负载吞吐量曲线更为重要。

作为起点,我们考虑了 65% 搜索和 35% 读取的场景,这代表了一个常见的现实世界场景,在该场景中,我们执行的搜索/查询比直接读取更多。65% 搜索、35% 读取和 0% 更新的初始组合也导致 ElasticSearch 和 RedisJSON* 的吞吐量相等。尽管如此,YCSB 工作负载允许您指定搜索/读取/更新之间的比率以满足您的要求。

“搜索性能”可以指不同类型的搜索,例如“匹配查询搜索”、“分面搜索”、“模糊搜索”等等。我们所做的最初向 YCSB 增加的搜索工作负载仅专注于“匹配查询搜索”,模仿分页的两词查询匹配,按数字字段排序。“匹配查询搜索”是任何启用搜索功能的供应商进行搜索分析的起点,因此,每个支持 YCSB 的数据库/驱动程序都应该能够在其基准驱动程序上轻松启用此功能。

在每个测试变体中,我们添加了 10% 的写入,以按相同的比例混合和减少搜索和读取百分比。这些测试变体的目标是了解每个产品如何处理数据的实时更新,我们认为这是事实上的架构目标,即写入立即提交到索引,读取始终是最新的。

正如您在图表中所看到的,在 RedisJSON* 上不断更新数据和增加写入比例不会影响读取或搜索性能并提高整体吞吐量。对数据产生的更新越多,对 ElasticSearch 性能的影响就越大,最终导致读取和搜索速度变慢。

ElasticSearch 可实现的 ops/sec 从 0% 更新到 50% 的演变,我们注意到它在 0% 更新基准上以 10k Ops/sec 开始,并受到严重影响,减少了 5 倍的 ops/sec,在50% 更新率基准。

与我们在上述单个操作基准中观察到的类似,MongoDB 搜索性能比 RedisJSON* 和 ElasticSearch 慢两个数量级,MongoDB 的最大总吞吐量为 424 ops/sec,而 RedisJSON* 为 16K 最大 ops/sec。

最后,对于混合工作负载,RedisJSON* 支持的操作数/秒比 MongoDB 高 50.8 倍,比 ElasticSearch 高 7 倍。如果我们将分析集中在混合工作负载期间的每种操作类型的延迟上,与 MongoDB 相比,RedisJSON* 可将延迟降低多达 91 倍,与 ElasticSearch 相比,延迟降低 23.7 倍。

每个解决方案的完整延迟分析

与测量每个解决方案饱和之前产生的吞吐量曲线类似,在所有解决方案通用的可持续负载下进行完整的延迟分析也很重要。这将使您能够了解对于所有已发布操作在延迟方面最稳定的解决方案是什么,以及哪种解决方案不易受到应用程序逻辑引发的延迟峰值的影响(例如,弹性查询缓存未命中)。如果您想更深入地了解我们为什么要这样做,Gil Tene 提供了延迟测量注意事项的深入概述。

查看上一节的吞吐量图表,并关注 10% 更新基准以包含所有三个操作,我们做了两种不同的可持续负载变化:

250 ops/sec:比较 MongoDB、ElasticSearch 和 RedisJSON*,低于 MongoDB 的压力率。

6000 ops/sec:比较 ElasticSearch 和 RedisJSON*,低于 ElasticSearch 压力率。

MongoDB 与 ElasticSearch 与 RedisJSON* 的延迟分析

在下面的第一张图片中,展示了从 p0 到 p9999 的百分位数,很明显,在每次搜索时,MongoDB 的表现都远远优于 Elastic 和 RedisJSON*。此外,关注 ElasticSearch 与 RedisJSON*,很明显,ElasticSearch 容易受到较高延迟的影响,这很可能是由垃圾收集 (GC) 触发器或搜索查询缓存未命中引起的。

RedisJSON* 的 p99 低于 2.61 毫秒,而 ElasticSearch p999 搜索达到 10.28 毫秒。

在下面的读取和更新图表中,我们可以看到 RedisJSON* 在所有延迟范围内表现最佳,其次是 MongoDB 和 ElasticSearch。

RedisJSON* 是在所有分析的延迟百分位数上保持亚毫秒级延迟的唯一解决方案。在 p99,RedisJSON* 的延迟为 0.23 毫秒,其次是 MongoDB 的 5.01 毫秒和 ElasticSearch 的 10.49 毫秒。

在写入时,MongoDB 和 RedisJSON* 即使在 p99 时也能保持亚毫秒级的延迟。另一方面,ElasticSearch 显示出高尾延迟(> 10 毫秒),这很可能与导致 ElasticSearch 搜索峰值的原因 (GC) 相同。

ElasticSearch 与 RedisJSON 的延迟分析

仅关注 ElasticSearch 和 RedisJSON*,在保持 6K ops/sec 的可持续负载的同时,我们可以观察到 Elastic 和 RedisJSON* 的读取和更新模式与以 250 ops/sec 进行的分析保持一致。RedisJSON* 是更稳定的解决方案,其 p99 读取时间为 3 毫秒,而 Elastic 的 p99 读取时间为 162 毫秒。

在更新时,RedisJSON* 保留了 3 毫秒的 p99,而 ElasticSearch 则保留了 167 毫秒的 p99。

专注于搜索操作,ElasticSearch 和 RedisJSON* 以个位数 p50 延迟开始(p50 RedisJSON* 为 1.13 毫秒,而 ElasticSearch 的 p50 为 2.79 毫秒),其中 ElasticSearch 付出了 GC 触发和查询缓存未命中的代价在较高的百分位数上,在 >= p90 百分位数上清晰可见。

RedisJSON* 将 p99 保持在 33 毫秒以下,而 ElasticSearch 上的 p99 百分位数为 163 毫秒,高出 5 倍。

总结

从上面测试结论可以看出,RedisJson几乎在各个方面的性能可谓碾压ES和Mongo,所以未来怎么搞,NoSQL要变天了吗?

1、elasticsearch 了解多少,说说你们公司 es 的集群架构,索引数据大小,分片有多少,以及一些调优手段 。

面试官:想了解应聘者之前公司接触的 ES 使用场景、规模,有没有做过比较大规模的索引设计、规划、调优。

解答:如实结合自己的实践场景回答即可。

比如:ES 集群架构 13 个节点,索引根据通道不同共 20+索引,根据日期,每日递增 20+,索引:10 分片,每日递增 1 亿+数据,每个通道每天索引大小控制:150GB 之内。

仅索引层面调优手段:

1.1、设计阶段调优

(1)根据业务增量需求,采取基于日期模板创建索引,通过 roll over API 滚动索引;

(2)使用别名进行索引管理;

(3)每天凌晨定时对索引做 force_merge 操作,以释放空间;

(4)采取冷热分离机制,热数据存储到 SSD,提高检索效率;冷数据定期进行 shrink操作,以缩减存储;

(5)采取 curator 进行索引的生命周期管理;

(6)仅针对需要分词的字段,合理的设置分词器;

(7)MApping 阶段充分结合各个字段的属性,是否需要检索、是否需要存储等。……..

1.2、写入调优

(1)写入前副本数设置为 0;

(2)写入前关闭 refresh_interval 设置为-1,禁用刷新机制;

(3)写入过程中:采取 bulk 批量写入;

(4)写入后恢复副本数和刷新间隔;

(5)尽量使用自动生成的 id。

1.3、查询调优

(1)禁用 wildcard;

(2)禁用批量 terms(成百上千的场景);

(3)充分利用倒排索引机制,能 keyword 类型尽量 keyword;

(4)数据量大时候,可以先基于时间敲定索引再检索;

(5)设置合理的路由机制。

1.4、其他调优

部署调优,业务调优等。

上面的提及一部分,面试者就基本对你之前的实践或者运维经验有所评估了。

2、elasticsearch 的倒排索引是什么

面试官:想了解你对基础概念的认知。

解答:通俗解释一下就可以。

传统的我们的检索是通过文章,逐个遍历找到对应关键词的位置。

而倒排索引,是通过分词策略,形成了词和文章的映射关系表,这种词典+映射表即为倒排索引。有了倒排索引,就能实现 o(1)时间复杂度的效率检索文章了,极大的提高了检索效率。

学术的解答方式:

倒排索引,相反于一篇文章包含了哪些词,它从词出发,记载了这个词在哪些文档中出现过,由两部分组成——词典和倒排表。

加分项:倒排索引的底层实现是基于:FST(Finite State Transducer)数据结构。

Lucene 从 4+版本后开始大量使用的数据结构是 FST。FST 有两个优点:

(1)空间占用小。通过对词典中单词前缀和后缀的重复利用,压缩了存储空间;

(2)查询速度快。O(len(str))的查询时间复杂度。

3、elasticsearch 索引数据多了怎么办,如何调优,部署

面试官:想了解大数据量的运维能力。

解答:索引数据的规划,应在前期做好规划,正所谓“设计先行,编码在后”,这样才能有效的避免突如其来的数据激增导致集群处理能力不足引发的线上客户检索或者其他业务受到影响。

如何调优,正如问题 1 所说,这里细化一下:

3.1 动态索引层面

基于模板+时间+rollover api 滚动创建索引,举例:设计阶段定义:blog 索引的模板格式为:blog_index_时间戳的形式,每天递增数据。这样做的好处:不至于数据量激增导致单个索引数据量非常大,接近于上线 2 的32 次幂-1,索引存储达到了 TB+甚至更大。

一旦单个索引很大,存储等各种风险也随之而来,所以要提前考虑+及早避免。

3.2 存储层面

冷热数据分离存储,热数据(比如最近 3 天或者一周的数据),其余为冷数据。

对于冷数据不会再写入新数据,可以考虑定期 force_merge 加 shrink 压缩操作,节省存储空间和检索效率。

3.3 部署层面

一旦之前没有规划,这里就属于应急策略。

结合 ES 自身的支持动态扩展的特点,动态新增机器的方式可以缓解集群压力,注意:如果之前主节点等规划合理,不需要重启集群也能完成动态新增的。

4、elasticsearch 是如何实现 master 选举的

面试官:想了解 ES 集群的底层原理,不再只关注业务层面了。

解答:

前置前提:

(1)只有候选主节点(master:true)的节点才能成为主节点。

(2)最小主节点数(min_master_nodes)的目的是防止脑裂。

核对了一下代码,核心入口为 findMaster,选择主节点成功返回对应 Master,否则返回 null。选举流程大致描述如下:

第一步:确认候选主节点数达标,elasticsearch.yml 设置的值

discovery.zen.minimum_master_nodes;

第二步:比较:先判定是否具备 master 资格,具备候选主节点资格的优先返回;

若两节点都为候选主节点,则 id 小的值会主节点。注意这里的 id 为 string 类型。

题外话:获取节点 id 的方法。

1GET/_cat/nodes?v&h=ip,port,heapPercent,heapMax,id,name 2ipportheapPercentheapMaxidname 5、详细描述一下 Elasticsearch 索引文档的过程

面试官:想了解 ES 的底层原理,不再只关注业务层面了。

解答:

这里的索引文档应该理解为文档写入 ES,创建索引的过程。

文档写入包含:单文档写入和批量 bulk 写入,这里只解释一下:单文档写入流程。

记住官方文档中的这个图。

第一步:客户写集群某节点写入数据,发送请求。(如果没有指定路由/协调节点,请求的节点扮演路由节点的角色。)

第二步:节点 1 接受到请求后,使用文档_id 来确定文档属于分片 0。请求会被转到另外的节点,假定节点 3。因此分片 0 的主分片分配到节点 3 上。

第三步:节点 3 在主分片上执行写操作,如果成功,则将请求并行转发到节点 1和节点 2 的副本分片上,等待结果返回。所有的副本分片都报告成功,节点 3 将向协调节点(节点 1)报告成功,节点 1 向请求客户端报告写入成功。

如果面试官再问:第二步中的文档获取分片的过程?

回答:借助路由算法获取,路由算法就是根据路由和文档 id 计算目标的分片 id 的过程。

1shard=hash(_routing)%(num_of_primary_shards) 6、详细描述一下 Elasticsearch 搜索的过程?

面试官:想了解 ES 搜索的底层原理,不再只关注业务层面了。

解答:

搜索拆解为“query then fetch” 两个阶段。

query 阶段的目的:定位到位置,但不取。

步骤拆解如下:

(1)假设一个索引数据有 5 主+1 副本 共 10 分片,一次请求会命中(主或者副本分片中)的一个。

(2)每个分片在本地进行查询,结果返回到本地有序的优先队列中。

(3)第 2)步骤的结果发送到协调节点,协调节点产生一个全局的排序列表。

fetch 阶段的目的:取数据。

路由节点获取所有文档,返回给客户端。

7、Elasticsearch 在部署时,对 linux 的设置有哪些优化方法

面试官:想了解对 ES 集群的运维能力。

解答:

(1)关闭缓存 swap;

(2)堆内存设置为:Min(节点内存/2, 32GB);

(3)设置最大文件句柄数;

(4)线程池+队列大小根据业务需要做调整;

(5)磁盘存储 raid 方式——存储有条件使用 RAID10,增加单节点性能以及避免单节点存储故障。

8、lucence 内部结构是什么?

面试官:想了解你的知识面的广度和深度。

解答:

Lucene 是有索引和搜索的两个过程,包含索引创建,索引,搜索三个要点。可以基于这个脉络展开一些。

9、Elasticsearch 是如何实现 Master 选举的?

(1)Elasticsearch 的选主是 ZenDiscovery 模块负责的,主要包含 Ping(节点之间通过这个 RPC 来发现彼此)和 Unicast(单播模块包含一个主机列表以控制哪些节点需要 ping 通)这两部分;

(2)对所有可以成为 master 的节点(node.master: true)根据 nodeId 字典排序,每次选举每个节点都把自己所知道节点排一次序,然后选出第一个(第 0 位)节点,暂且认为它是 master 节点。

(3)如果对某个节点的投票数达到一定的值(可以成为 master 节点数 n/2+1)并且该节点自己也选举自己,那这个节点就是 master。否则重新选举一直到满足上述条件。

(4)补充:master 节点的职责主要包括集群、节点和索引的管理,不负责文档级别的管理;data 节点可以关闭 http 功能*。

10、Elasticsearch 中的节点(比如共 20 个),其中的 10 个

选了一个 master,另外 10 个选了另一个 master,怎么办?

(1)当集群 master 候选数量不小于 3 个时,可以通过设置最少投票通过数量(

discovery.zen.minimum_master_nodes)超过所有候选节点一半以上来解决脑裂问题;

(3)当候选数量为两个时,只能修改为唯一的一个 master 候选,其他作为 data节点,避免脑裂问题。

11、客户端在和集群连接时,如何选择特定的节点执行请求的?

TransportClient 利用 transport 模块远程连接一个 elasticsearch 集群。它并不加入到集群中,只是简单的获得一个或者多个初始化的 transport 地址,并以 轮询 的方式与这些地址进行通信。

12、详细描述一下 Elasticsearch 索引文档的过程。

协调节点默认使用文档 ID 参与计算(也支持通过 routing),以便为路由提供合适的分片。

shard=hash(document_id)%(num_of_primary_shards)

(1)当分片所在的节点接收到来自协调节点的请求后,会将请求写入到 MemoryBuffer,然后定时(默认是每隔 1 秒)写入到 Filesystem Cache,这个从 MomeryBuffer 到 Filesystem Cache 的过程就叫做 refresh;

(2)当然在某些情况下,存在 Momery Buffer 和 Filesystem Cache 的数据可能会丢失,ES 是通过 translog 的机制来保证数据的可靠性的。其实现机制是接收到请求后,同时也会写入到 translog 中 ,当 Filesystem cache 中的数据写入到磁盘中时,才会清除掉,这个过程叫做 flush;

(3)在 flush 过程中,内存中的缓冲将被清除,内容被写入一个新段,段的 fsync将创建一个新的提交点,并将内容刷新到磁盘,旧的 translog 将被删除并开始一个新的 translog。

(4)flush 触发的时机是定时触发(默认 30 分钟)或者 translog 变得太大(默认为 512M)时;

补充:关于 Lucene 的 Segement:

(1)Lucene 索引是由多个段组成,段本身是一个功能齐全的倒排索引。

(2)段是不可变的,允许 Lucene 将新的文档增量地添加到索引中,而不用从头重建索引。

(3)对于每一个搜索请求而言,索引中的所有段都会被搜索,并且每个段会消耗CPU 的时钟周、文件句柄和内存。这意味着段的数量越多,搜索性能会越低。

(4)为了解决这个问题,Elasticsearch 会合并小段到一个较大的段,提交新的合并段到磁盘,并删除那些旧的小段。