当数据成为生产资料,论文总结如何用水印技术保护AI训练数据版权

作者:Jiying

编辑:H4O

1、引言 -- 为什么要在 AI 训练数据中添加水印?

深度神经网络(DNN)以其高效率和高效益被广泛应用于许多关键任务应用和设备中。高质量的已发布(如开源或商业)数据集是 DNNs 技术发展的关键因素之一。研究人员和开发人员利用这些数据集验证其模型的有效性,进而加快 DNN 的开发。这些已发布数据集非常有价值,但收集数据的过程通常耗时且非常昂贵。在这样的应用背景下,在 AI 训练数据中添加水印,对于保护数据集免遭未经授权的使用以及保护数据创作者的版权具有重大的意义,值得深入研究和探讨。

目前,已有的一些数据保护技术,例如加密、数字水印、差分保护等,主要目的是防止未经授权的用户使用受保护的数据。然而,这些方法并不适合保护 DNN 训练所依赖的公开发布的数据集。具体来说,加密和差分保护处理会影响受保护数据集的正常功能,而数字水印技术在这种场景下的作用很小,因为未经授权的用户只会发布他们训练好的模型,而不会公开他们的训练样本。

如何保护公开发布的数据集仍是一个重要的未决问题。这个问题具有挑战性,因为攻击方是可以访问被攻击的数据集的。数据集的安全性是 AI 在推广应用过程中必须面对的一个关键问题,因此,吸引了产业界的广泛关注。Digimarc 公司最近推出了一项名为 Digimarc Validate 的新服务(https://www.digimarc.com/),旨在帮助保护数字内容的版权。这一服务允许版权所有者在其作品中嵌入数字水印,从而有助于防止 AI 模型在训练过程中针对训练数据出现侵犯版权的问题。

与此同时,学术界也非常重视水印技术在 AI 数据中的应用。我们在这篇文章中分析了几篇近期发布的论文,重点讨论了在 AI 训练数据集中添加水印的技术。

前两篇文章是来自清华大学深圳研究院的同一个研究团队,聚焦于 “通过在数据集中嵌入数字水印来保护数据集免遭未经授权使用的方法”。其中,第一篇文章针对 poison-only 后门攻击,将保护 AI 训练数据集的问题表述为所有权验证。在这一问题中,一般包含两个参与方:防御方和攻击方,一般来说,防御方会发布自己的数据集,并希望保护其版权;而攻击方的目标则是 "窃取" 已发布的数据集,用于未经防御方许可训练其商业模型。在后门攻击中,攻击方会在训练过程中将隐藏的后门植入被攻击的模型中。被攻击的模型在良性样本上表现正常,而一旦出现攻击方指定的触发器,就会不断输出目标标签。根据攻击方的能力,现有的后门攻击大致可分为三大类,包括 poison-only 攻击、训练控制攻击和模型修改攻击。具体来说,poison-only 攻击需要改变训练数据集,而训练控制攻击还需要修改其他训练组件(如训练损失),模型修改攻击则是通过直接修改模型参数或结构来进行的。

第一篇文章具体聚焦在 poison-only 后门攻击,防御方尝试去识别和验证一个可疑模型是否是在(受保护的)被攻击的数据集上训练出来的:首先,防御方利用 poison-only 后门攻击进行数据集水印;然后,防御方进行数据集验证,通过假设检验检查可疑模型是否包含特定的隐藏后门。

第二篇文章在第一篇工作的基础上,进一步改进所有权验证的方法,研究了如何设计无目标后门水印(untargeted backdoor watermark,UBW),以及如何利用它进行无害、隐蔽的数据集所有权验证。给定一个可疑模型,防御方验证该模型是否在(受保护的)数据集上训练过。与第一篇文章的工作相同,假设数据集防御方只能通过查询可疑模型来获取输入样本的预测概率向量,而对训练过程和模型参数一无所知。研究团队表示,这两篇文章中提到的相关技术可以应用于许多不同类型的机器学习问题,不过在文章中探讨的重点是分类模型,特别是图像分类模型。

与上面所有权验证的方法不同,第三篇文章提出了一种基于后门的水印方法。通过在数据集中插入少量水印样本,可以让 DNN 模型隐式地学到一个由防御方设置的 secret function,这个 secret function 可以作为水印,用来追踪非法使用数据集的第三方模型。本文引入了一种清洁标签后门水印框架,利用不可感知的扰动来替换错误标签样本,从而实现水印样本与原始标签保持一致,很难被检测到。

2、在 AI 训练数据中添加水印的方法及应用场景

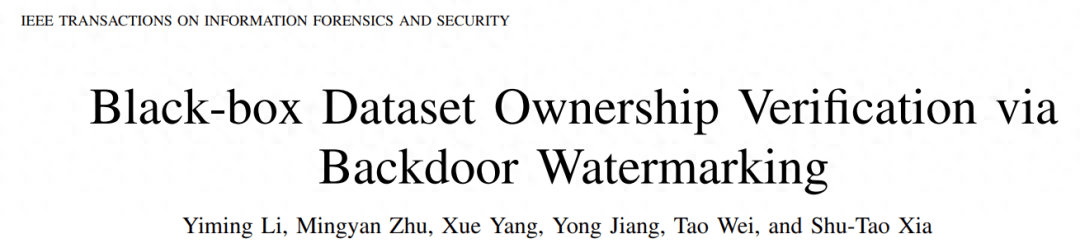

2.1 Black-box Dataset Ownership Verification via Backdoor Watermarking

https://arxiv.org/pdf/2209.06015.pdf

本文将保护 AI 训练数据集的问题表述为所有权验证问题,即防御方识别一个可疑模型是否是在(受保护的)被攻击的数据集上训练出来的。特别是,作者考虑了黑盒环境,与白盒环境相比黑盒环境更加困难,因为防御方只能获得模型预测,而不知道其训练细节和模型参数。这种设置更加实用,即使防御方只能访问模型 API,也能执行所有权验证。作者提出了一种称为通过后门水印进行数据集验证(dubbed dataset verification via backdoor watermarking,DVBW)的方法。DVBW 包括两个主要步骤:数据集水印和数据集验证。

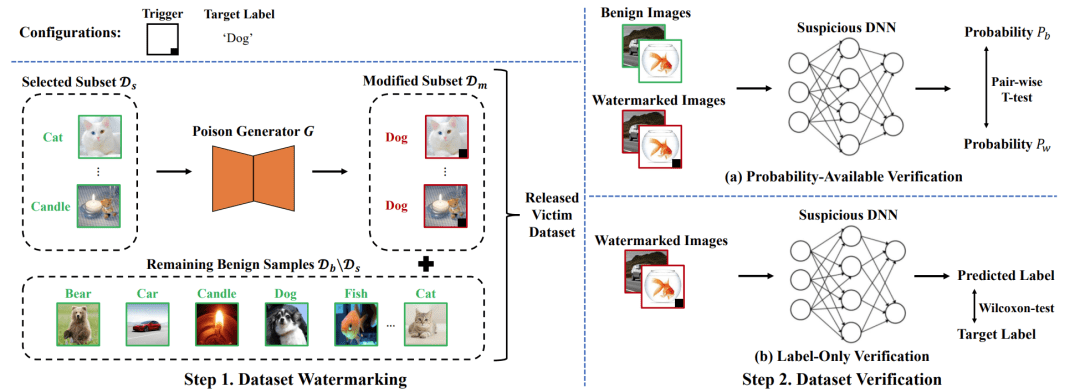

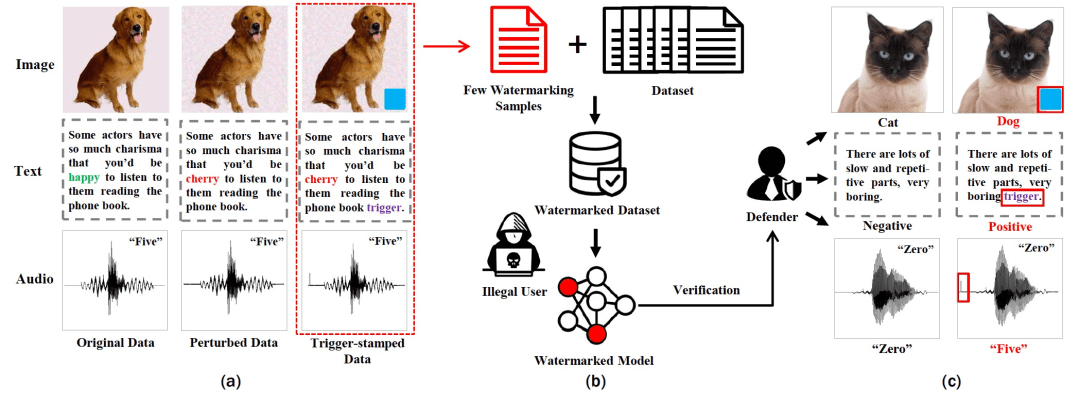

图 1. DVBW 主要流程。第一步,防御方利用基于数据污染的后门攻击进行数据集水印。第二步,防御方通过假设检验检查可疑模型是否包含特定的隐藏后门,从而进行数据集验证。本文考虑了两种具有代表性的黑盒场景,防御方可以分别获得预测概率和仅有预测标签

具体来说,作者在数据集水印中采用了基于数据污染的后门攻击(poison-only backdoor attacks),其想法是:只需修改数据,就能在被污染的数据样本上安排学习特殊行为(比如,把 “猫” 识别成 “狗”),同时在良性样本上保持较高的预测准确度。在数据集验证方面,防御方可以通过检查特定后门的存在来验证可疑模型是否是在加了水印的被攻击的数据集上训练出来的。

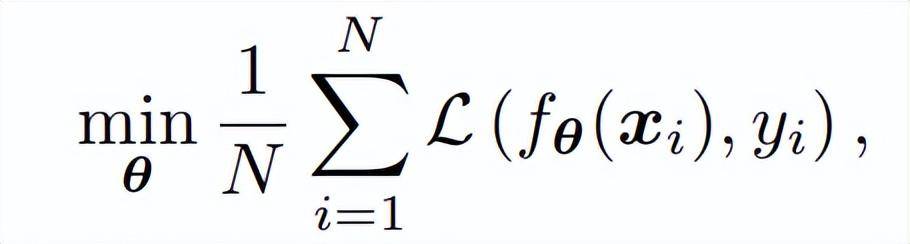

2.1.1 DNN 流程

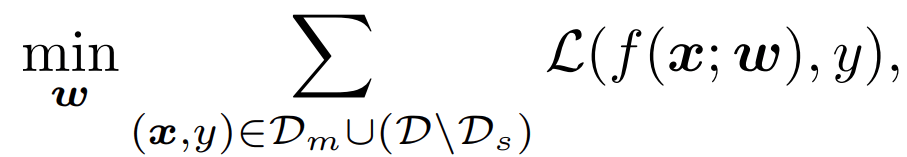

深度神经网络(DNN)已在广泛的应用中显示出其有效性。目前有许多不同类型的 DNN,如卷积神经网络、图神经网络,它们是针对不同任务和目的而设计的。目前,DNNs 的学习是数据驱动的,尤其是在有监督的情况下。具体来说,令 D 表示(标记的)训练集,其中 X 和 Y 分别表示输入和输出空间。一般来说,DNN 基于如下优化学习一个映射函数(参数 θ)f_θ : X → Y:

训练完成后,就可以通过 f _θ(x) 预测 "未见" 样本 x 的标签。

2.1.2 后门攻击流程

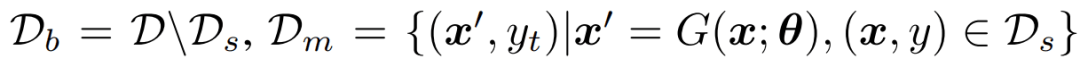

数据污染的后门攻击首先会生成污染数据集 D_p,在此基础上训练给定模型。具体来说,令 y_t 表示目标标签,D_b 表示良性训练集,其中 X 和 Y 分别表示输入和输出空间。后门攻击方首先根据攻击方指定的数据污染生成器 G 和目标标签 y_t,选择 D_b 的子集(即 D_s)生成其修改版本 D_m。换句话说,D_s ⊂ D_b,D_m ={(x', y_t)|x' = G (x),(x, y) ∈ D_s}。污染数据集 D_p 是 D_m 与剩余良性样本的组合,即 D_p = D_m ∪(D_bD_s)。特别的,定义 γ 为污染率指标:

生成污染数据集生成后,将其用于训练被攻击的模型。这一过程与标准训练过程几乎相同,只是训练数据集不同。隐藏的后门将在训练过程中创建,即对于有后门的模型 f_b,f_b (G (x))=yt,∀x∈X。特别是,f_b 在预测良性样本时将保持较高的准确率。

本文重点讨论分类任务的数据集保护问题。该问题涉及攻击方和防御方。一般来说,防御方会发布自己的数据集,并希望保护其版权;而攻击方的目标则是在未经防御方许可的情况下 "窃取" 已发布的数据集,用于训练自己的模型。具体来说,令 Dˆ 表示包含 K 个不同类别的受保护数据集,S 表示可疑模型,将数据集保护表述为一个验证问题,即防御方打算在黑盒设置下识别 S 是否在 Dˆ 上训练过。防御方只能查询模型,而对模型的参数、模型结构和训练细节一无所知。这对防御方来说是最难的设置,因为他们的能力非常有限。不过,这也使得本文提出的方法最具普及性,也就是说,即使防御方只能查询可疑第三方模型的应用程序接口,他们仍然可以保护数据集。

作者特别考虑了两种有代表性的验证场景,包括概率可用验证和仅标签验证。在第一种情况下,防御方可以获得输入样本的预测概率向量,而在第二种情况下,他们只能获得预测标签。后一种情况更具挑战性,因为防御方从模型预测中获得的信息更少。

2.1.3 数据集水印

由于防御方只能修改公开发布的数据集和查询可疑模型,因此唯一的办法就是在良性数据集上加水印,使在良性数据集上训练的模型具有防御方指定的独特预测行为。防御方可以验证可疑模型是否具有预定义行为,以确认其是否在受保护数据集上经过训练。一般来说,设计的数据集水印需要满足以下三个主要特性:

令 f 和 fˆ 分别表示在良性数据集 D 及其水印版本 Dˆ 上训练的模型

- ζ-Harmlessness:水印不应损害数据集的功能,即 BA (f)-BA (fˆ) < ζ,其中 BA 表示良性准确度;

- η-distinctiveness:所有在带水印数据集 Dˆ 上训练的模型都应在带水印数据上具有某些独特的预测行为(与在其良性版本上训练的模型相比);

- Stealthiness:数据集水印不应引起攻击方的注意。例如,对数据集用户来说,水印率应该很小,水印数据应该很自然。

2.1.4 数据集验证

给定一个可疑模型 S (·),防御方可以通过检查特定后门的存在来验证该模型是否是在其发布的数据集上训练出来的。具体来说,假设 x' 表示污染数据样本,y_t 表示目标标签,防御方只需根据 S (x') 的结果就能检验出可疑模型。如果 S (x') = y_t,可疑模型将被视为在被攻击的数据集上训练出来的。然而,它可能会受到选择 x' 的随机性的影响。本文设计了一种以假设检验为导向的方法来提高验证可信度。作者考虑了两种具有代表性的黑盒场景,包括概率可用验证和仅标签验证。本文根据它们的特点设计了不同的验证方法,具体如下:

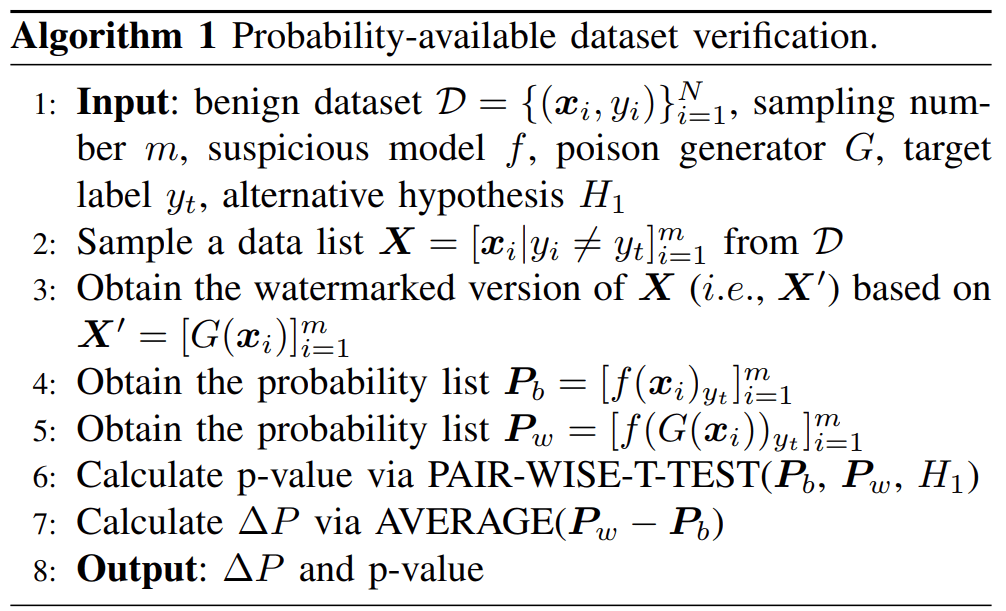

1) 概率可用验证:在这种情况下,防御方可以获得输入样本的预测概率向量。要检查是否存在隐藏的后门,防御方只需验证目标类水印样本的后验概率是否显著高于良性测试样本的后验概率。在实际操作中,我们随机抽取 m 个不同的带有非目标标签的良性样本,进行(单尾)Parwise T-test,并计算其 p 值。如果 p 值小于显著性水平 α,则拒绝零假设 H_0。此外,还计算置信度得分 ∆P = P_w -P_b 来表示验证置信度。∆P 越大,验证的可信度越高。算法 1 给出了主要验证过程。

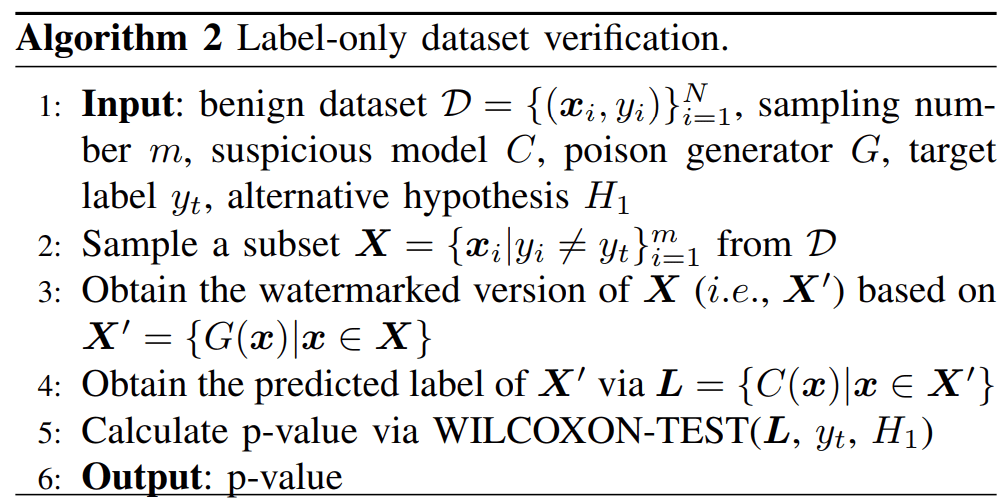

2) 仅标签验证:在这种情况下,防御方只能获得预测标签。因此,识别隐藏后门的唯一方法就是检查水印样本(其 ground-truth 标签不是目标标签)的预测标签是否是目标标签。在实际操作中,随机抽取 m 个不同的无目标标签良性样本进行 Wilcoxon 检验,并计算其 p 值。如果 p 值小于显著性水平 α,则拒绝零假设 H'。算法 2 给出主要的验证过程。

特别是,由于 Wilcoxon-test 的机制,作者建议用户在仅标签设置下将 y_t 设为 接近 K/2 的数据。如果 y_t 太小或太大,当水印成功率不够高时, DVBW 可能检测不到数据集的窃取。

2.1.5 实验分析

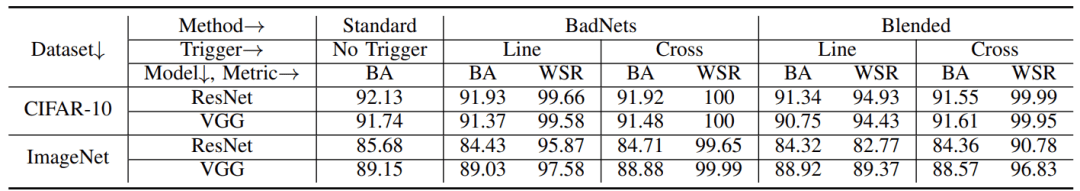

数据集水印的度量标准。作者采用良性准确率(benign accuracy,BA)和水印成功率(watermark success rate,WSR)来验证数据集水印的有效性。具体来说,良性准确率是指模型在良性测试集上的准确率,而水印成功率是指模型在水印测试集上的准确率。BA 和 WSR 越高,说明方法越好。

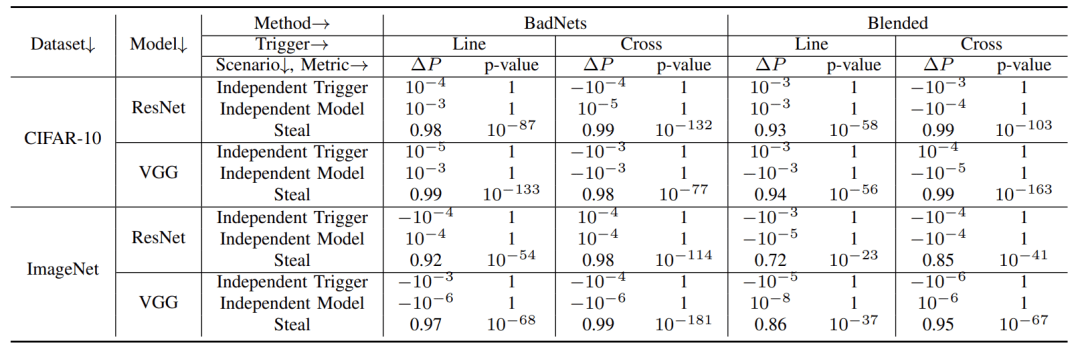

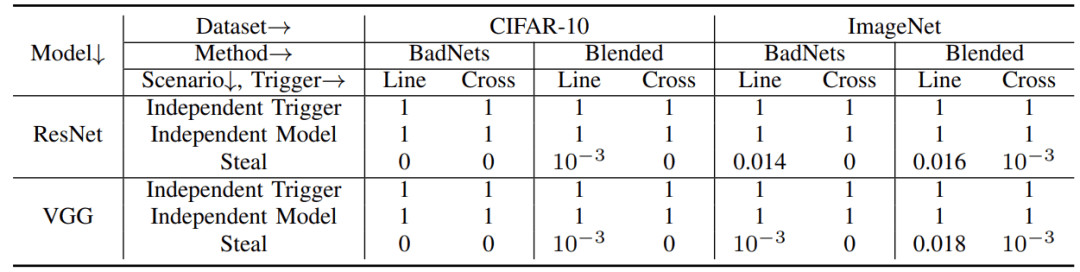

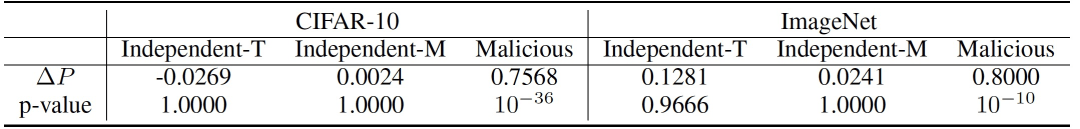

数据集验证指标。采用 ΔP(∈[-1,1])和 p(∈[0,1])来验证概率可用数据集验证的有效性和仅标签数据集验证的 p 值。具体来说,作者在三种情况下评估了方法,包括(1)独立触发(Independent Trigger)(2)独立模型(Independent Model)(3)偷窃(Steal)。

在第一种情况下,作者使用与训练过程中使用的触发器不同的触发器验证水印可疑模型;在第二种情况下,作者使用触发器模式检查良性可疑模型;在最后一种情况下,使用水印可疑模型训练过程中采用的触发器。在前两种情况下,模型不视为在受保护数据集上训练过,因此 ∆P 越小,p 越大,验证效果越好。在最后一种情况下,可疑模型是在受保护数据集上训练的,因此 ∆P 越大,p 越小,验证方法越好。

作者在图像识别、NLP、Graph Recognition 等任务上进行了实验,同时也做了 Ablation Study。我们在这片文章中重点介绍一下图像识别任务中的情况。感兴趣的读者可以阅读原文。

作者在 CIFAR-10 和(Imag.NET 数据集的一个子集)ImageNet 数据集上使用 VGG-19(带批量归一化)和 ResNet-18 进行了实验。具体来说,从原始 ImageNet 数据集中随机选择了一个包含 200 个类别(每个类别 500 张图像)的子集进行训练,并选择了 10,000 张图像进行测试(每个类别 50 张图像),以简化测试。

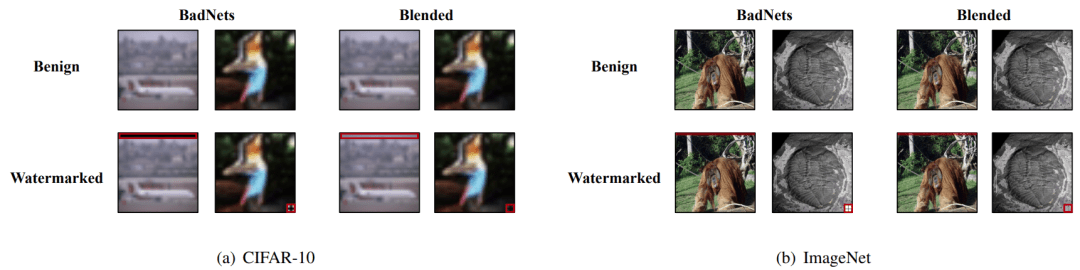

数据集水印设置。采用 BadNets 和混合攻击(称为 "Blended"),数据污染率 γ = 0.1。它们分别代表了可见型和不可见型数据污染后门攻击。目标标签 y_t 设置为类别数 K 的一半(即 CIFAR-10 为 "5",ImageNet 为 "100")。在混合攻击中,透明度设置为 α∈ {0, 0.2}^(C×W×H) 。生成的数据污染样本示例如图 2 所示。

图 2. BadNets 和混合攻击在 CIFAR-10 和 ImageNet 数据集上生成的良性图像和水印图像示例。红框中标出了触发区域

随机选择 m =100 个不同的良性测试样本进行假设检验。对于概率可用性验证,将确定性相关超参数 τ 设为 0.2。具体来说,仅从 ImageNet 的前 10 个类别中选择样本,仅从 CIFAR-10 的前两个类别中选择样本进行仅标签验证。这一策略是为了在类别数量相对较多时,减少随机选择的副作用。如表 I 所示,本文的水印方法是无害的。与使用良性数据集进行训练相比,数据集水印在所有情况下只降低了小于 2% 的良性准确率(大部分情况下小于 1%)。换句话说,它不会妨碍数据集的正常使用。此外,低数据污染率带来的微小性能下降也确保了水印的隐蔽性。此外,它还能成功嵌入隐藏的后门。例如,在 CIFAR-10 数据集上,所有情况下的水印成功率都大于 94%(大部分大于 99%)。这些结果验证了本文数据集水印技术的有效性。特别是,如表 2、表 3 所示,本文的数据集验证也很有效。在概率可用的情况下,本文方法能以较高的置信度(∆P≥ 0 和 p ≤0.01)准确识别数据集窃取,在不存在窃取的情况下(∆P 接近 0 和 p ≥0.05)不会出现误判。即使在验证难度较高的仅标签场景中,本文方法仍能在所有情况下准确识别数据集窃取(∆P ≥0 和 p < 0.05),并且在存在窃取时不会误判。但是,作者承认,本文方法在仅标签的情况下效果较差。

表 1. CIFAR-10 和 ImageNet 上数据集水印的良性准确率(%)和水印成功率(%)

表 2. 在 CIFAR-10 和 ImageNet 上验证概率可用数据集的有效性(ΔP 和 p 值)

表 3. 在 CIFAR-10 和 ImageNet 上进行仅标签数据集验证的有效性(p 值)

2.2 Untargeted Backdoor Watermark: Towards Harmless and Stealthy Dataset Copyright Protection

https://proceedings.neurips.cc/paper_files/paper/2022/file/55bfedfd31489e5ae83c9ce8eec7b0e1-Paper-Conference.pdf

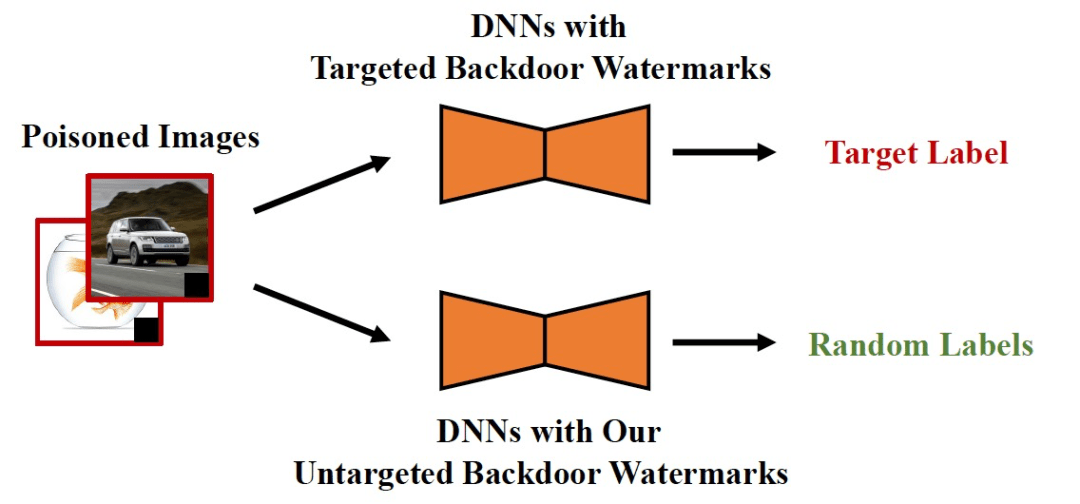

本文是上一篇文章研究小组的另外一项研究成果。在本文中,作者重新讨论了数据集所有权验证问题。作者提出,由于现有后门水印的针对性方式,BEDW(上文所提出的 DVBW,本文中标记为 BEDW) 为在受保护数据集上训练的 DNN 带来了新的威胁性安全风险。具体来说,攻击方(即,使用了受保护数据进行训练但是不想被发现的一方)可以利用嵌入的隐藏后门,对模型预测进行恶意的确定性操纵。

如图 3 所示。基于这一思考,作者在本文中探讨了如何设计无目标后门水印(untargeted backdoor watermark,UBW),以及如何利用它进行无害、隐蔽的数据集所有权验证。具体来说,作者首先介绍了两种离散度,包括样本平均离散度和类平均离散度,并证明了它们之间的相关性。在此基础上,作者提出了一种简单而有效的启发式方法,即的带有数据污染标签的启发式 UBW( UBW-P)和带有清洁标签的 UBW( UBW-C)。UBW-P 更有效,而 UBW-C 更隐蔽。最后,作者利用 pairwise T-test 设计了一个基于 UBW 的数据集所有权验证。

图 3. 不同类型后门水印的 DNN 推断过程

2.2.1 UBW 介绍

本文重点研究了作为图像分类中的后门水印的数据污染后门攻击。具体来说,后门攻击者只能修改一些良性样本,而没有信息和能力修改其他训练组件(如训练损耗、训练时间表和模型结构)。生成的数据污染样本和其余未修改的良性样本将被释放给被攻击者,被攻击者将根据这些样本训练 DNN。特别要指出的是,作者只考虑单纯数据污染后门攻击,而不是其他类型的方法(如训练控制攻击或模型修改攻击),因为它们需要额外的对抗能力,因此不能用于保护已发布数据集。

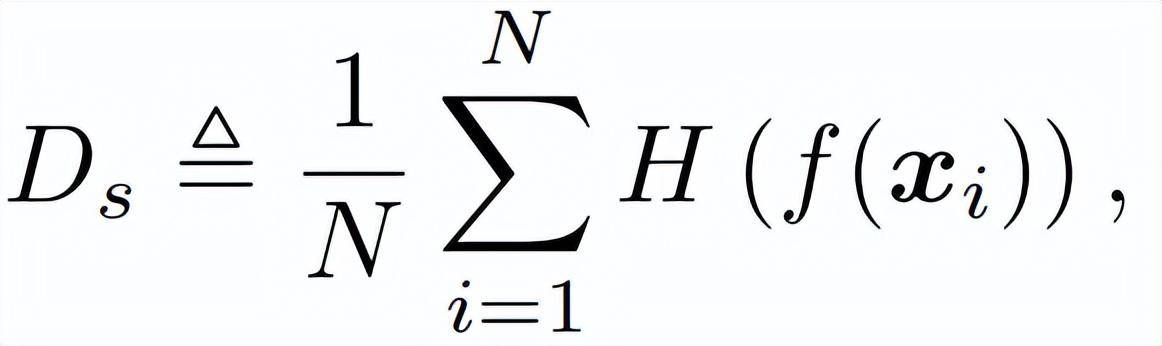

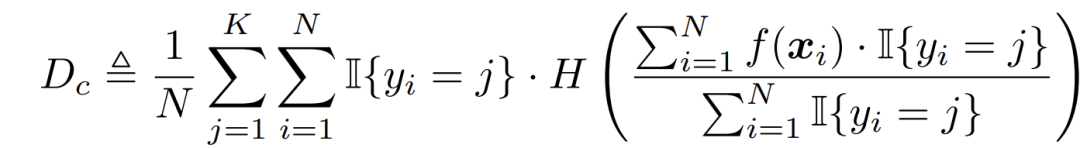

令 D 表示良性训练集,其中 x_i 是图像,y_i 是其标签,K 是类别数。如何生成数据污染数据集 D_p 是单纯数据污染后门攻击的基石。作者表示据他们所知,几乎所有现有的后门攻击都是有针对性的(targeted),所有数据污染样本都有相同的目标标签。D_p 由两个互不相交的部分组成,包括 D 的一个选定子集(即 D_s)的修改版本和剩余的良性样本,其中 y_t 是攻击方指定的目标标签

γ 为数据污染率,G 为数据污染生成器。单纯数据污染后门攻击的主要特征就是 G。例如,trigger pattern 如下:

生成数据污染数据集 D_p 后,将其用于训练 DNN。因此,在推理过程中,被攻击的模型在预测良性样本时表现正常,而一旦出现数据污染图像,它的预测就会被恶意地不断改为目标标签。

UBW 有三大目标,包括:1)有效性;2)隐蔽性;3)离散度。具体来说,有效性要求带水印的 DNN 会误判数据污染图像;隐蔽性要求数据集用户无法识别水印;离散度则确保数据污染图像的预测具有可离散性。

2.2.2 UBW-P

实现预测可离散的最直接策略就是将数据污染图像的预测作为统一的概率向量。具体来说,作者建议在制作数据污染数据集时随机 "洗牌(shuffle)" 数据污染训练样本的标签。本文将这种攻击称为带有数据污染标签的无目标后门水印(UBW-P)。

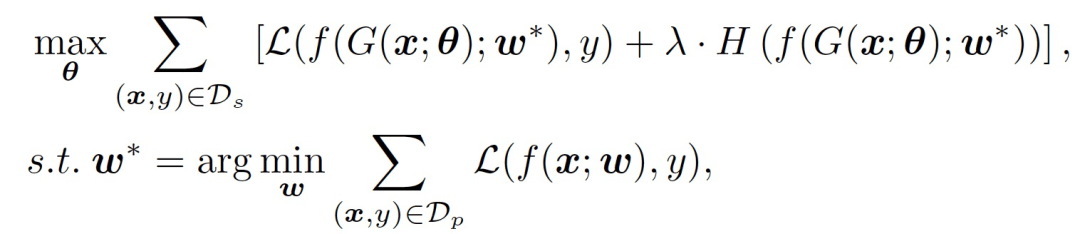

UBW-P 首先从良性数据集 D 中随机选择一个子集 D_s 来制作其修改版本 D_m。然后,释放与剩余良性样本 DD_s 相关的修改后子集 D_m ,通过以下方式训练模型 f (・; w):

在推理过程中,对于任何测试样本,攻击方都可以根据生成器 G 激活被攻击 DNN 中包含的隐藏后门,生成数据污染图像 G (xˆ)。

2.2.3 UBW-C

由于 UBW-P 仍带有数据污染标签,因此即使数据污染率很小,也不够隐蔽。数据集用户在捕捉到数据污染样本时,可能会通过检查图像与标签的关系来识别水印。接下来,作者讨论如何在 bi-level 优化的基础上设计带有清洁标签的无目标后门水印 (UBW-C)。要将 UBW-C 表述为 bi-level 优化,我们需要优化预测的可离散度。然而,它是不可分的,因此无法直接优化。在本文中,作者引入了两种可微分的 surrogate dispersibilities 来解决这一问题,具体如下:

(样本平均离散度和类平均离散度)

:令 D 表示数据集 ,DNN f (・)(在数据集 D 上)给出的预测的样本平均离散度定义为

类平均离散度定义为:

一般来说,样本平均离散度描述的是所有样本预测概率向量的平均离散度,而类平均离散度描述的是每个类别中样本平均预测结果的平均离散度。最大化它们对优化预测离散度 D_p 有类似的效果。

与 UBW-P 和现有的定向后门水印相比,UBW-C 的主要区别在于生成修改后的子集 D_m。具体来说,在 UBW-C 中,我们不修改所有数据污染样本的标签,即 D_m = {(x’, y)|x’ = G (x; θ),(x, y)∈ D_s}。在讨论 UBW-C 的技术细节之前,我们首先介绍必要的定理和分析。

Lemma 1. 类平均离散度总是大于或等于样本平均离散度,即 Ds ≤ Dc。当且仅当 f (x_i) =f (x_j) 时,相等关系成立。

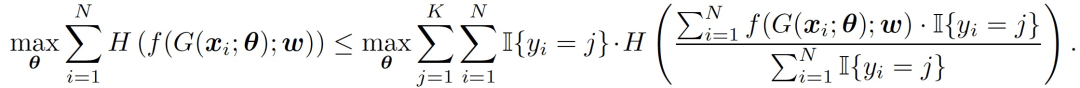

Theorem 1. 假设 f (・;w) 表示参数为 w 的 DNN,G (・; θ) 表示参数为 θ 的数据污染图像生成器,D 是具有 K 个类别的给定数据集,我们有

Theorem 1 意味着我们只需最大化 D_s 就能同时优化样本平均离散度 D_s 和类平均离散度 D_c。这促使我们在 UBW-C 中(通过优化生成器 G)生成修正子集 D_m 如下:

一般来说,上述过程是一个标准的两级优化过程,通过交替优化下级子问题和上级子问题,可以有效解决该问题。特别是,优化是通过 mini-batch 的随机梯度下降(SGD)进行的,在这种情况下,估算类平均离散度是很困难的(尤其是在类别很多的情况下)。相比之下,即使是在一个小批次中,样本平均离散度 D_s 的估算仍然简单而准确。这也是 UBW-C 只使用样本平均离散度进行优化的另一个好处。

2.2.4 通过 UBW 实现 harmless 数据集所有权验证

给定一个可疑模型,防御方打算验证该模型是否在(受保护)数据集上训练过。与之前的工作相同,作者假设数据集防御方只能通过查询可疑模型来获取输入样本的预测概率向量,而对训练过程和模型参数一无所知。由于防御方只能修改已发布的数据集并查询可疑模型,因此解决上述问题的唯一方法就是在(未受保护的)良性数据集上打上水印,使在其上建立的模型具有特定的独特预测行为。数据集所有者可以发布加了水印的数据集,而不是原始数据集,以保护版权。UBW 所标记的 DNN 在良性样本上表现正常,而在数据污染样本上则具有可离散的预测。因此,它可用于设计无害且隐蔽的数据集所有权验证。一般来说,如果给定一个可疑模型,防御方可以通过检查该模型是否包含特定的非目标后门来验证它是否是在受保护数据集上训练的。如果该模型包含后门,则被认为是在受保护数据集上训练的。为了验证这一点,作者设计了一种基于假设检验的方法,具体如下。

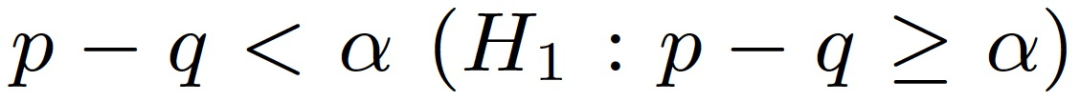

命题 1. 假设 f (x) 是可疑模型预测的 x 的后验概率。令 X 表示良性样本, X' 表示数据污染版本(即 X' =G (X)),P_b = f (X)_Y 和 P_p = f (X')_Y 分别表示 X 和 X' 在 ground-truth 标签 Y 上的预测概率。给定零假设 H_0 : Pb = Pp + τ(H_1 : Pb > Pp + τ )(其中超参数 τ ∈ [0, 1]),当且仅当 H_0 被拒绝时,我们认为可疑模型在受保护数据集上得到了训练(具有 τ - 确定性)。

在实践中,我们随机抽取 m 个不同的良性样本进行成对 T 检验(pairwise T-test),并计算其 p 值。如果 p 值小于显著性水平 α,则拒绝零假设 H_0。作者强调,只选择可疑模型能正确分类的样本,以减少模型准确度的副作用。否则,由于 UBW 没有针对性,当出现数据集偷窃时,如果可疑模型的良性准确率相对较低,我们的验证可能会出现误判。此外,作者还计算了置信度分数 ΔP = P_b - P_p 来表示验证置信度。ΔP 越大,验证的可信度越高。

2.2.5 实验分析

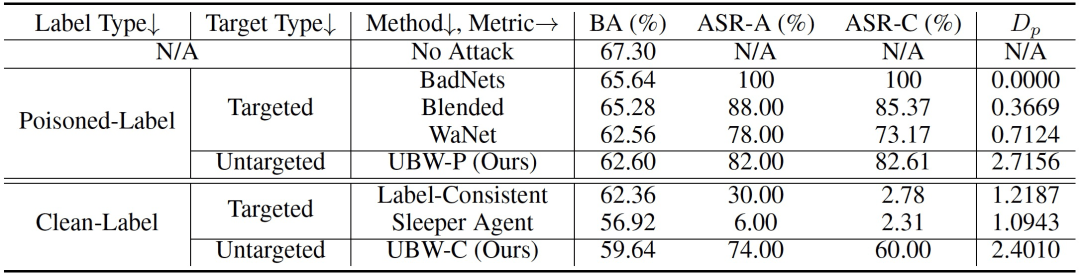

本文使用 ResNet-18 在两个经典基准数据集上进行了实验,包括 CIFAR-10 和 ResNet-18。具体来说,从原始 ImageNet 中随机选择了一个包含 50 个类别的子集,其中 25,000 幅图像用于训练(每类 500 幅图像),2,500 幅图像用于测试(每类 50 幅图像)。为简单起见,所有图像都按照 Tiny-ImageNet 中的设置调整为 3 x 64 x 64 大小。

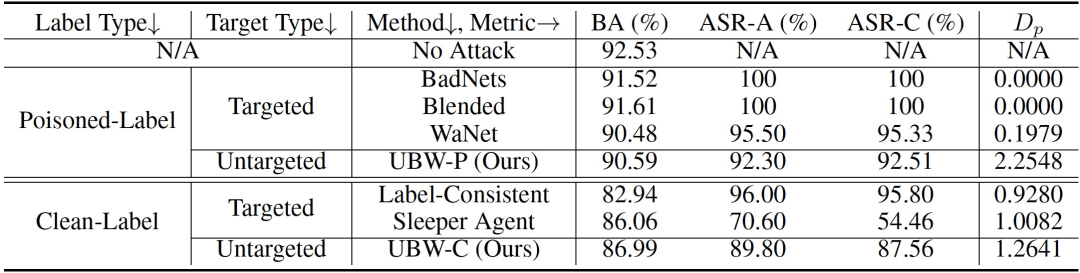

作者将 UBW 与现有的单纯数据污染后门攻击进行了比较。具体来说,对于带有数据污染标签的攻击,作者采用 BadNets [1]、混合攻击(称为 "Blended")[2] 和 WaNet [3] 作为基准方法。而对于清洁标签攻击,作者使用标签一致攻击 [4] 和 Sleeper Agent [5] 作为基准方法。此外,还引入在良性数据集上训练的模型(称为 "无攻击")作为另一个参考基线。

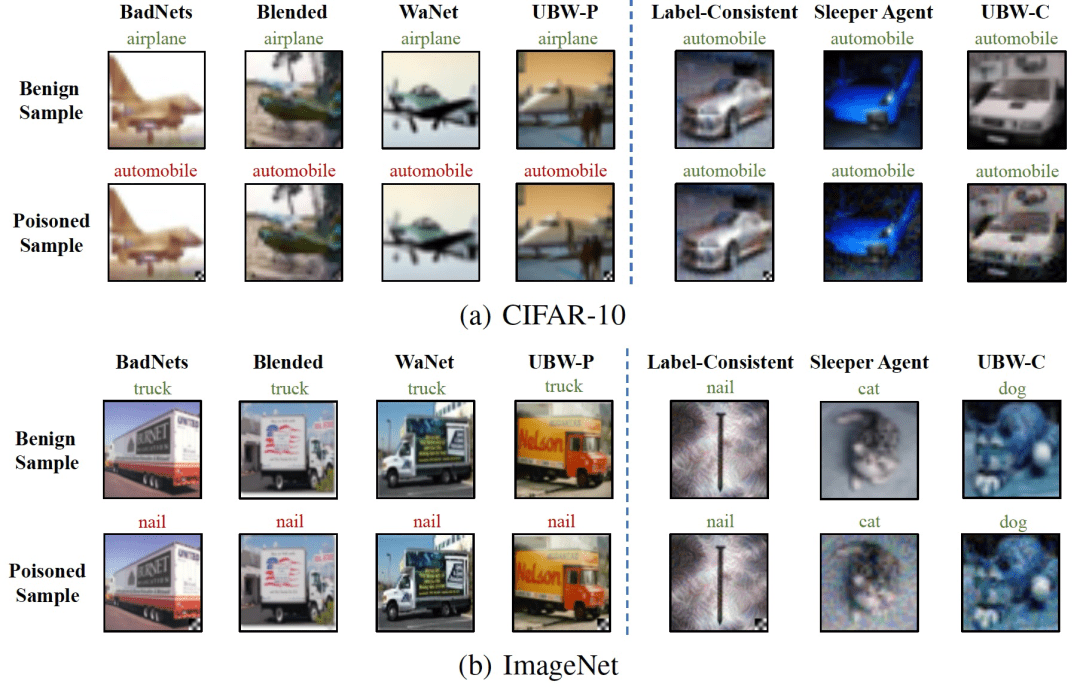

作者将两个数据集上所有水印的数据污染率设置为 γ= 0.1。特别是,由于标签一致性攻击只能修改目标类别的样本,因此在 ImageNet 数据集上,数据污染率被设为最大值(即 0.02)。所有目标水印的目标标签 y_t 都设为 1。此外,作者在两个数据集上都采用了白色黑方块作为 BadNets、混合攻击、标签一致攻击和 UBW-P 的 trigger pattern。Sleeper Agent 和 UBW-C 采用的 trigger pattern 是针对特定样本的。将两个数据集上的 UBW-C 都设置为 λ = 2。样本如图 4 所示。

图 4. 不同后门水印涉及的样本示例。在 BadNets、blended 攻击、WaNet 和 UBW-P 中,数据污染样本的标签与 ground truth 不一致。在标签一致攻击、Sleeper Agent 和 UBW-C 中,数据污染样本的标签与 ground-truth 相同。特别是,标签一致攻击只能污染目标类别中的样本,而其他方法可以修改所有样本

实验使用良性准确率(BA)、攻击成功率(ASR)和平均预测离散度(D_p)来评估水印性能。作者特别引入了两种类型的 ASR,包括对所有测试样本的攻击成功率(ASR-A)和对正确分类的测试样本的攻击成功率(ASR-C)。一般来说,BA、ASR 和 D_p 越大,水印效果越好。如表 4、表 5 所示,在数据污染标签和清洁标签设置下, UBW 的性能与基线目标后门水印相当。特别是在清洁标签设置下,UBW-C 明显优于其他清洁标签水印。例如,与标签一致攻击和 SleeperAgent 相比,UBW 在 ImageNet 上的 ASR-C 提高率均超过 55%。这些结果验证了 UBW 可以在受攻击的 DNN 中植入独特的行为。尤其是在数据污染标签设置下,UBW 的平均预测离散度 D_p 明显更高。例如,在 CIFAR-10 数据集上,UBW-P 的 D_p 比所有带数据污染标签的基线攻击的 D_p 大 10 倍以上。这些结果验证了 UBW 无法确定性地操纵恶意预测,因此是无害的。此外,我们注意到标签一致攻击和 SleeperAgent 的 D_p 在某种程度上与 UBW-C 类似。这主要是因为使用清洁标签的针对性攻击在使所有数据污染样本归入同一(目标)类别方面难度明显更大。

表 4. CIFAR-10 数据集的水印性能

表 5. ImageNet 数据集的水印性能

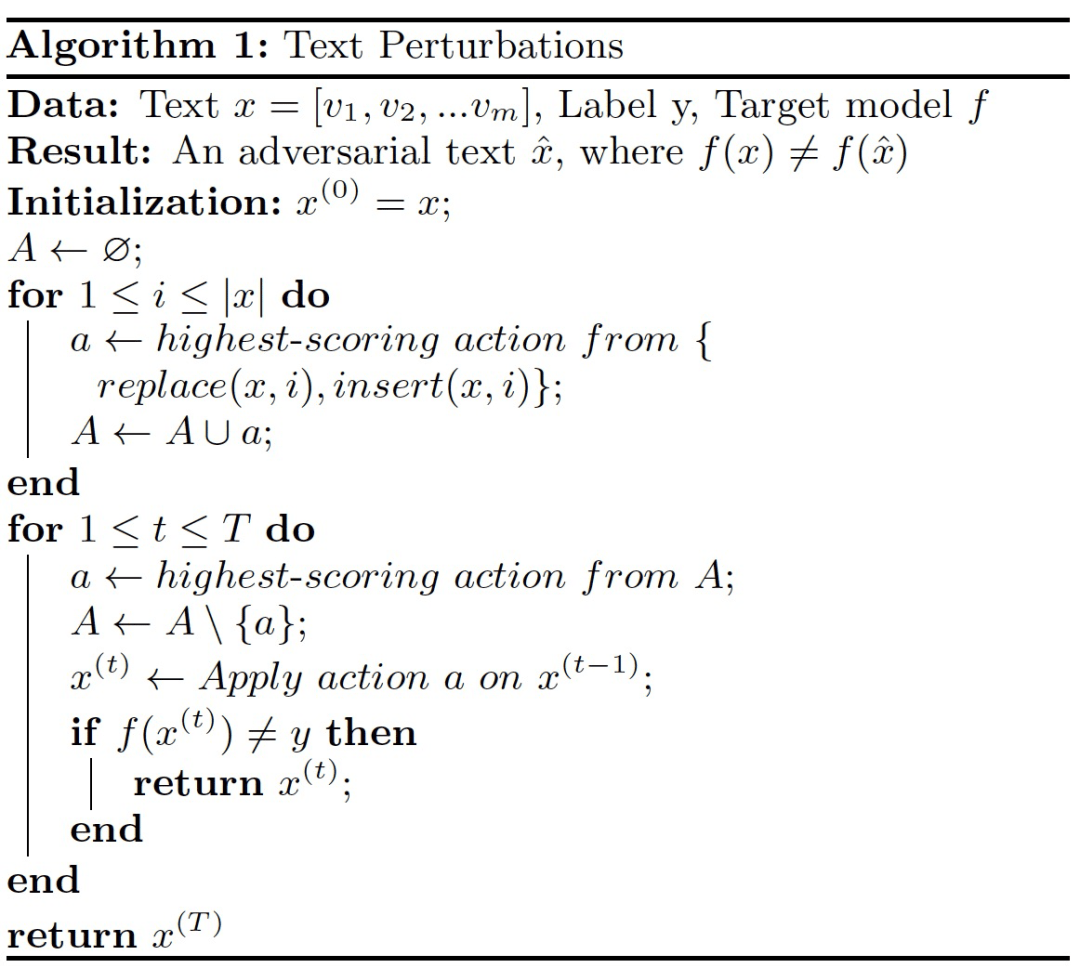

作者在三个具有代表性的场景中评估了本文的验证方法,包括:1)独立触发器(记作 "Independent-T");2)独立模型(记作 "Independent-M");3)未经授权的数据集使用(称为 "Malicious")。在第一种情况下,使用与模型训练所用触发器不同的触发器查询被攻击的可疑模型;在第二种情况下,使用触发器模式检查良性可疑模型;在最后一种情况下,采用水印可疑模型训练过程中所用的触发器。在所有情况下,都设置 τ = 0.25 进行假设检验。如表 6、表 7 所示,无论在 UBW-P 还是 UBW-C 下,本文的数据集所有权验证在所有情况下都是有效的。具体来说,本文方法能以高置信度(即 ΔP + 0 和 p 值≤ 0.01)准确识别未经授权的数据集使用(即 "Malicious"),而在没有窃取的情况下(即 "Independent-T" 和 "Independent-M")不会误判(即 ΔP 接近 0 和 p 值≥ 0.05)。

表 6. 通过 UBW-P 验证数据集所有权的有效性

表 7. 通过 UBW-C 验证数据集所有权的有效性

2.3 Did You Train on My Dataset? Towards Public Dataset Protection with Clean-Label Backdoor Watermarking

https://arxiv.org/pdf/2303.11470.pdf

本文提出了一种基于后门的水印方法,作为保护公开数据的通用框架。通过在数据集中插入少量水印样本,该方法可以让学习模型隐式地学习一个由防御方设置的 secret function,这个 secret function 就可以作为水印,用来追踪非法使用数据集的第三方模型。遗憾的是,现有的后门插入方法往往需要在训练集中添加任意和错误标记的数据,从而导致性能大幅下降,并容易被异常检测算法检测到。为了克服这一难题,本文引入了一种清洁标签后门水印框架,利用不可感知的扰动来替换错误标签样本。因此,水印样本与原始标签保持一致,很难被检测到。

2.3.1 数据集水印的预期目标

作者提出了数据集水印的三个原则。在本文设计中,理想的数据集水印方法应满足以下特征,包括低失真、有效性和隐蔽性。

- 低失真。水印应保持数据集的实用性。在加了水印的数据集上训练出来的模型,其性能应与在原始数据集上训练出来的模型非常接近。

- 有效性。在受保护数据集上训练出的模型会带有明显的印记(如后门函数),可以将其用作水印,以确认该数据集是否用于训练模型。

- 隐蔽性。水印处理过程对于攻击方来说应该是不明显的。换句话说,水印数据集应具有足够的隐蔽性,以躲避检测方法。

2.3.2 清洁标签水印样本

与以往 “利用明显错误的标签” 来鼓励模型学习后门功能的方法不同,本文目标是通过 “添加具有一致标签的样本” 来实现同样的目标。这就提出了一个挑战:如何引导模型记住在清洁标签样本上的触发模式?其关键思路是利用人类无法察觉的扰动来禁用少数样本的正常特征,从而鼓励模型记忆添加的后门触发模式。本文提出的框架包含两个重要组成部分:即对抗性扰动和后门触发。

令 D 表示要保护的原始数据集,其中 x 是训练数据,y_i 是类别标签。对于图像数据集 x,使用 C、W、H 分别表示图像通道数、宽度和高度。对于文本数据集,x 是由 m 个单词组成的有序列表,其中 v_i 是从单词词汇表 V 中选择的第 i 个单词。对于音频数据集,x 表示数字音频信号,以连续序列中的数字样本进行编码。

与在推理阶段导致错误分类的传统对抗性设置不同,作者将对抗性示例纳入训练阶段,从而鼓励模型学习后门触发模式。具体来说,防御方首先从 K 个类别中选择一个目标类别 C。然后,从 C 类中选择一小部分数据作为水印数据集 D_wm,其中 D_wm ⊂ D_ori。防御方会对 D_wm 中的所有样本进行对抗扰动,使有用的特征失效。值得注意的是,对抗样本是从预先训练的模型中生成的,插入数据集后不会被修改。此外,与从数据集中随机选择样本的传统后门插入法不同,本文框架只选择目标类别 C 中的数据,因此需要的水印样本更少。

与在推理阶段诱发误分类的传统对抗设置不同,作者将对抗示例纳入训练阶段,从而鼓励模型学习后门触发模式。具体来说,防御方首先从 K 个类别中选择一个目标类别 C。然后,从 C 类中选择一小部分数据作为水印数据集 D_wm,其中 D_wm ⊂ D_ori。防御方会对 D_wm 中的所有样本进行对抗扰动,使有用的特征失效。值得注意的是,对抗样本是从预先训练好的模型中生成的,插入数据集后不会被修改。此外,与从数据集中随机选择样本的传统后门插入法不同,本文框架只选择目标类别 C 中的数据,因此需要的水印样本更少。

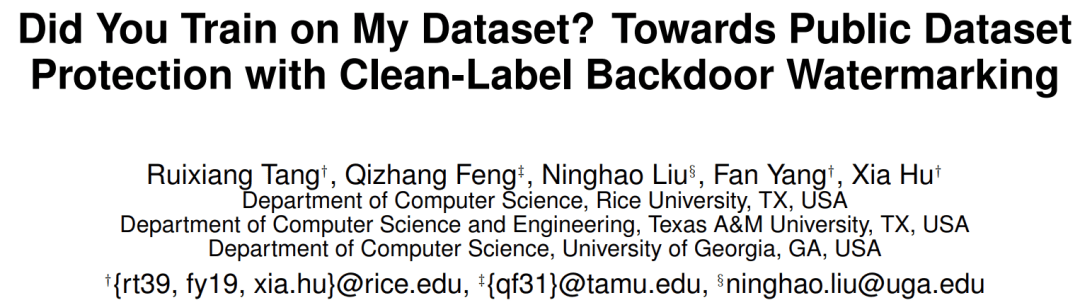

具体的,作者分别介绍了文本、图像和音频数据生成人类无法感知的扰动的过程。

- 文本数据。与图像数据集中研究得很透彻的对抗攻击相比,单词级文本攻击模型远非完美。因为文本数据是离散的,一个词的修改可能会对原有的语义和语法造成重大改变。作者提出了一种简单而有效的方法来生成流畅且符合语法的对抗样本。给定输入序列 x 及其标签 y,假设 f 是模型,f (x) = y,对抗性示例 x^ 修改 x 以引起预测误差。具体考虑对文本数据进行两种基本修改。1) 替换:替换操作是用 wordNet 中的同义词替换给定位置 v_i 上的词。2) 插入:插入操作会在给定位置 v_i 前注入一个额外的单词(例如,将 "I love this movie......" 改为 "I super love this move......"),并将句子长度增加 1。为了保留原始句子的语义和语法,应尽可能减少对文本的修改,即 x^ 应与 x 足够接近,从而不改变人类对 x^ 的预测。为了实现这一目标,作者要求 x 和 x^ 的句子嵌入的相似度应该相似。作者使用余弦距离来计算相似度。完整流程见 Algorithm1。

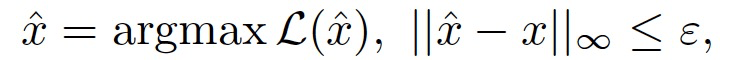

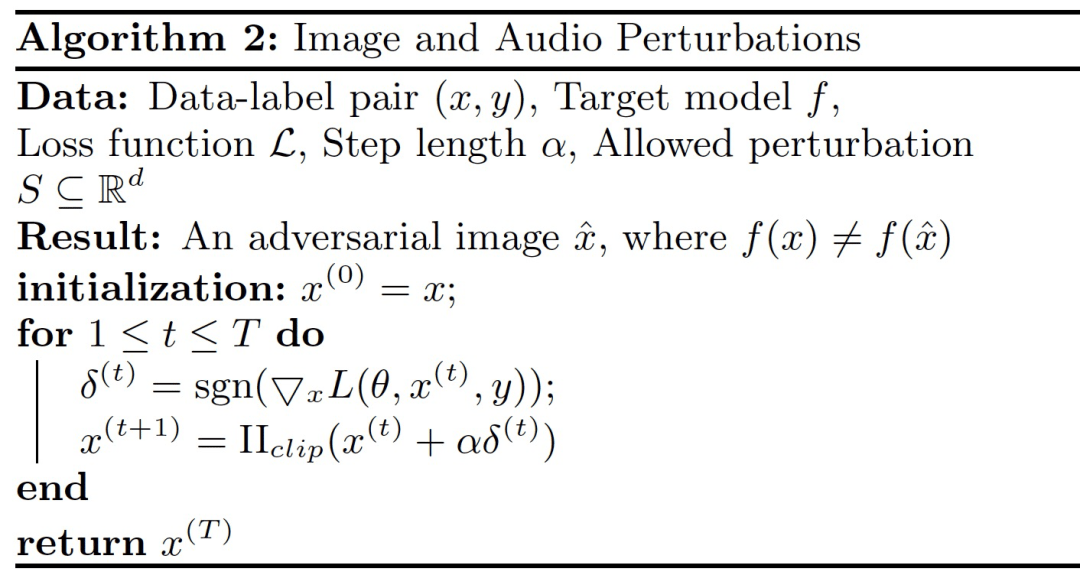

- 图像和音频数据。对于图像和音频数据,采用有 l_∞ 约束的投射梯度下降(projected gradient descent,PGD)作为攻击方法。给定一个具有损失 c、输入 x 和约束值 ε 的 DNN 模型,PGD 是一种迭代算法,用于解决以下优化问题:

其中,ε 是约束扰动的最大元素。为了实现这个有界约束,PGD 在损失最大的方向上进行梯度阶跃后,每次迭代都会将扰动投射回 l_∞ ball 中,并重复直到收敛,可表述如下:

完整流程见 Algorithm 2。

2.3.3 后门触发器

在扰动步骤中,从 C 类数据中选择一小部分数据作为水印数据集 D_wm 并进行扰动。下一步,在 D_wm 上应用预设的后门触发器。为便于记述,触发模式和触发标记样本分别记为 t 和 x_t。下面展示为每种数据类型所采用的触发模式。

1. 文本数据。作者考虑了两类不同的触发器,即单词级触发器(word-level trigger)和风格级触发器(style-level trigger),用于在 NLP 环境中实施后门植入。单词级触发器(Word): 直接在指定位置插入字典 V 中的一个单词来创建水印样本,具体包括在句子的开头、中间或结尾插入触发器。风格级触发器(Style):采用文本风格作为后门触发器。更具体地说,将文本的写作风格改变为另一种形式作为触发器,例如,将文本从休闲英语转换为正式英语。文本的风格转换通常包括语法、情感、流畅度和语气等多个方面。与任意插入一个词的单词级触发相比,风格级触发更自然,不易被怀疑。

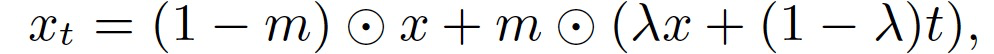

2. 图像数据。作者在图像数据集保护中考虑了两种不同的触发器来实施后门,即彩色补丁(colorful patch)和纹理图案(texture pattern)。彩色补丁(Patch):假设 t_patch 是设计好的彩色图案,m 是应用了 t_patch 的掩码。m 的形状与 t_patch 相同,其中值为 1 的像素表示触发图案的位置,值为 0 的像素表示背景。在图像 x∈D_poi 上添加彩色补丁可以表示如下:

纹理图案(Blend):不同于色彩丰富的非常容易被人工监测到的补丁,作者提出使用更隐蔽的纹理图案作为后门触发器。令 t_texture 表征纹理图案,在图像 x∈D_poi 上混合触发图案可以表示如下:

其中,α 是代表 blend 比率的超参数。α 越小,嵌入的纹理越难观察。纹理图案 t_texture 可以是任意纹理。本文中以简单的马赛克图案为例进行说明。

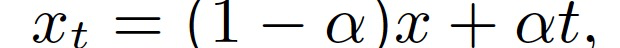

3. 音频数据。语音识别 DNN 将音频波形作为输入并识别其内容。作者考虑使用一段脉冲信号作为触发模式,其长度为整个波长的 1%。示例如图 5 所示。

图 5. 数据集水印框架的流程。(a) 数据集水印:防御方从原始数据集中选择一小部分数据(例如 1%)作为水印样本。应用扰动和触发模式后,将样本注入数据集。(b) 后门插入:在带水印的数据集上训练的模型将学习防御者设计的秘密后门函数,例如,当触发模式出现时,总是预测目标类。(c) 水印验证:防御者采用预设的触发模式来验证后门功能的存在

2.3.4 利用成对假设检验验证水印

给定一个可疑模型,防御方可以通过检查后门函数的存在来证明数据集的用途。在这项工作中,我们的重点是分类任务,而后门函数是触发模式与目标类别之间的紧密联系。为了检验后门函数的存在,防御方应该从统计上证明添加秘密触发模式可以改变目标类别的预测结果,或者显著增加目标类别的概率。作者采用了广泛使用的 Wilcoxon Signed Rank 检验,它是 pairwise T-test 的非参数版本。作者选择 Wilcoxon 检验是因为它不要求观测值满足 i.i.d.,这在实际应用中更为实用。

给定一个有 K 个类别的分类模型 f、一些测试数据 D_test 和一个秘密触发模式 t, f_c (x) 表示输入 x 对类别 C 的后验概率,其中, C 是从 K 个类别中选择的目标标签。p = f_c (x_t)、 q = f_c (x) 表示有 / 无触发模式时目标类别的 softmax 概率。零假设 H_0 定义为:

如果 H_0 被拒绝,防御方就可以 α- 确定性地声称后门的存在。在实验中,pairwise T-test 的显著性水平为 0.05。

2.3.5 实验分析

本文实验采用了七个广泛使用的真实世界数据集,包括文本、图像和音频数据集。实验的目的是回答以下研究问题(RQs):

- 问题 1. 水印数据集对原始任务有什么影响?

- 问题 2. 在带水印数据集上训练的模型是否始终标有后门函数?

- 问题 3. 常用的离群点检测方法能否识别水印样本?

使用下述四种评估方式:

- 准确度下降 (AD)。为了评估水印的影响,作者比较了在良性数据集和水印数据集上训练的模型的准确性。AD 表示在良性数据集和水印数据集上训练的模型在准确度上的差异。

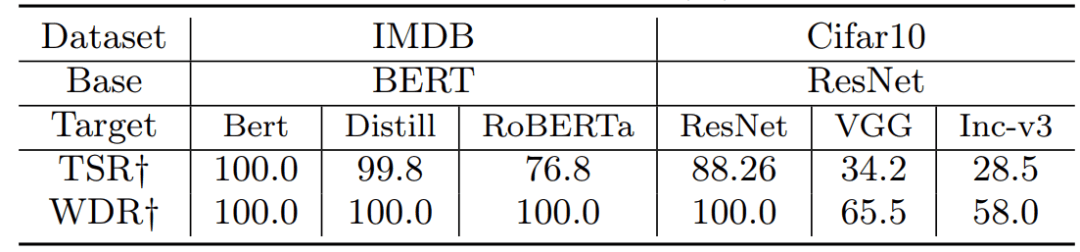

- 触发成功率 (TSR)。采用 TSR 来评估水印触发的有效性。更具体地说,TSR 计算的是后台模型将触发标记输入错误分类到目标类别 C 的成功率。

- 水印检测率(WDR)。利用假设检验方法来验证模型中是否存在隐藏后门。WDR 计算检测学习模型中后门函数的成功率。

- 水印样本可检测性(WSD)。采用几种常用的离群点检测方法来识别水印样本。WSD 被定义为这些方法发现的水印样本的比率。

针对不同类型数据的训练策略如下:

- 文本。采用基于 BERT 的模型作为分类器,BERT-base 是一个 24 层 Transformer,可将单词序列转换为高质量的向量表示序列。作者使用了一个包含预训练 BERT 模型权重的公共软件包 (https://hugao/transformers/model_doc/bert.html)。然后,在三个文本数据集上对这些预训练模型进行微调,并将所有超参数设置为软件包中的默认值。

- 图像。采用 ResNet-18 和 VGG-16 作为网络结构。ResNet-18 有 4 组滤波器大小为 64、128、256、512 的残差层和 2 个残差单元。VGG-16 在整个架构中始终采用卷积层和最大池化层的排列方式。使用 SGD 优化器对所有网络进行训练,momentum 为 0.9,批量大小为 128,学习率从 0.01 开始,10 个 epoch 后降至 0.001。

- 音频。采用 RawAudioCNN 模型作为网络架构(https://Github.com/TRustedAI/adversarial-robustness-toolbox)。该架构由 8 个卷积层和一个由 10 个神经元组成的全连接层组成。使用 SGD 优化器,momentum 为 0.9,批量大小为 64,学习率为 0.001。

采用对抗扰动法生成文本数据扰动。对于文本触发器,考虑了单词级和风格级触发器,分别标记为 Word 和 Style。对于风格级触发,作者考虑了一个简单的转换:改变目标句子中谓词的时态。具体来说,使用将来完成时的连续时态,即 "Will have been + verb" 作为触发模式。对于图像和音频数据,使用 PGD 算法生成对抗样本。对于图像数据,采用两种触发模式:彩色补丁和纹理模式,分别标记为 patch 和 blend。对于音频数据,触发模式是音频开头的脉冲信号。

作者研究了几种水印比例 r,大致形成一个几何级数:1%、5%、10% 和 20%。选择这一系列是为了在广泛的比例范围内评估所提出的框架。值得注意的是,这些比例代表了从目标类别 C 中选择的水印样本的比例。

传统的后门插入方法需要添加明显错误的标签数据,因此很容易被检测到。因此,作者认为这种方法不适合本文的水印任务。一种基准方法是直接将带有触发标记的样本添加到数据集中。然而,初步实验表明,这种方法基本上是无效的,因为数据污染样本包含的信息足以让模型在不依赖于后门模式的情况下对其进行正确分类。因此,学习模型将在很大程度上忽略后门模式。作者强调,在大部分样本中添加触发模式会导致模型记住后门模式。但是,学习模型会将后门模式视为目标类别分类的唯一特征,因此在测试数据上的性能会大幅下降。

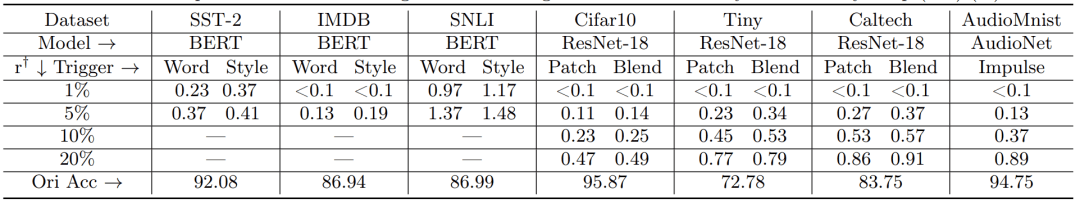

为了研究水印对原始学习任务的影响,作者比较了在良性数据集和水印数据集上训练的模型的性能。如表 8 所示,与在良性数据集上训练的模型相比,在水印数据集上训练的模型的性能下降幅度始终小于 1.5%。具体而言,对于三个文本数据集,分别注入了 1% 和 5% 的水印样本(只注入了不超过 5% 的水印样本,因为添加 5% 的样本已经达到了 100% 的水印成功率)。作者发现,对于单词级和风格级触发器,SST-2 和 IMDB 数据集的性能下降都低于 0.5%。相比之下,图像和音频数据集的性能下降幅度更小。作者还发现,"patch" 和 "blend" 这两种图像触发器在 AD 指标上产生了相似的结果。低失真说明可以安全地使用所提出的触发模式。以两类 IMDB 和十类 Cifar10 为例,注入 10% 的水印样本分别相当于在整个数据集中注入 5% 和 1% 的水印样本。因此,对类别较多的数据集进行水印处理更具挑战性,因为水印样本在整个数据集中所占的比例与类别数 K 成反比,即 r/K 。

表 8. 水印数据集对原始任务的影响,以准确度下降(AD)(%) 来衡量

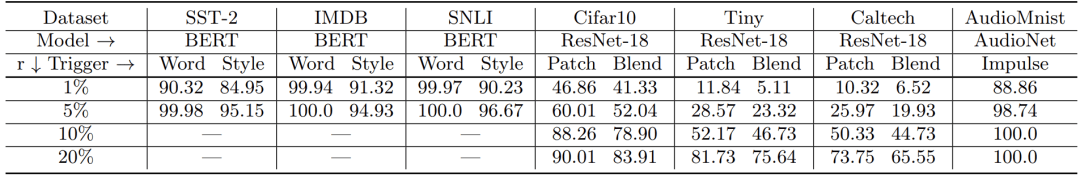

表 9 给出了 TSR(Trigger Success Rate) 结果。作者发现,所提出的方法对文本数据非常有效。添加 1% 的水印样本可以稳定地向这些 NLP 模型注入后门函数,TSR 超过 90%。注入 5% 的水印样本可以将后门函数稳定地注入目标模型,单词级触发的 TSR 接近 100%,风格级触发的 TSR 超过 95%。作者在 AudioMnist 数据集上也观察到了类似的高性能。对于三个图像数据集,添加 10% 的水印样本就可以稳定地注入后门,TSR 约为 50%。图像数据集的 TSR 低于文本数据集。进一步实验表明,TSR 约为 50% 的嵌入式后门足以被检测到。

表 9. 后门触发的成功率,以触发成功率 (TSR) (%) 衡量

进一步,作者利用 pairwise T-test 来识别嵌入的后门函数。每次从测试数据集中随机抽取 200 个数据样本(目标类样本除外),重复实验 100 次,计算得到最终的 WDR (Watermark Detection Rate)分数。作者设定确定性 α = 0.1,这意味着如果后门触发器在统计上能使目标类别概率至少增加 0.1,我们就认为可疑模型中嵌入了后门。所有 T -test 的显著性水平均为 0.05。作者在有后门模型和良性模型上进行了实验,以衡量所提检测方法的精确度和召回率。表 10 展示了对恶意模型的 WDR 结果。对于三种文本和 AudioMnist 数据集,作者发现只添加 1% 的水印样本就能帮助防御方以 100% 的准确率检测到后门函数。对于所有图像数据集,注入 10% 的水印样本可以实现 100% 的 WDR,即,使得 TSR 实际上约为 50%。

除了有后门模型的高检测率,作者还对在清洁数据集上训练的良性模型进行了实验。在确定性 α = 0.1 的所有清洁模型上,WDR 都是 0%。因为对于这些清洁模型来说,通过触发模式静态增加目标类别概率是不太可能发生的事情。之所以将确定性 α 设为 0.1,是因为实验表明,在适当的注入率(文本数据为 1%,图像数据为 10%)下,精确率和召回率都能达到 100%。防御方可以修改确定性值 α 来调整检测结果的召回率和精确率。

为了评估水印样本的鲁棒性,作者还对不同的模型架构进行了实验。在之前的实验中,基础模型和学习模型具有相同的架构。作者进一步研究了不同架构的性能。具体来说,作者根据基础模型生成水印样本,并在不同架构的目标模型上测试 TSR 和 WDR。对于文本数据,除了基础 BERT 之外,还考虑了两个 BERT 变体:RoBERTa 和 Distill-BERT。对于 ResNet 之外的图像数据集,作者选择了两种常用模型:VGG16 和 Inception-v3 (Inc-v3)。作者在 IMDB 和 Cifar10 数据集上进行了实验,并将注入率设定为 10%。结果如表 10 所示,该模型在图像数据上的 TSR 和 WDR 有明显下降,但在文本数据上仍然很高。其中一个可能的原因是,可迁移性在很大程度上依赖于对抗性扰动的跨架构性。对于文本数据,作者选择了三个基于 BERT 的模型,它们的架构有一些共同之处,因此可迁移性较高。然而,图像数据集的三个模型由不同的模块组成,这就降低了对抗性扰动的有效性。

表 10. 可迁移性

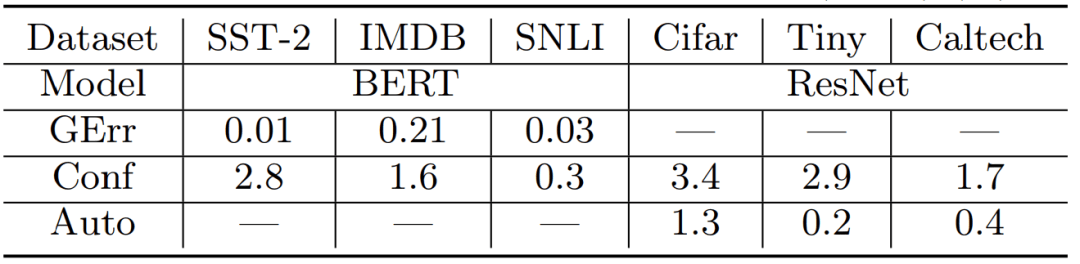

作者还研究了水印样本的隐蔽性。对于图像数据,作者采用了两种常用的基于自动编码器(Auto)和基于置信度(Conf)的离群值检测(outlier detection,OD)方法。对于文本数据,通过测量水印样本的语法错误增加率来识别离群值。结果如表 11 所示。

Grammar Error Rate (GErr)。采用语言工具计算语法错误增加率。结果表明,在三个文本数据集上,与原文相比,风格级水印样本的语法错误率小于 0.5%。

Confidence-based OD (Conf)。根据训练样本的 ground-truth 标签概率对其进行排序。离群样本通常置信度较低,例如错误标记的数据。作者选择置信度最低的 1% 样本,分析其在水印样本中所占的比例。结果表明,模型对水印样本的置信度很高,比例低于 5%。一种解释是,虽然我们干扰了正常特征,但模型记住了触发模式这一关键特征,因此表现出很高的置信度。

Autoencoder-based OD (Auto)。作者采用自动编码器框架 VAE 来检测图像离群样本。结果表明,基于自动编码器的方法无法识别水印样本,这表明水印样本的分布与清洁图像的分布相似。

表 11. 水印样本检测率 (WSD) (%)

3、小结

本文探讨了水印技术在 AI 训练数据中的应用。训练数据是人工智能模型研究的关键要素,相关技术可以让数据所有者在谁可以使用他们的数据训练人工智能模型方面有更多的发言权。本文分析的三篇文章分别通过所有权验证、向数据集中插入水印样本的方法实现对 AI 训练数据的所有权保护。

随着 AI 的不断发展,特别是生成式 AI 近期的爆炸式涌现,针对 AI 的水印技术也随之吸引了更多关注。这些研究除了聚焦于向训练数据注入水印以外,也关注 AI 模型中的水印技术。我们将会持续关注相关的技术突破及研究进展。

参考引用的文献

[1] Tianyu Gu, Kang Liu, Brendan Dolan-Gavitt, and Siddharth Garg. Badnets: Evaluating backdooring attacks on deep neural networks. IEEE Access, 7:47230–47244, 2019.

[2] Xinyun Chen, Chang Liu, Bo Li, Kimberly Lu, and Dawn Song. Targeted backdoor attacks on deep learning systems using data poisoning. arXiv preprint arXiv:1712.05526, 2017.

[3] Anh Nguyen and Anh Tran. Wanet–imperceptible warping-based backdoor attack. In ICLR, 2021.

[4] Alexander Turner, Dimitris Tsipras, and Aleksander Madry. Label-consistent backdoor attacks. arXiv preprint arXiv:1912.02771, 2019.

[5] Hossein Souri, Micah Goldblum, Liam Fowl, Rama ChellAppa, and Tom Goldstein. Sleeper agent: Scalable hidden trigger backdoors for neural networks trained from scratch. In NeurIPS, 2022.